핵심 요약

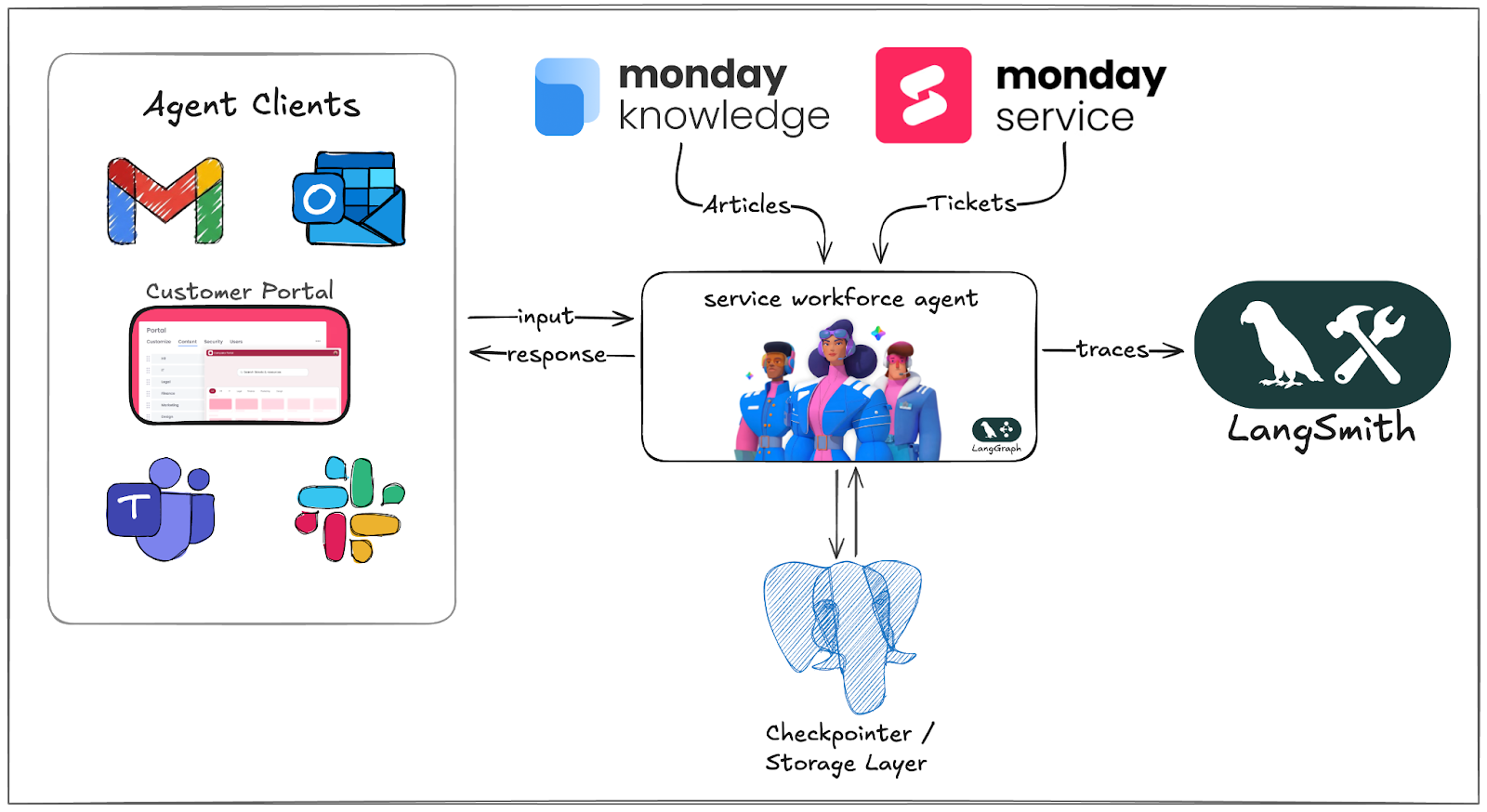

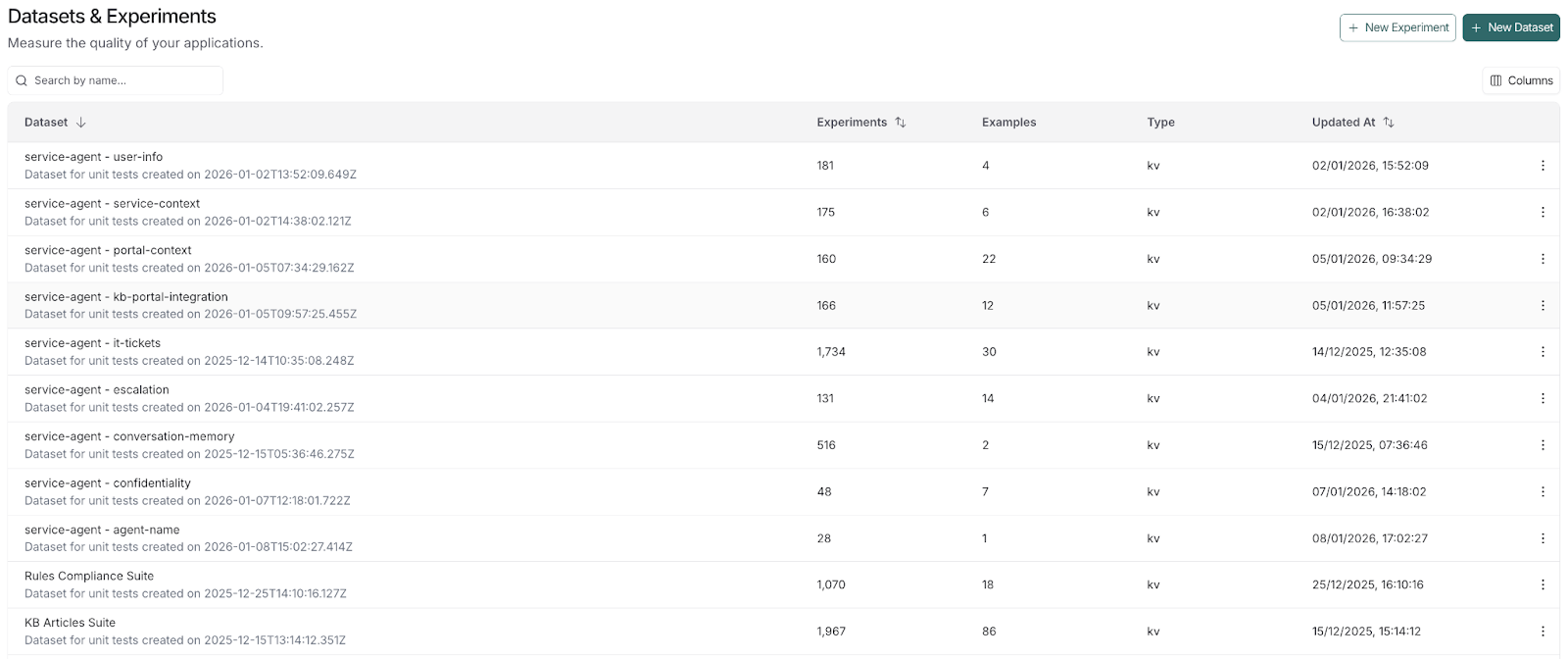

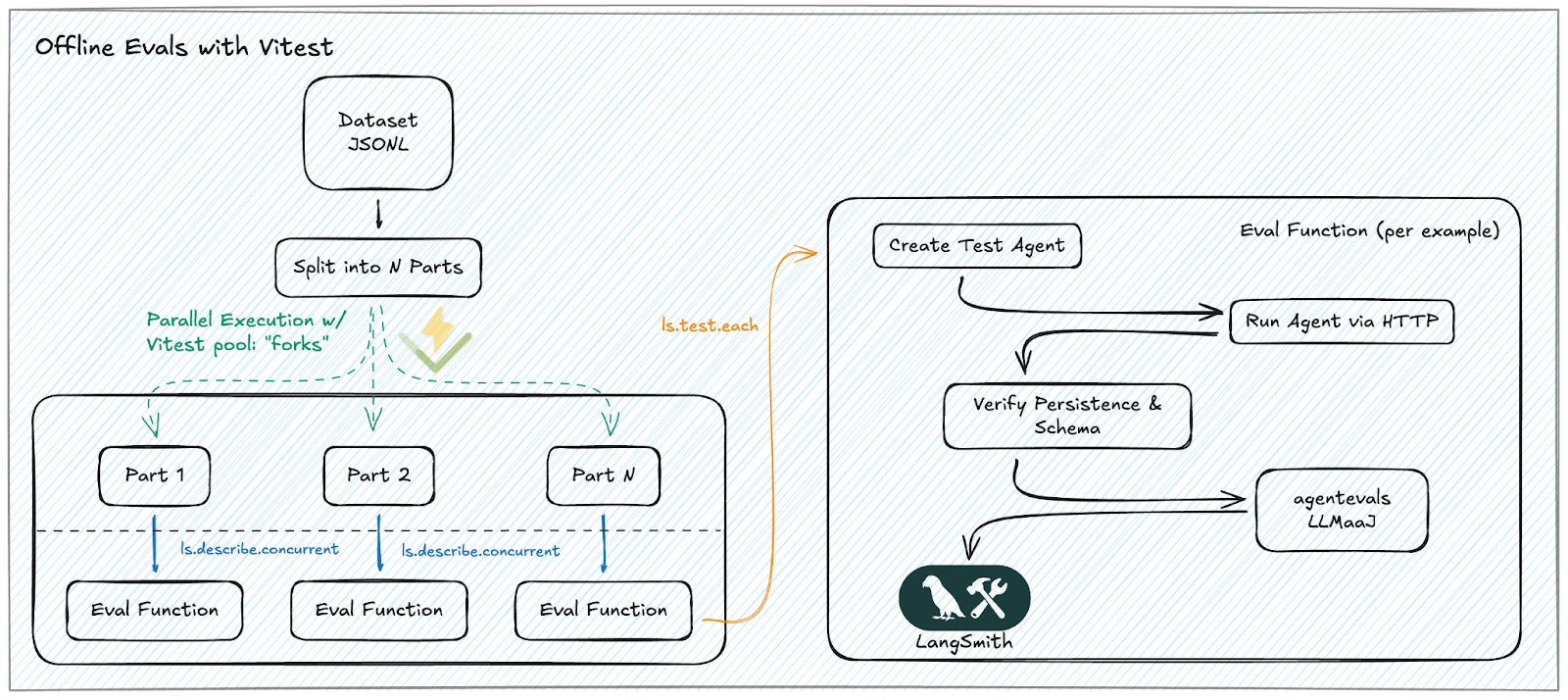

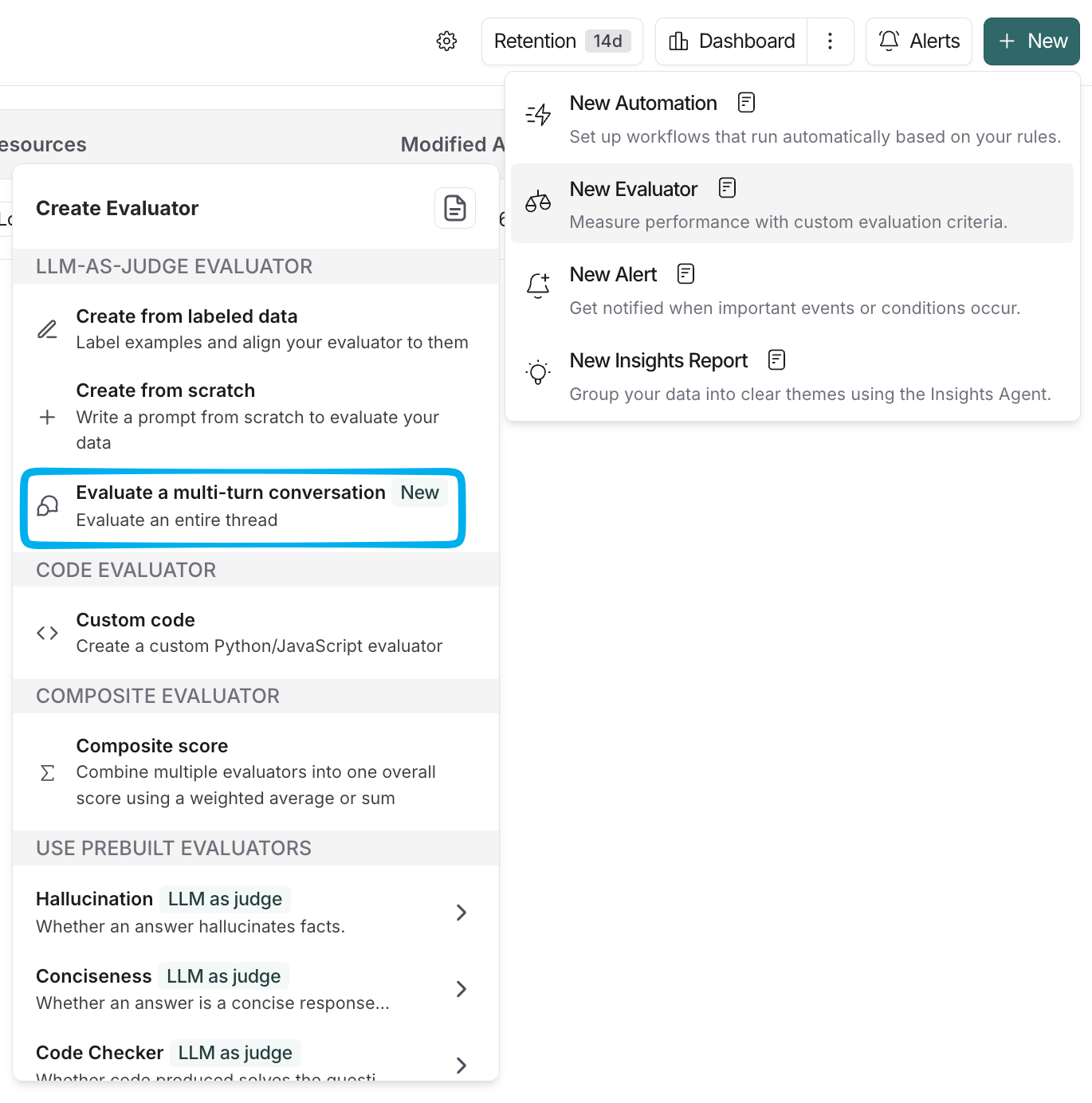

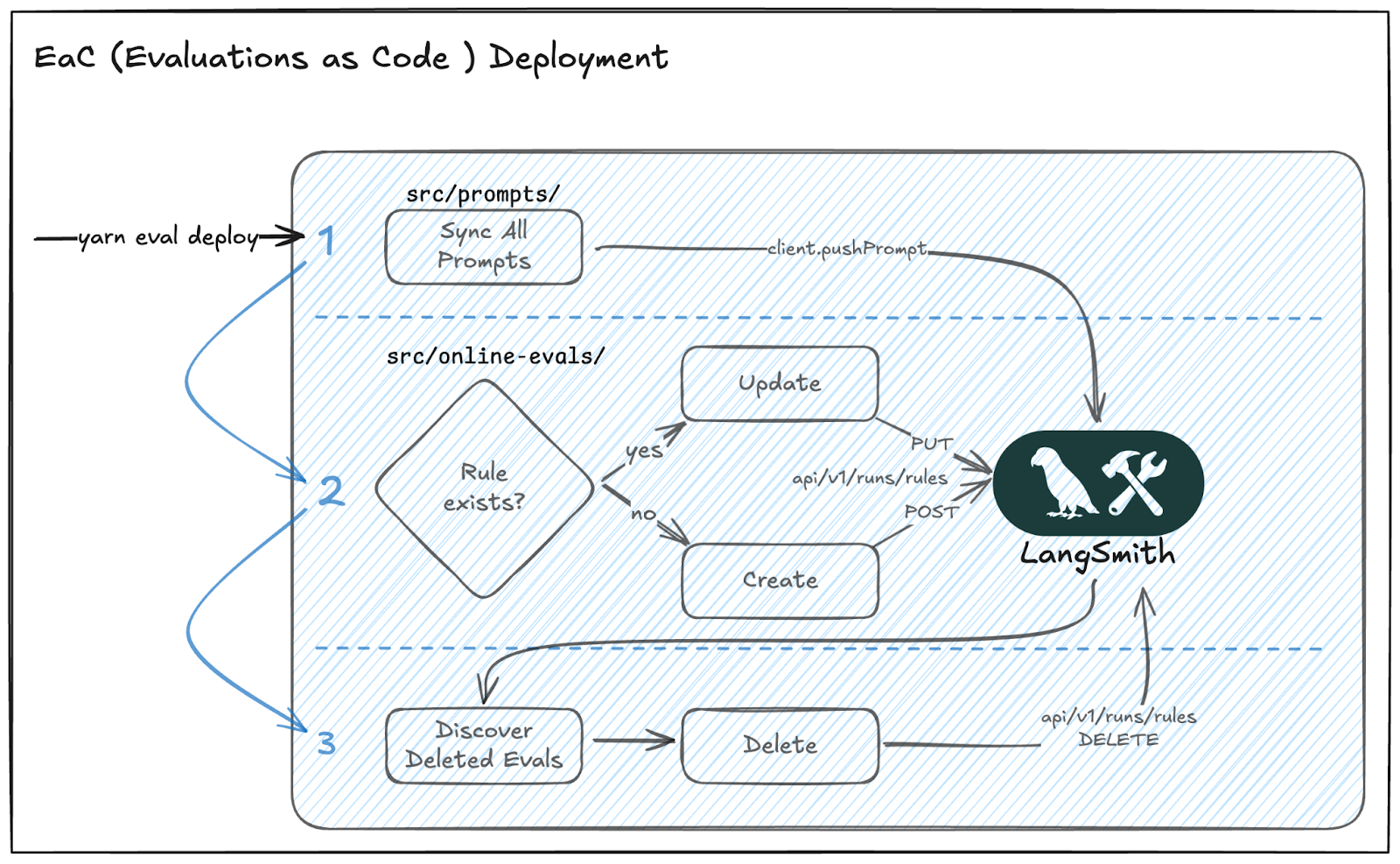

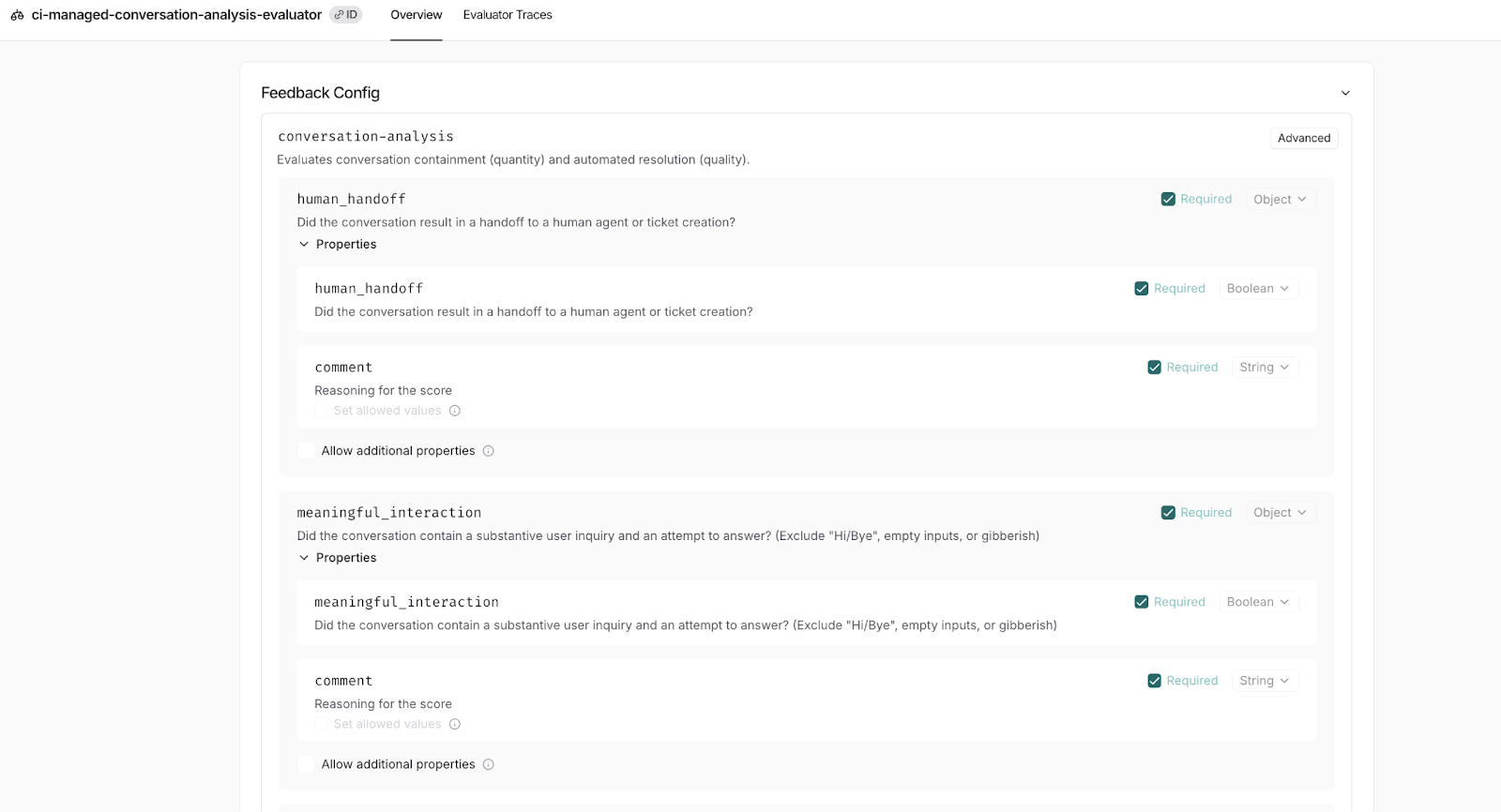

Monday.com은 자사의 AI 서비스 에이전트 개발 과정에서 평가를 'Day 0' 요구사항으로 설정하고, 오프라인과 온라인을 아우르는 이중 레이어 평가 프레임워크를 구축했다. 오프라인 평가에서는 Vitest와 LangSmith를 결합하여 병렬 처리를 구현함으로써 피드백 루프 속도를 8.7배 향상시켰으며, 온라인 평가에서는 실제 운영 트래픽을 실시간으로 모니터링하는 멀티 턴 평가기를 도입했다. 또한 모든 평가 로직을 TypeScript 코드로 관리하고 CI/CD 파이프라인을 통해 배포하는 '코드로서의 평가(Evaluations as Code)' 방식을 채택하여 개발 생산성과 신뢰성을 동시에 확보했다.

배경

LLM 에이전트 기본 개념, LangChain/LangGraph 이해, Vitest 또는 Jest 등 테스트 프레임워크 경험, CI/CD 파이프라인 기초

대상 독자

LLM 에이전트를 프로덕션 환경에서 운영하고 평가 자동화를 고민하는 개발자 및 팀장

의미 / 영향

AI 에이전트의 복잡성이 증가함에 따라 단순한 단위 테스트를 넘어선 체계적인 평가 프레임워크의 중요성이 커지고 있다. Monday.com의 사례는 평가를 소프트웨어 엔지니어링의 영역으로 끌어들여 자동화하고 가속화하는 표준적인 방법론을 제시한다.

섹션별 상세

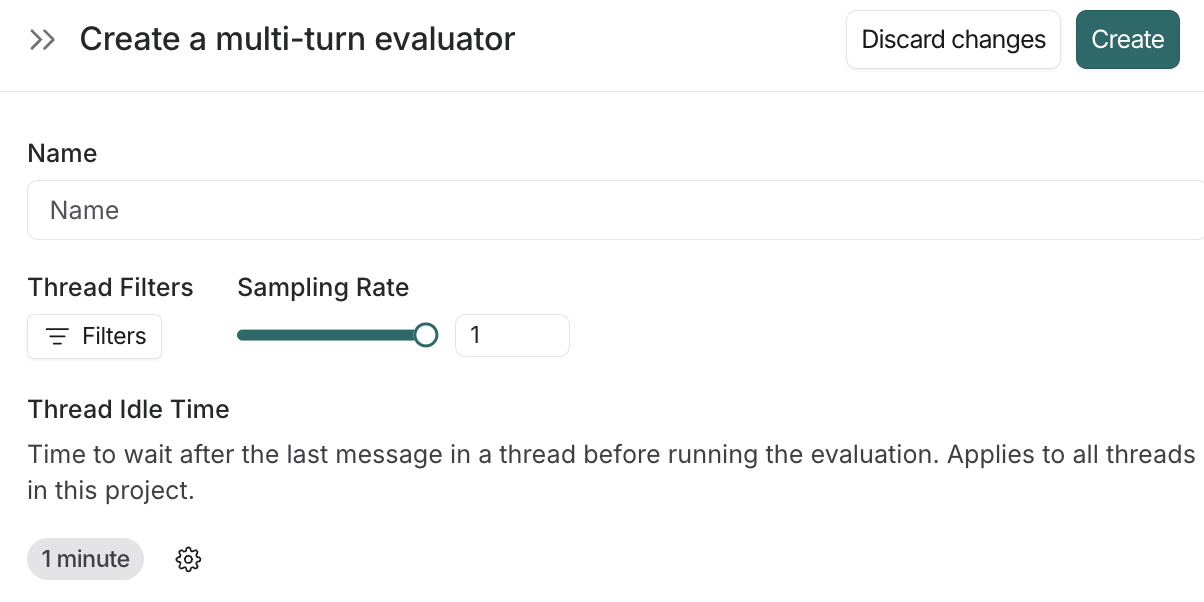

이미지 분석

실무 Takeaway

- AI 에이전트 개발 시 평가를 사후 검증이 아닌 초기 설계 단계(Day 0)부터 포함시켜 품질 저하를 조기에 방지해야 한다.

- 병렬 처리와 동시성 제어를 결합한 하이브리드 평가 아키텍처를 통해 수백 개의 테스트 케이스에 대한 피드백 시간을 90% 가까이 절감할 수 있다.

- 평가 로직을 코드로 관리(EaC)하고 CI/CD에 통합함으로써 인프라의 일관성을 유지하고 개발 도구와의 시너지를 극대화할 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료