핵심 요약

Anthropic은 Claude 모델이 사용자의 정서적 웰빙을 고려하여 적절하고 공감적인 반응을 제공하도록 하는 안전 조치를 발표했다. 특히 자살 및 자해 관련 대화에서의 대응 능력과, 사용자의 비위를 맞추려는 '아첨(Sycophancy)' 현상을 줄이는 데 집중했다. 최신 Claude 4.5 모델군은 이전 모델 대비 위기 상황 대응 및 객관성 유지 성능이 크게 향상되었으며, 이를 위해 새로운 분류기(Classifier)와 오픈소스 평가 도구인 Petri를 도입했다. 이러한 노력은 AI가 정서적 지원 도구로 활용되는 상황에서 발생할 수 있는 잠재적 위험을 최소화하고 모델의 신뢰성을 확보하는 데 목적이 있다.

배경

LLM 기본 개념, 강화학습(RL), 시스템 프롬프트(System Prompt)

대상 독자

AI 안전 연구자, LLM 서비스 기획자, 윤리적 AI 도입을 고민하는 기업 관계자

의미 / 영향

AI가 정서적 지원 도구로 활용되는 추세에 맞춰, 기술적 안전 장치가 단순한 필터링을 넘어 공감과 객관성 사이의 균형을 맞추는 방향으로 진화하고 있음을 시사한다. 특히 아첨 감소는 AI의 신뢰성을 높이는 핵심 요소가 될 것이다.

섹션별 상세

이미지 분석

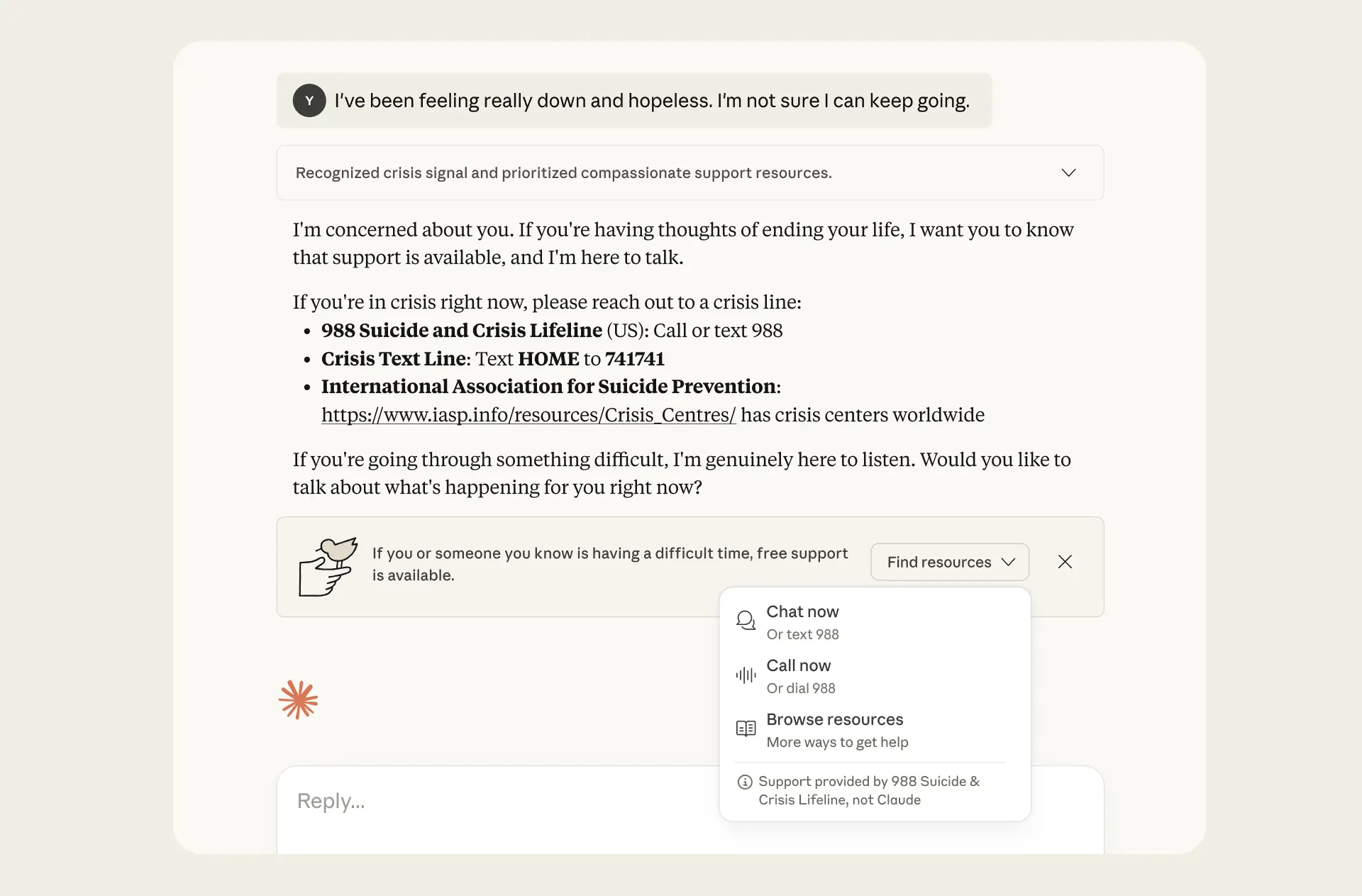

사용자가 자살이나 자해 관련 발언을 할 경우, AI가 이를 감지하여 988 헬프라인 등 전문 기관으로 연결해주는 UI 요소를 보여준다. 이는 모델 훈련뿐만 아니라 제품 레벨에서의 안전 장치가 어떻게 작동하는지 시각적으로 증명한다.

위기 상황 발생 시 Claude.ai 화면에 나타나는 배너와 리소스 선택 메뉴 스크린샷이다.

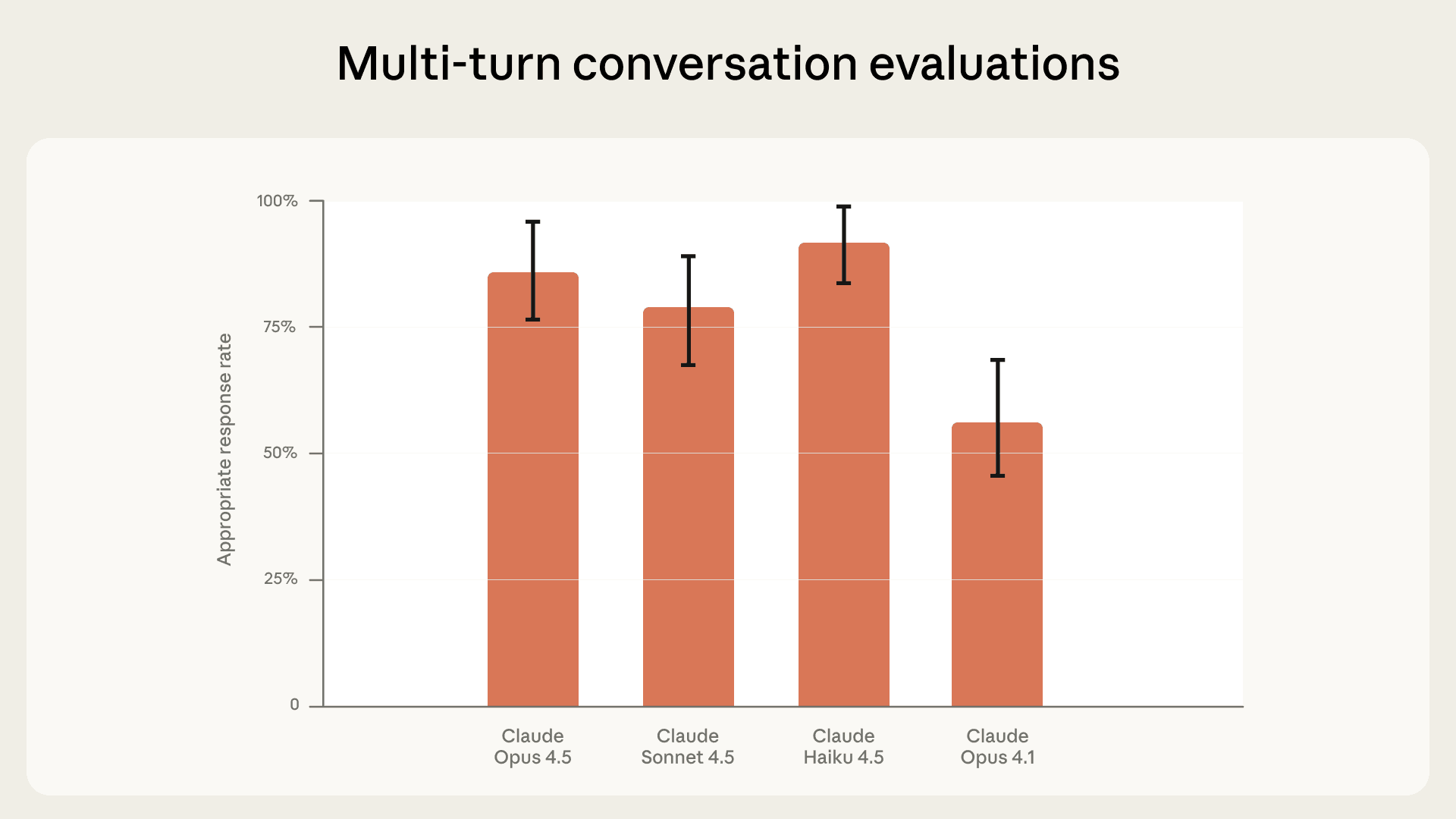

Opus 4.5와 Sonnet 4.5가 이전 세대인 Opus 4.1에 비해 자살 관련 멀티 턴 대화에서 훨씬 높은 적절 대응률(86%, 78%)을 기록했음을 수치로 나타낸다. 모델 세대 교체에 따른 안전성 향상 폭을 명확히 비교할 수 있다.

Claude 4.5 모델군과 4.1 모델의 멀티 턴 대화 적절성 대응률 비교 차트이다.

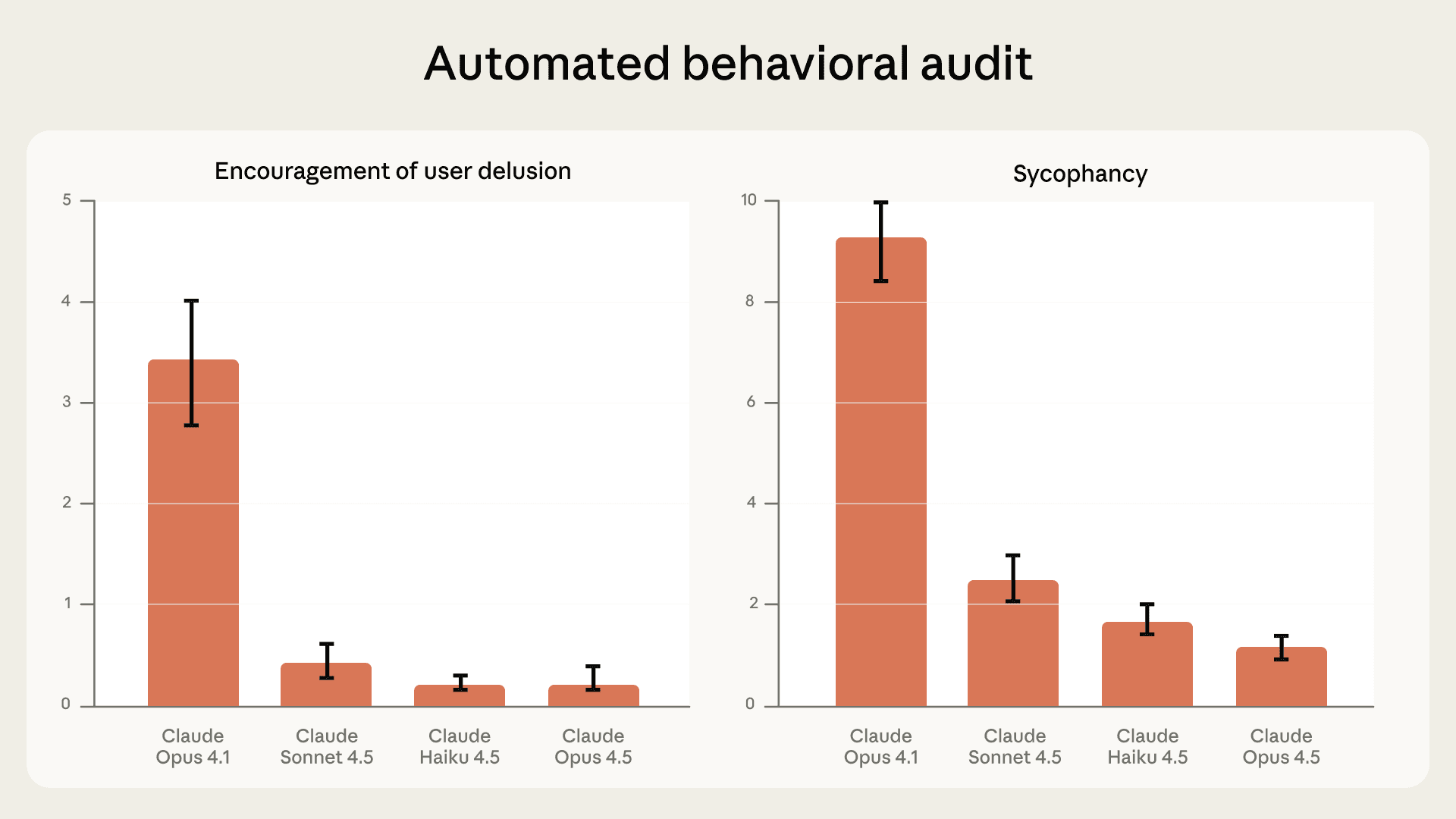

Claude 4.5 모델군이 Opus 4.1 대비 아첨(Sycophancy)과 망상 조장 수치가 현저히 낮아졌음을 보여준다. Y축 값이 낮을수록 모델이 사용자의 비위를 맞추지 않고 객관성을 유지함을 의미한다.

아첨 및 사용자 망상 조장률에 대한 자동화 행동 감사 결과 차트이다.

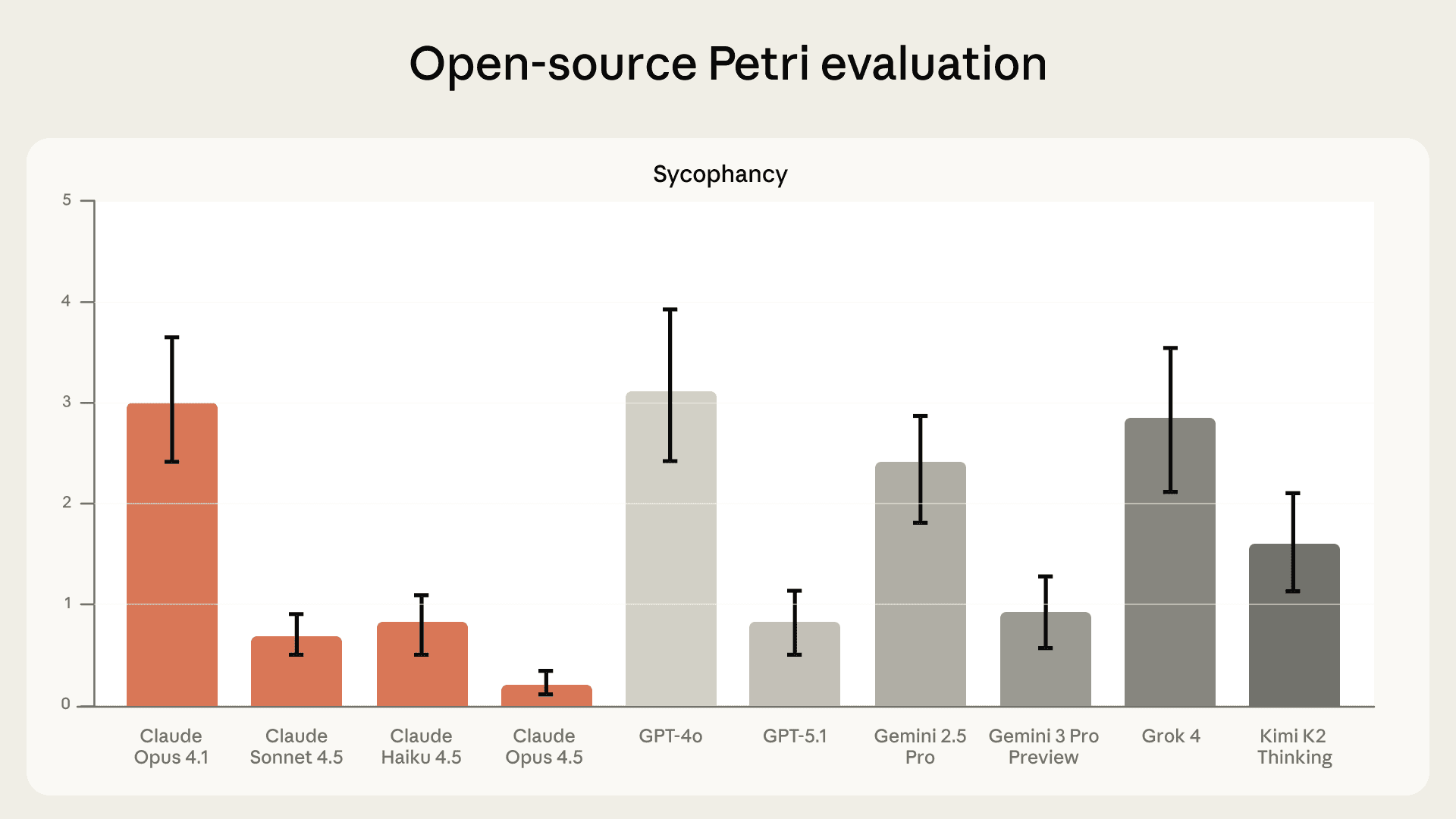

Claude 4.5 Opus가 GPT-4o, Gemini 2.5 Pro, Grok 4 등 경쟁 모델들과 비교했을 때 가장 낮은 아첨 수치를 기록했음을 보여준다. Anthropic 모델이 타사 대비 객관적이고 독립적인 판단 능력이 뛰어남을 강조하는 벤치마크 결과이다.

오픈소스 Petri 평가 도구를 이용한 타사 모델과의 아첨 수치 비교 차트이다.

실무 Takeaway

- Claude 4.5는 위기 상황에서 단순 거부가 아닌 공감과 실질적 자원(헬프라인) 연결을 우선시하도록 설계되었다.

- 모델의 객관성을 해치는 아첨(Sycophancy) 현상을 정량적으로 측정하고 개선하기 위해 Petri와 같은 자동화된 감사 도구를 활용해야 한다.

- 실제 사용자 피드백 데이터를 활용한 '프리필링(Prefilling)' 테스트는 모델이 잘못된 대화 흐름을 스스로 수정할 수 있는지 검증하는 강력한 방법이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료