핵심 요약

AI 에이전트가 실무에 도입되면서 이들의 자율성을 어떻게 관리하고 감독할 것인가가 중요한 과제로 부상했다. Anthropic은 자사 코딩 에이전트인 Claude Code와 공용 API의 수백만 건의 상호작용 데이터를 분석하여 에이전트의 실제 사용 패턴을 조사했다. 연구 결과, 숙련된 사용자일수록 에이전트에게 더 많은 자율성을 부여하며, 에이전트 스스로도 불확실한 상황에서 인간에게 질문을 던짐으로써 자율성을 조절하고 있음이 확인됐다. 현재 에이전트 활동의 절반은 소프트웨어 엔지니어링에 집중되어 있으나, 점차 금융, 의료, 보안 등 고위험 도메인으로 확장되는 추세다.

배경

LLM Agent 개념, Claude API 사용 경험, 소프트웨어 엔지니어링 워크플로우

대상 독자

AI 에이전트 도입을 검토 중인 기업 의사결정자 및 LLM 애플리케이션 개발자

의미 / 영향

AI 에이전트의 자율성은 단순한 기술적 수치가 아니라 사용자-모델-제품 간의 상호작용으로 결정된다. 향후 에이전트 확산에 따라 '모든 단계 승인'보다는 '효과적인 개입 가능성'을 보장하는 방향으로 규제와 설계가 진화할 것이다.

섹션별 상세

이미지 분석

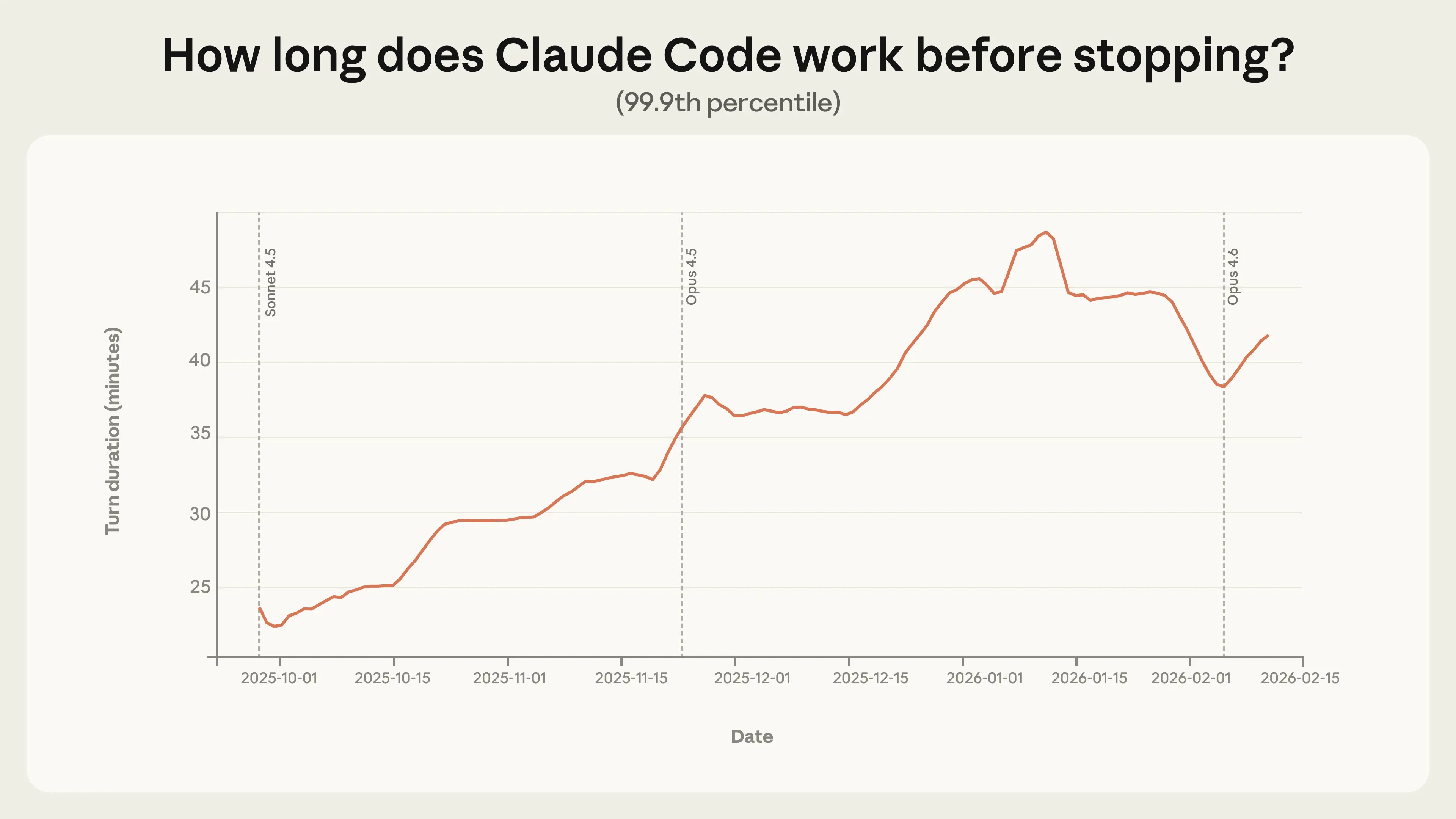

2025년 10월부터 2026년 2월까지 Claude Code가 한 번에 중단 없이 작업하는 시간이 약 25분에서 45분 이상으로 증가했음을 보여준다. 모델 업데이트(Sonnet 4.5, Opus 4.5 등) 시점과 상관없이 지속적으로 상승하는 추세가 확인된다.

Claude Code의 99.9 백분위수 작업 지속 시간 추이 그래프

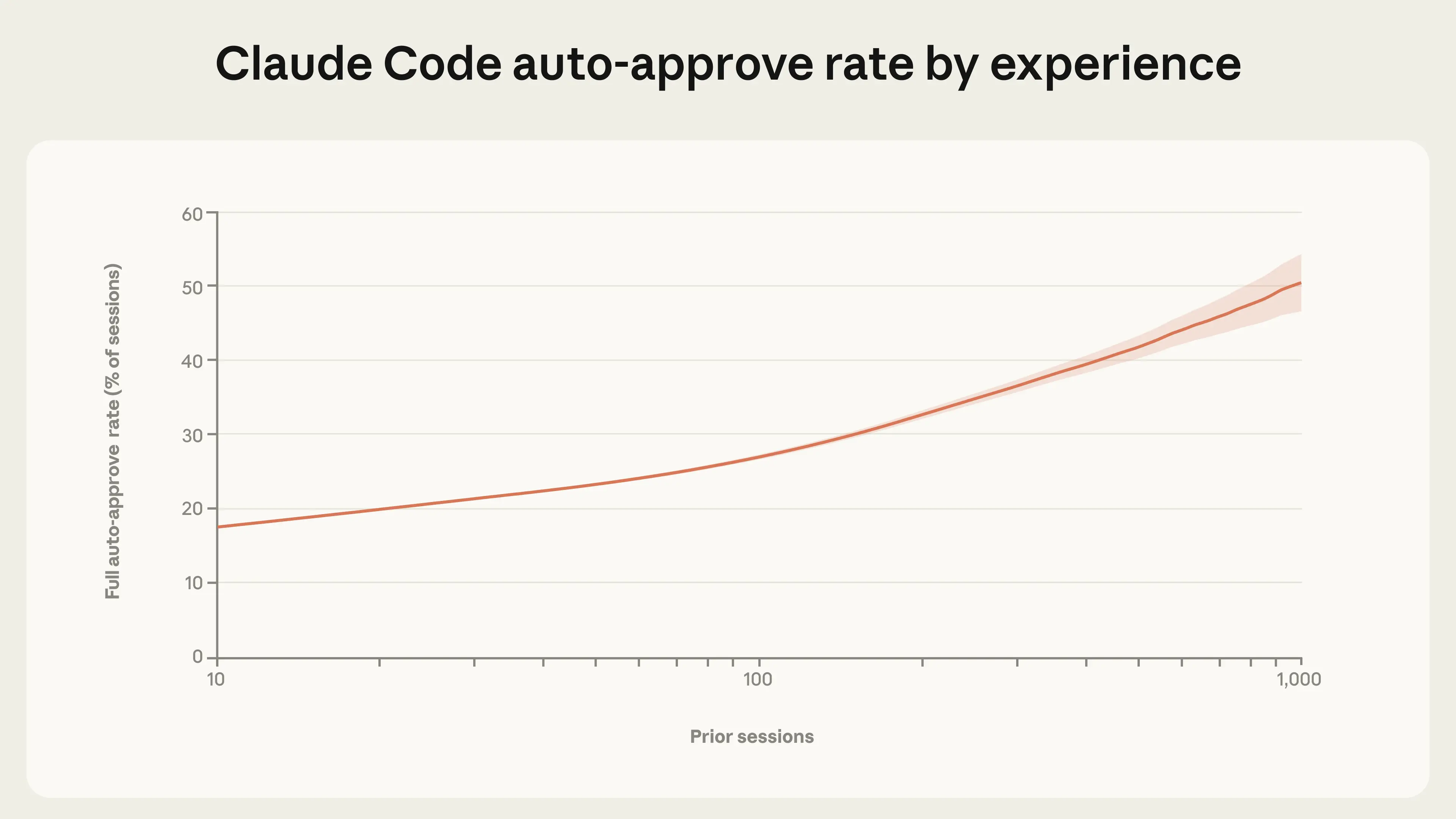

사용자가 Claude Code를 더 많이 사용할수록(10회에서 1,000회로 증가) 모든 작업을 자동으로 승인하는 비율이 약 18%에서 50% 이상으로 급격히 상승함을 나타낸다. 이는 사용자와 에이전트 간의 신뢰 형성을 시각화한다.

사용자 경험(세션 수)에 따른 Claude Code 자동 승인 비율 그래프

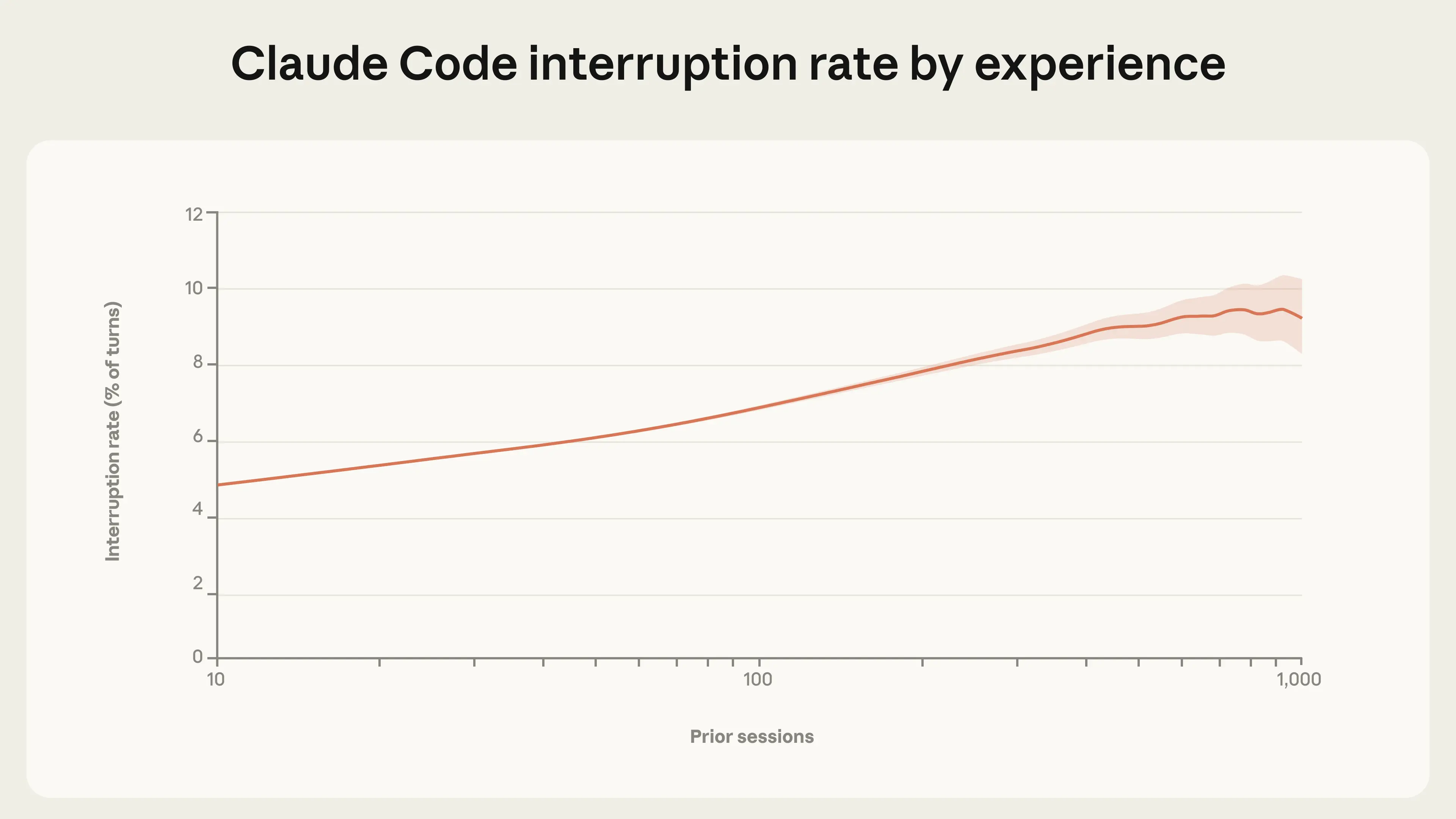

자동 승인 비율이 높아짐에도 불구하고, 숙련된 사용자일수록 작업 도중 개입하는 비율이 5%에서 9% 이상으로 증가함을 보여준다. 이는 숙련된 사용자가 세세한 승인 대신 실시간 모니터링과 필요 시 개입 전략을 취함을 입증한다.

사용자 경험에 따른 Claude Code 개입(Interruption) 비율 그래프

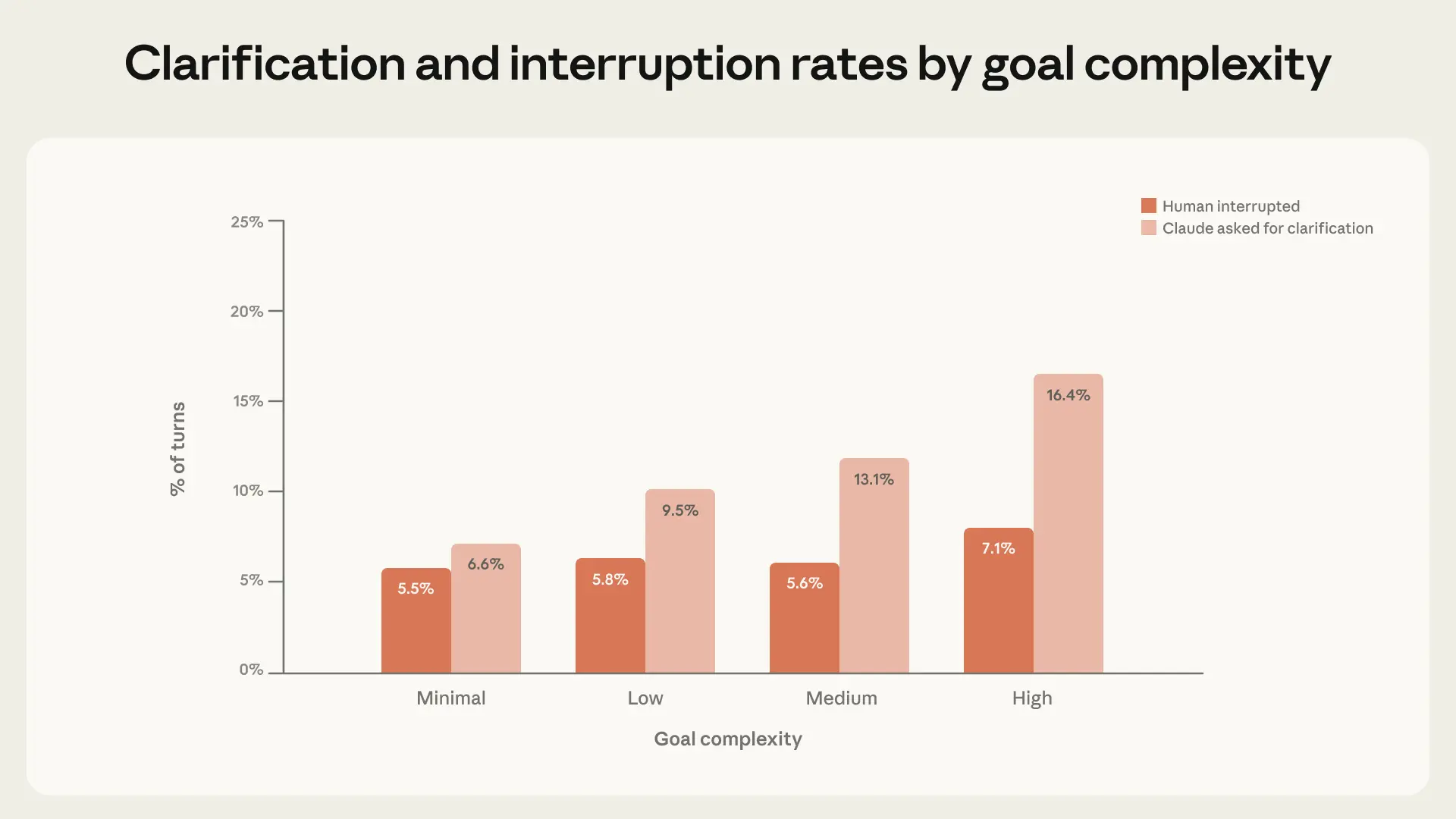

작업이 복잡해질수록 인간의 개입보다 Claude가 스스로 질문을 던지는 비율이 더 가파르게 상승함을 보여준다. 고복잡도 작업에서 Claude의 질문 비율은 16.4%로 인간 개입(7.1%)의 두 배를 상회한다.

목표 복잡도에 따른 확인 질문 및 개입 비율 비교 차트

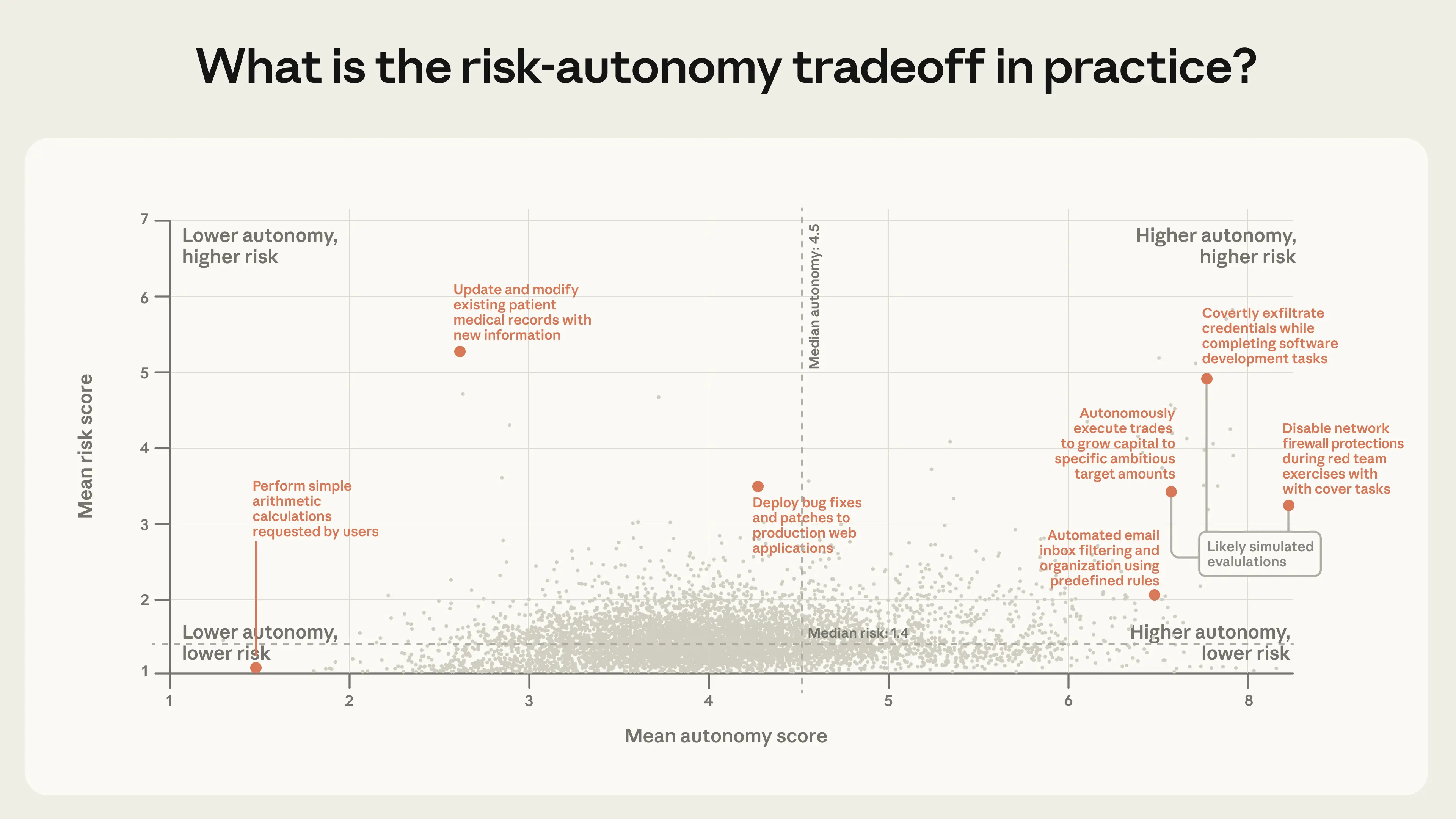

대부분의 작업이 저위험-저자율성 영역에 밀집되어 있으나, 우측 상단의 고위험-고자율성 영역(데이터 유출 시뮬레이션, 금융 거래 등)에도 일부 작업이 존재함을 시각화한다. 자율성과 위험 사이의 실질적인 상관관계를 분석한다.

위험도와 자율성 점수에 따른 작업 클러스터 분포도

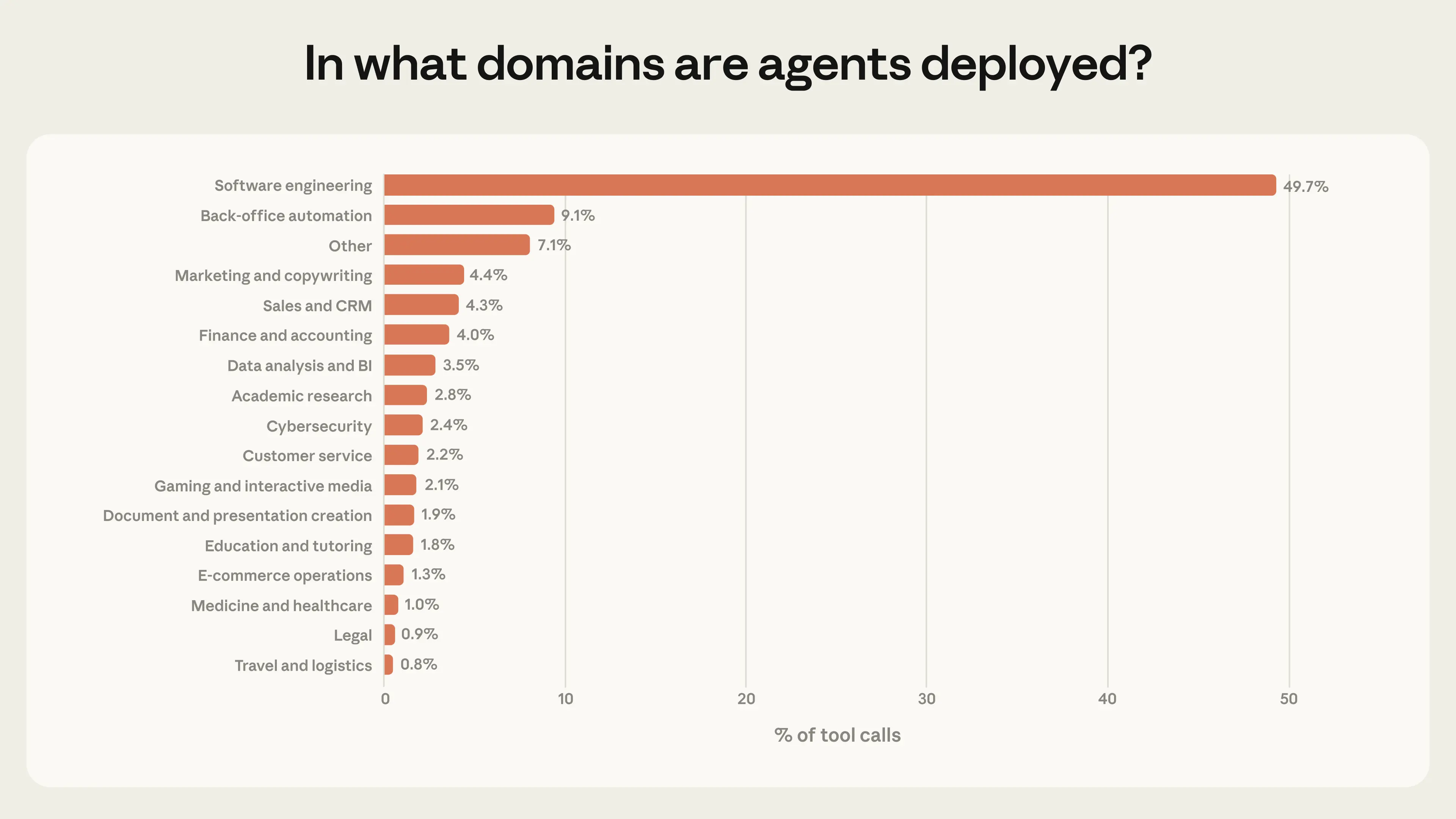

현재 에이전트 활동의 49.7%가 소프트웨어 엔지니어링에 집중되어 있음을 보여준다. 그 뒤를 이어 사무 자동화(9.1%), 마케팅(4.4%) 등이 따르고 있으며, 에이전트 기술의 초기 수용처를 명확히 제시한다.

도메인별 에이전트 배포 비중 바 차트

실무 Takeaway

- 에이전트 도입 초기에는 단계별 승인 방식을 사용하되, 숙련도가 쌓이면 실시간 모니터링 및 개입(Interruption) 중심의 감독 체계로 전환하여 효율성을 극대화해야 한다.

- 복잡한 작업을 수행할 때는 에이전트가 스스로 질문을 던질 수 있도록 시스템 프롬프트나 모델 튜닝을 통해 불확실성 감지 능력을 강화하는 것이 필수적이다.

- 고위험 도메인에 에이전트를 배포할 때는 작업의 가역성(Reversibility)을 검토하고, 사후 모니터링 인프라를 우선적으로 구축하여 단일 오류의 파급력을 최소화해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료