핵심 요약

AI 모델의 급격한 발전으로 인해 기존의 기술 채용 테스트가 변별력을 잃고 있다. Anthropic의 성능 엔지니어링 팀은 시뮬레이션된 가속기 최적화 과제를 통해 인재를 선발해 왔으나, 최신 모델인 Claude Opus 4.5가 상위권 지원자의 성과를 추월하면서 테스트 설계의 근본적인 변화가 필요해졌다. 이에 Anthropic은 AI의 학습 데이터에 없는 독창적이고 제약이 심한 프로그래밍 퍼즐 형태의 새로운 테스트를 도입하여 인간의 창의적 문제 해결 능력을 검증하고 있다. 이 과정은 AI 시대에 인간 전문가를 식별하기 위한 평가 설계의 어려움과 방향성을 잘 보여준다.

배경

하드웨어 아키텍처(VLIW, SIMD) 기초 지식, 성능 최적화 및 프로파일링 개념, LLM의 추론 능력 및 벤치마킹에 대한 이해

대상 독자

AI/ML 엔지니어, 기술 채용 담당자, 성능 최적화 전문가

의미 / 영향

이 사례는 AI가 인간의 전문 영역을 빠르게 잠식함에 따라 기술 면접의 패러다임이 지식과 숙련도에서 창의적 문제 해결과 도구 설계로 이동해야 함을 시사한다. 기업들은 자사 모델의 성능 향상에 맞춰 평가 시스템을 지속적으로 업데이트해야 하는 과제에 직면했다.

섹션별 상세

이미지 분석

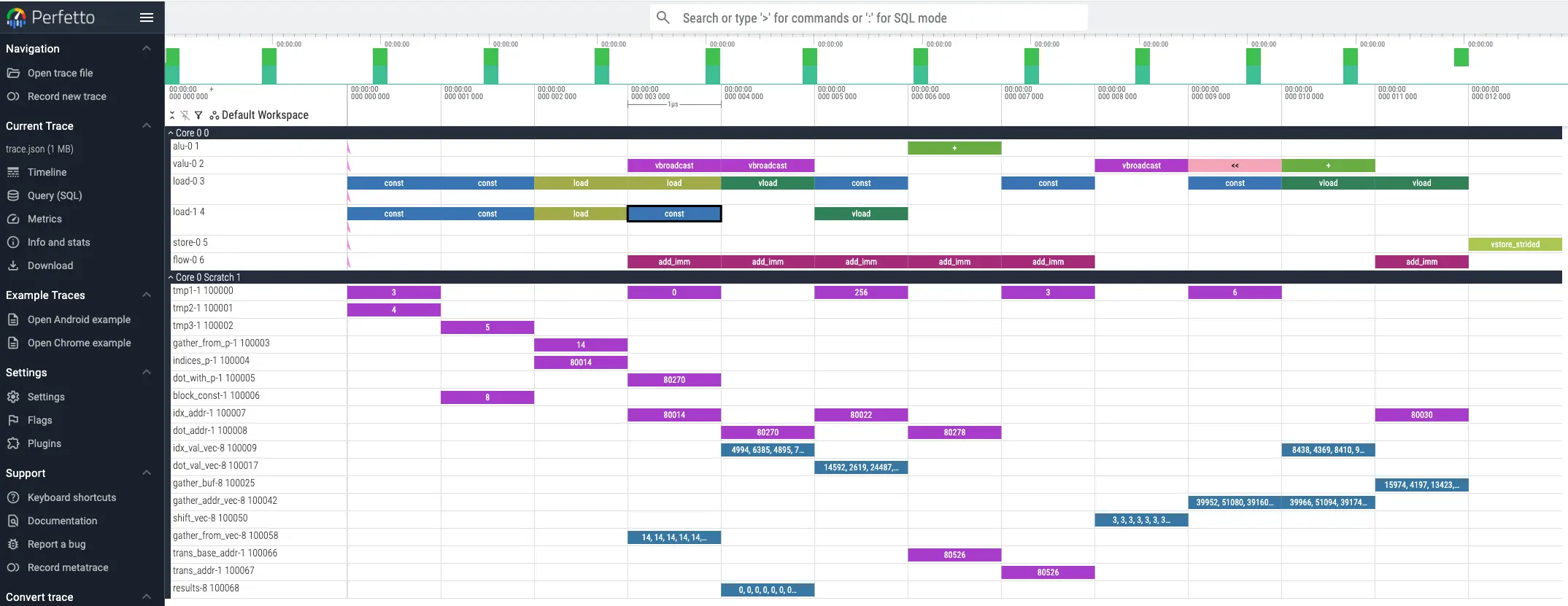

가상 가속기 코어에서 실행되는 vload, vbroadcast, add_imm 등의 명령어 흐름을 보여준다. 지원자들이 성능 병목을 분석하고 최적화 기회를 찾기 위해 사용하는 실제 분석 환경을 시각적으로 설명한다.

Perfetto UI를 통해 시각화된 가상 가속기의 명령어 실행 타임라인이다.

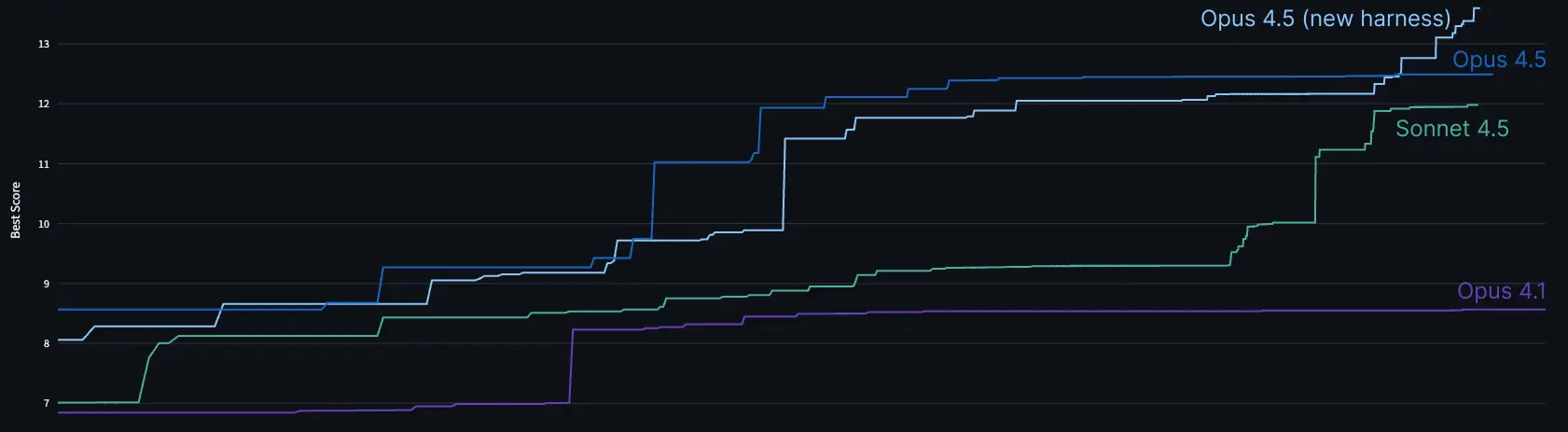

Claude Opus 4.1부터 4.5까지 모델이 발전함에 따라 테스트 점수가 어떻게 상승했는지 보여준다. 특히 Opus 4.5가 인간의 최고 수준 성과에 도달했음을 증명하여 테스트 재설계의 필요성을 뒷받침한다.

Claude 모델 버전별 성능 최적화 점수 변화를 나타내는 그래프이다.

실무 Takeaway

- AI 모델의 발전으로 정형화된 코딩 테스트는 변별력을 상실했으므로 AI가 학습하지 않은 독창적인 제약 조건을 가진 문제를 설계해야 한다.

- 채용 평가 시 AI 사용을 금지하기보다 AI를 도구로 활용하여 더 높은 수준의 결과물을 도출하는 AI 협업 및 도구 설계 능력을 측정하는 것이 실무에 적합하다.

- 성능 최적화 분야에서 인간 전문가는 여전히 AI보다 높은 한계 성능을 달성할 수 있으나 이를 검증하기 위해서는 더 긴 시간 지평과 복잡한 문제 구조가 필요하다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료