핵심 요약

AI 에이전트는 도구 사용과 상태 변경을 수반하는 다회차(multi-turn) 특성 때문에 기존 LLM 평가보다 복잡한 구조를 가진다. Anthropic은 에이전트 성능을 객관적으로 측정하기 위해 자동화된 평가 하네스와 다양한 채점자, 궤적 분석을 포함한 체계적인 접근법을 도입했다. 이 시스템은 모델 업그레이드나 프롬프트 변경 시 발생할 수 있는 성능 퇴보를 방지하고 지속적인 품질 향상을 가능하게 한다. 에이전트의 자율성과 지능이 높아질수록 정교한 평가 설계가 개발 속도를 결정하는 핵심 요소로 작용한다.

배경

LLM 추론 및 API 활용 기초, 단위 테스트(Unit Testing) 및 소프트웨어 테스팅 개념, AI 에이전트 및 도구 사용(Tool Use) 아키텍처 이해

대상 독자

AI 에이전트 프로덕션 개발자 및 ML 엔지니어

의미 / 영향

이 가이드는 에이전트 개발의 불확실성을 제거하고 정량적 지표 기반의 의사결정을 가능하게 한다. 체계적인 평가 시스템은 모델 교체 주기를 단축시키고 복잡한 자율 시스템의 안정적인 배포를 지원하는 인프라가 된다.

섹션별 상세

이미지 분석

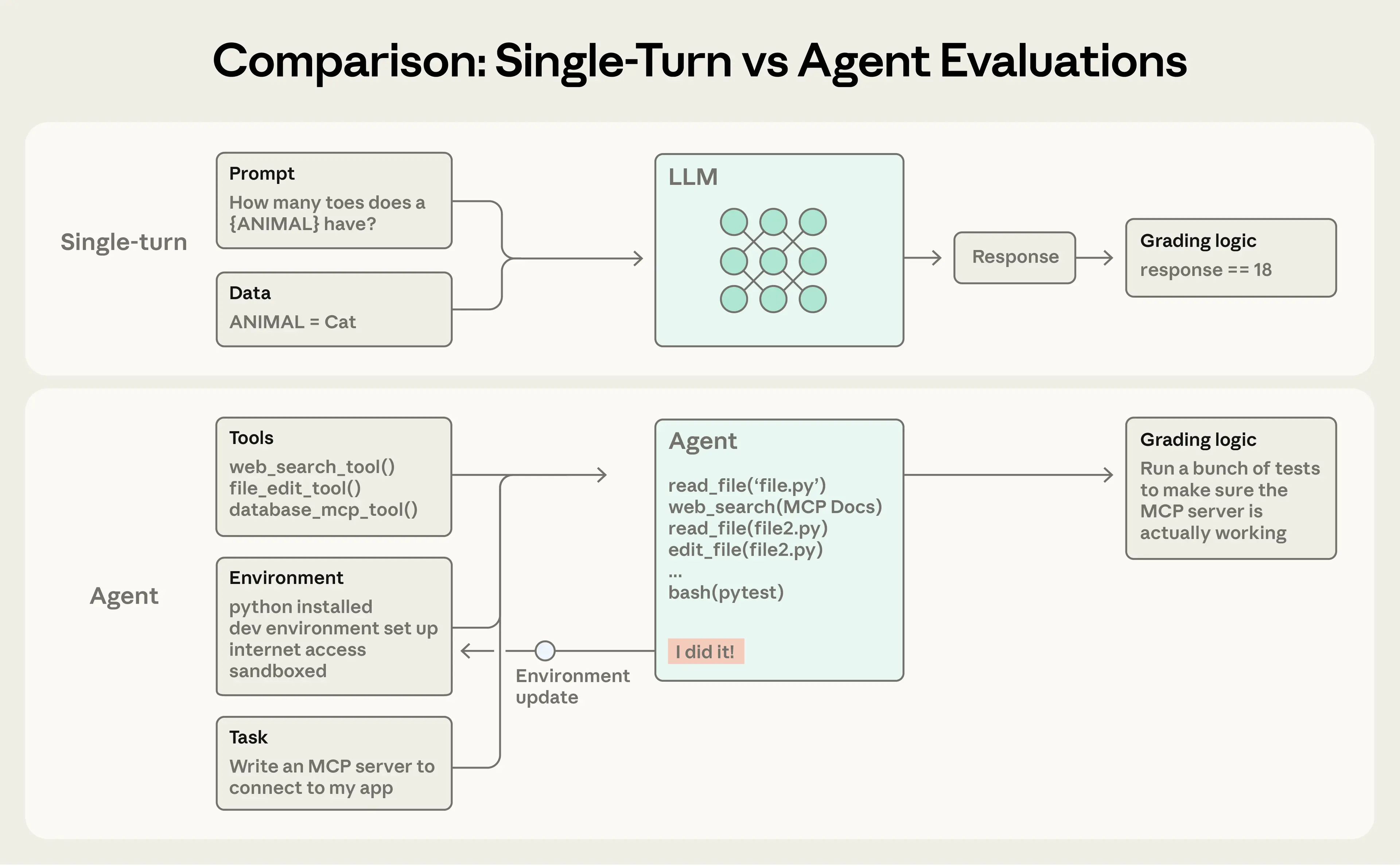

단순 프롬프트-응답 구조인 단일 회차 평가와 달리, 에이전트 평가는 도구 사용, 환경 업데이트, 다회차 루프를 포함하는 복잡한 과정을 거친다. 이는 에이전트 평가가 환경과의 상호작용을 반드시 고려해야 함을 시각적으로 나타낸다.

단일 회차 평가와 에이전트 평가의 구조적 차이를 비교한 다이어그램이다.

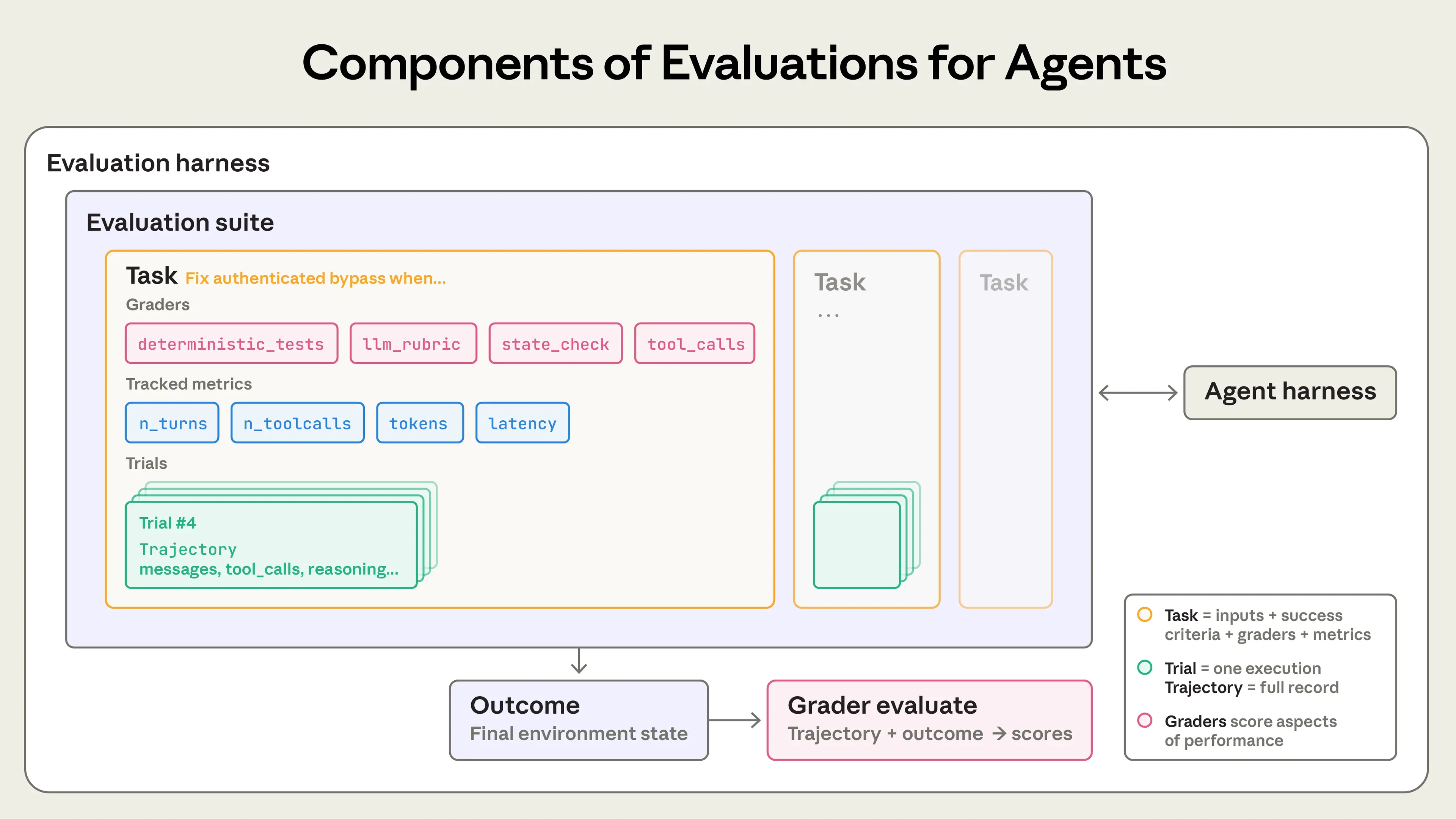

평가 하네스 내에서 개별 태스크가 어떻게 시도(Trial)와 궤적(Trajectory)으로 연결되고, 최종적으로 채점자에 의해 점수화되는지 전체 워크플로우를 정의한다. 시스템 구축 시 필요한 핵심 데이터 모델을 이해하는 데 도움을 준다.

에이전트 평가 시스템을 구성하는 태스크, 시도, 채점자, 지표 등의 계층 구조를 보여준다.

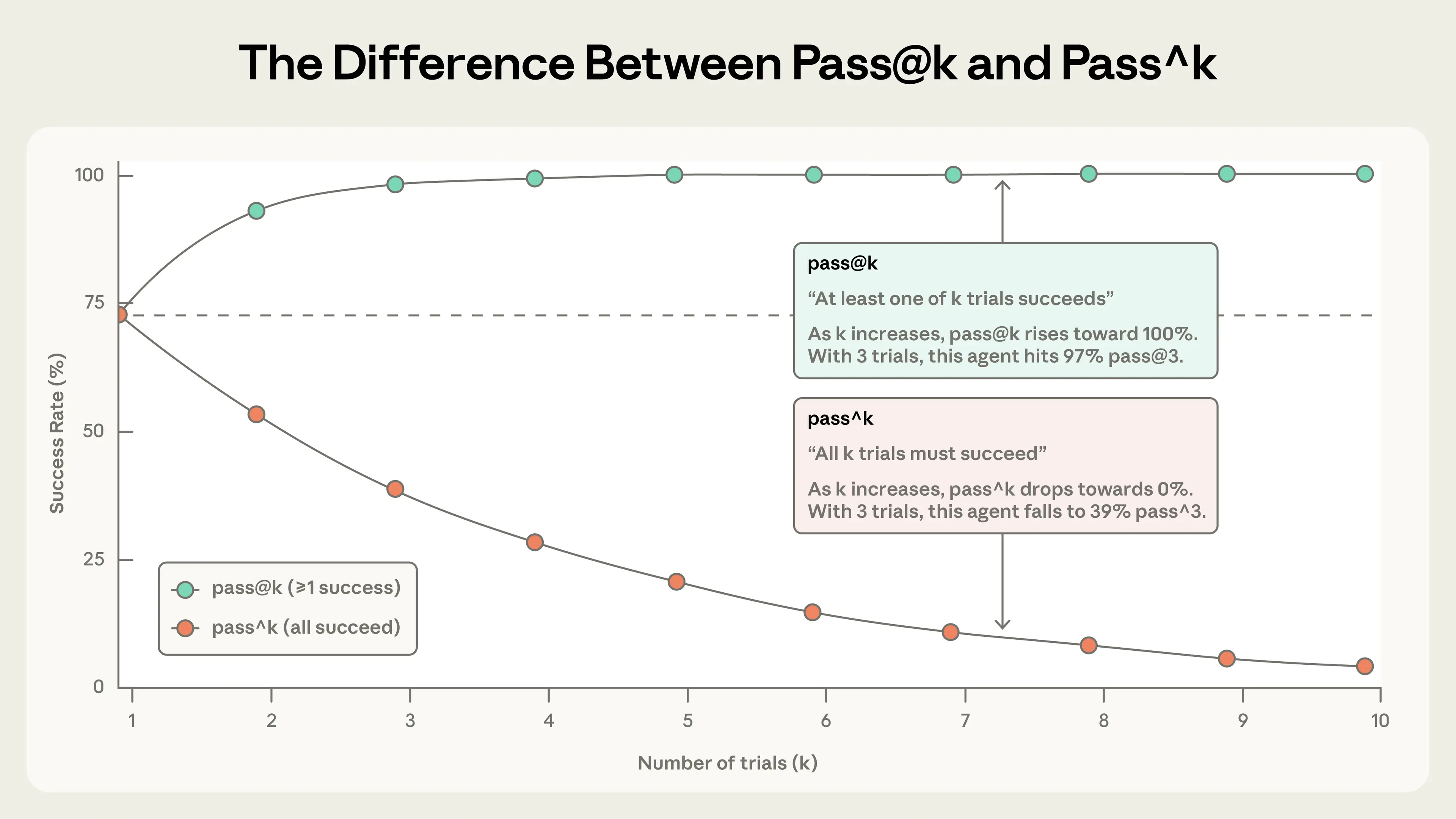

Pass@k는 시도가 늘어날수록 100%에 수렴하지만, Pass^k는 급격히 하락하는 양상을 보인다. 이는 에이전트가 우연히 성공하는 것과 일관되게 성공하는 것 사이의 성능 차이를 명확히 구분해야 함을 입증한다.

시도 횟수(k) 증가에 따른 Pass@k와 Pass^k 지표의 변화 추이를 나타낸 그래프이다.

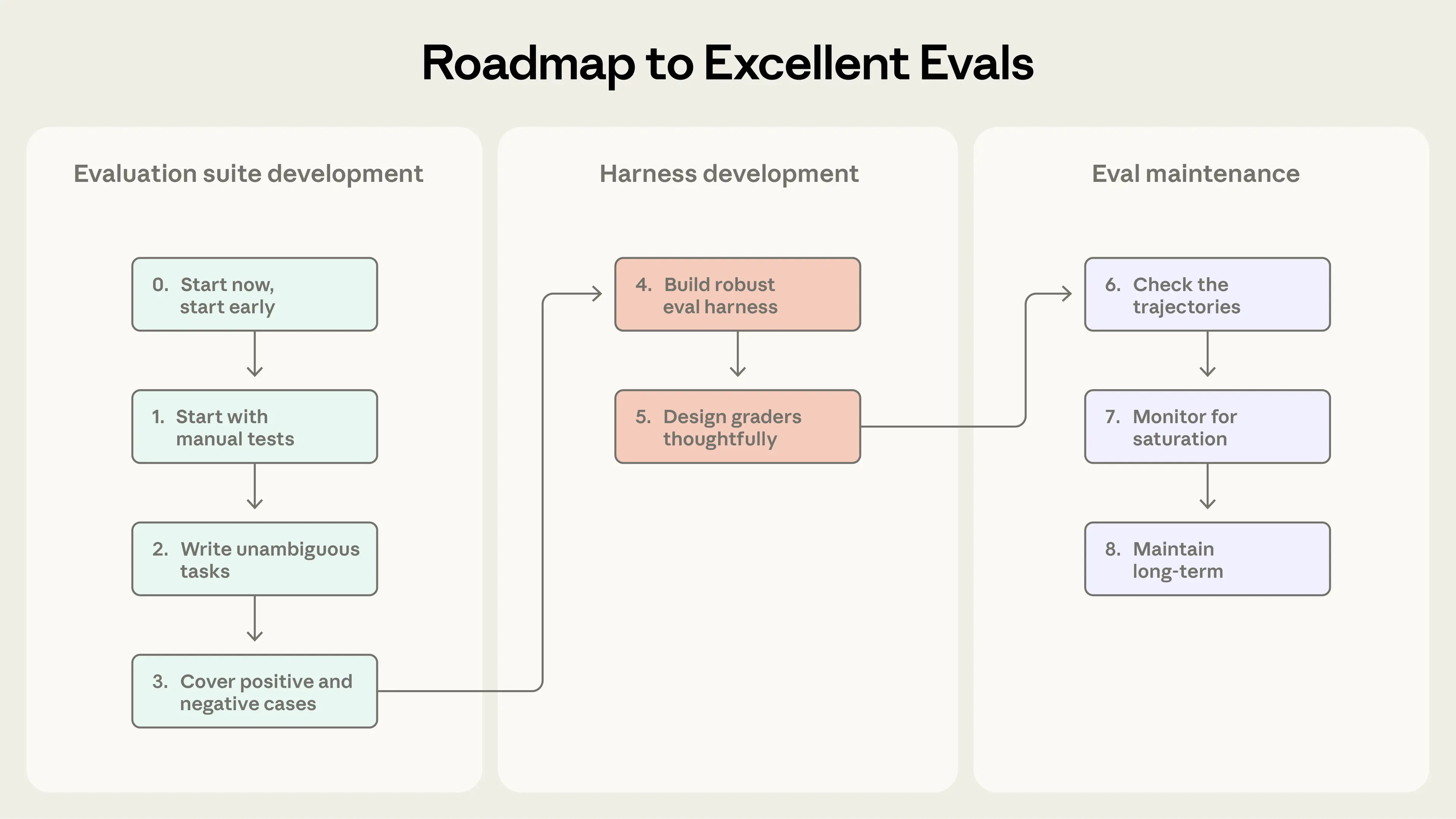

수동 테스트에서 시작하여 하네스 구축, 채점자 설계, 궤적 점검, 장기 유지보수로 이어지는 단계적 접근법을 제시한다. 개발팀이 평가 시스템을 어느 시점에 어떻게 고도화해야 하는지 가이드라인을 제공한다.

평가 스위트 개발부터 유지보수까지 이어지는 8단계 로드맵 흐름도이다.

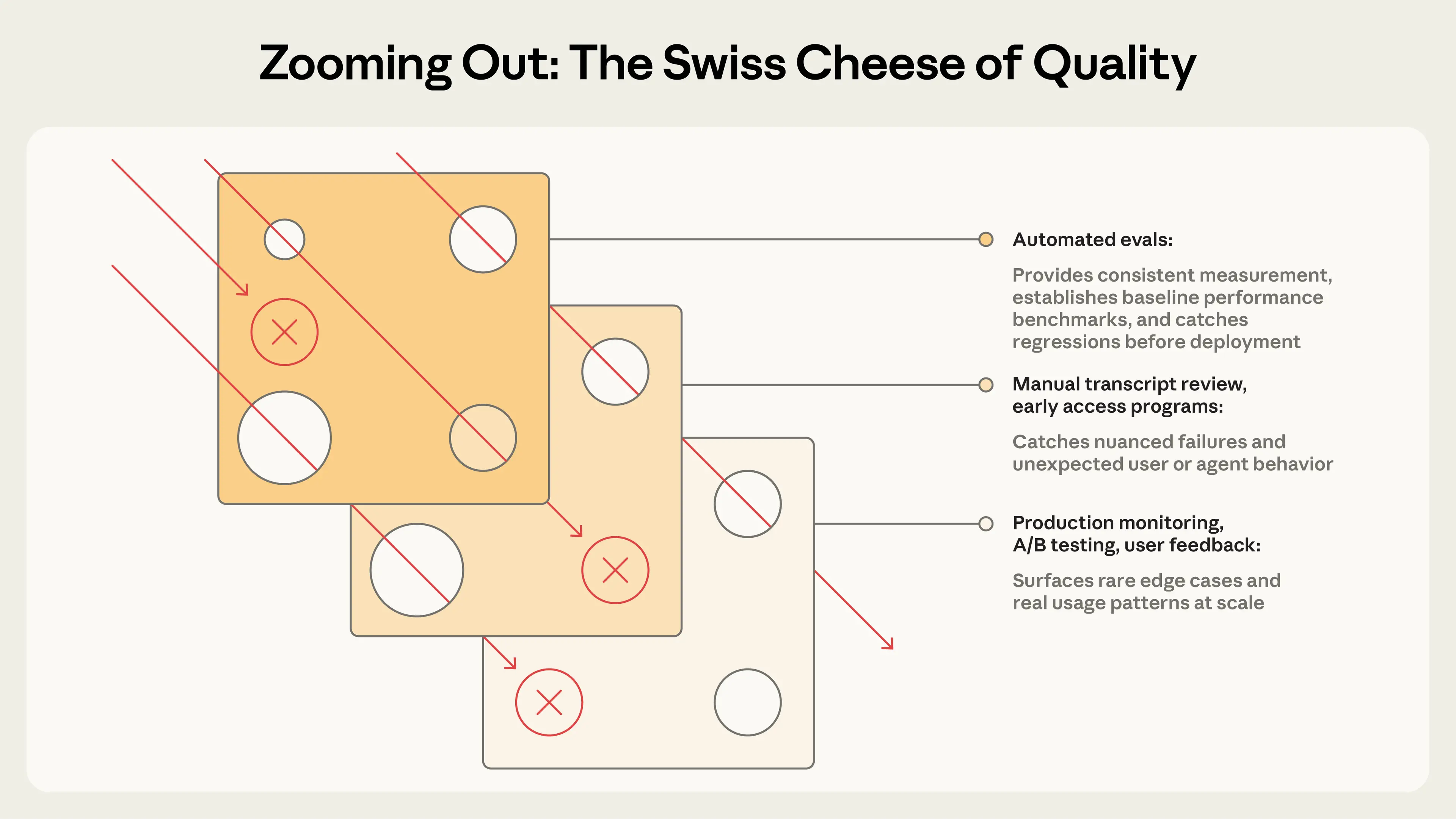

각 평가 레이어가 가진 한계를 다른 레이어가 보완하는 다층 방어 구조를 시각화했다. 자동화된 평가만으로는 잡을 수 없는 미묘한 오류를 수동 검토와 모니터링으로 보완해야 함을 나타낸다.

자동 평가, 수동 검토, 프로덕션 모니터링이 결합된 스위스 치즈 품질 모델을 설명한다.

실무 Takeaway

- Pass@k 지표로 에이전트의 잠재 성능을 확인하고, Pass^k로 실제 운영 환경에서의 일관된 신뢰성을 확보한다.

- 최종 결과물인 Outcome뿐만 아니라 도구 사용 과정인 Trajectory를 함께 채점하여 에이전트의 추론 품질을 관리한다.

- 자동 평가, 수동 검토, 프로덕션 모니터링을 결합한 다층적 품질 관리 체계인 스위스 치즈 모델을 구축하여 예외 상황에 대비한다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료