핵심 요약

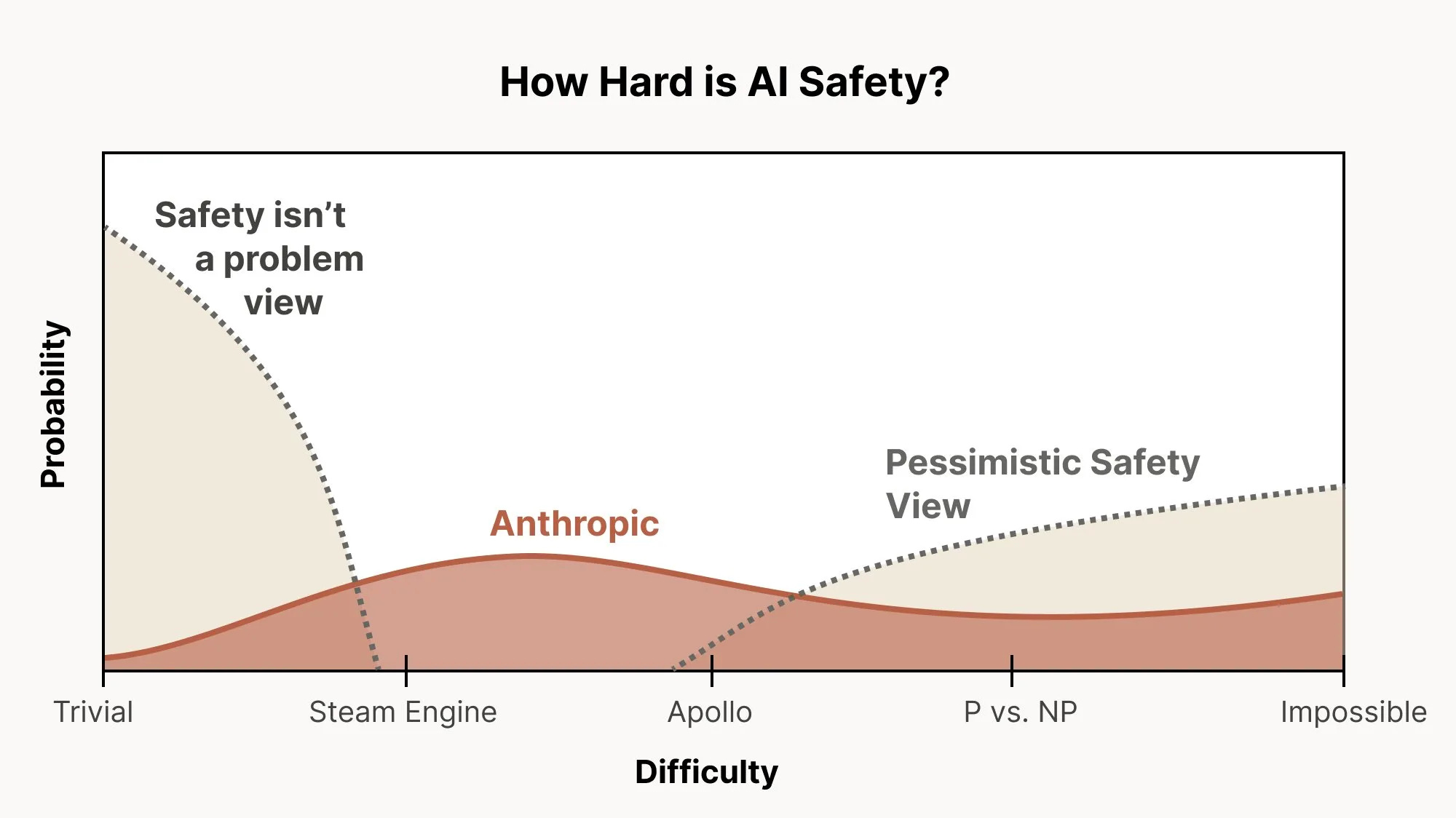

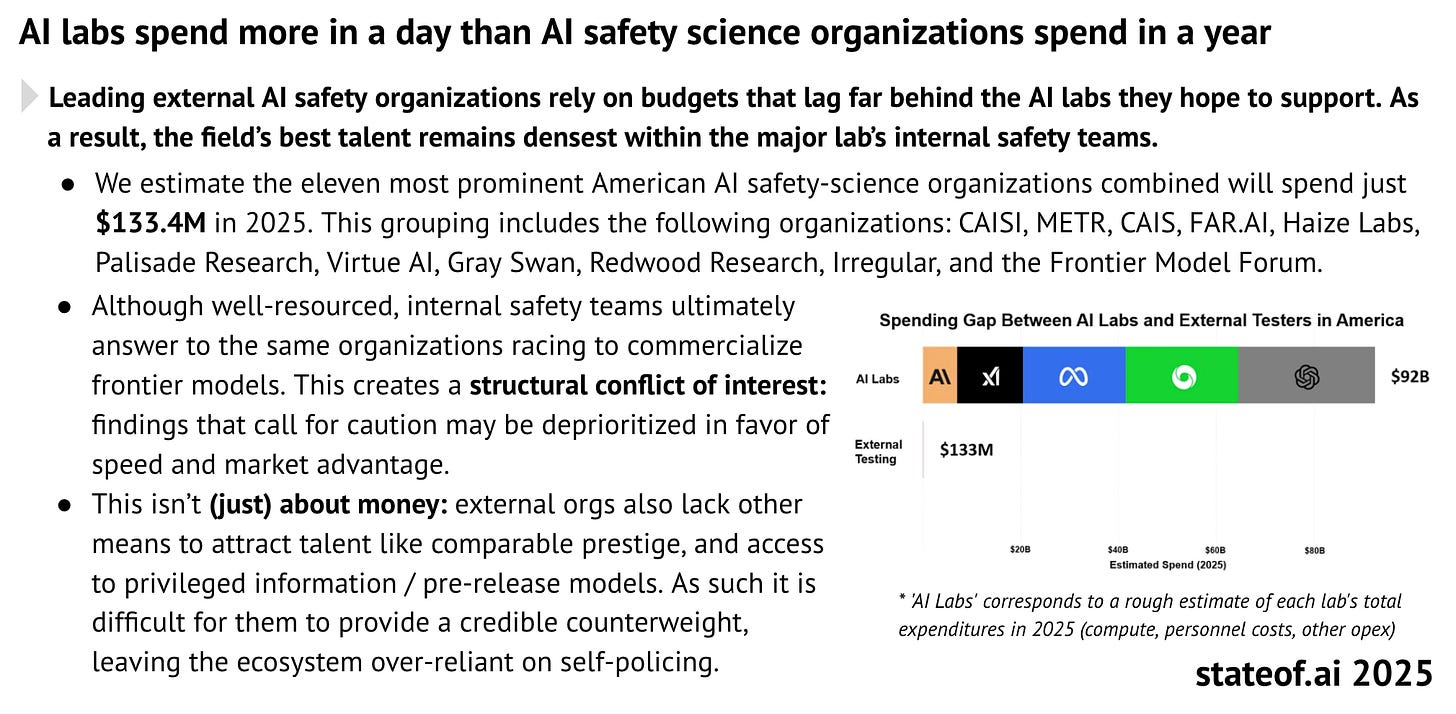

AI 산업의 주도권이 연구자 중심의 노동에서 주주 중심의 자본으로 급격히 이동하면서 AI 안전성이 존립의 위기에 처했다. Anthropic과 OpenAI 같은 주요 기업들이 6~18개월 내에 상장을 앞둔 상황에서, 시장의 수익성 압박은 안전성 연구를 단순한 비용이나 출시 장애물로 치부하게 만든다. 현재 안전성을 지탱하는 유일한 보루인 연구자들의 노동 레버리지는 AI 자동화로 인해 급격히 약화되고 있으며, 정부 규제 또한 실효성을 잃고 있다. 따라서 향후 1년 내에 안전성을 도덕적 의무가 아닌 상업적 해자로 재구축하지 못한다면, AI 안전성은 영구적으로 시장 논리에 밀려날 위험이 크다.

배경

AI 정렬(Alignment)의 기본 개념, LLM 시장의 경쟁 구도, AI 규제 동향

대상 독자

AI 정책 입안자, AI 안전성 연구자, 기술 투자자 및 전략가

의미 / 영향

AI 안전성이 자발적 약속이나 도덕적 호소에 의존하던 시대를 지나, 시장 경제 시스템 내에서 실질적인 가치를 증명해야 하는 생존의 기로에 섰음을 시사한다. 특히 주요 AI 기업들의 IPO는 안전성 연구의 독립성을 훼손할 수 있는 강력한 변곡점이 될 것이다.

섹션별 상세

실무 Takeaway

- AI 안전성을 단순한 도덕적 의무가 아닌, 기업의 책임 보험이나 인증 체계와 같은 상업적 해자로 재구축해야 시장 경제 시스템에서 지속 가능하다.

- 향후 12개월 내에 안전성 프로토콜을 기술적 인프라와 기업 운영 표준에 깊이 내재화하여, 상장 이후의 시장 압력에도 견딜 수 있는 구조를 확립해야 한다.

- 인간 연구자의 개입 없는 완전 자동화된 안전성 연구는 모델의 기만적 행동을 포착하기 어려우므로, 인간과 AI가 협력하는 하이브리드 검증 체계를 유지해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.