핵심 요약

LLM 애플리케이션이 복잡해짐에 따라 단일 에이전트의 컨텍스트 관리와 팀 간 협업에 한계가 발생한다. LangChain은 이를 해결하기 위해 서브에이전트, 스킬, 핸드오프, 라우터라는 4가지 주요 멀티 에이전트 아키텍처 패턴을 제시한다. 각 패턴은 중앙 집중식 제어, 온디맨드 지식 로드, 상태 기반 전환, 병렬 실행 등 고유한 특성을 가지며 작업의 복잡도와 요구사항에 따라 선택해야 한다. 성능 분석 결과, 반복 요청에는 상태 유지형 패턴이 유리하고 다중 도메인 쿼리에는 병렬 실행형 패턴이 효율적임이 확인되었다.

배경

LLM 프롬프트 엔지니어링 기본 지식, 에이전트 및 도구 호출(Tool Calling) 개념 이해, LangChain 프레임워크에 대한 기초 지식

대상 독자

LLM 애플리케이션 아키텍처를 설계하는 개발자 및 시스템 설계자

의미 / 영향

이 가이드는 복잡한 LLM 시스템의 성능과 비용을 최적화할 수 있는 구체적인 설계 패턴을 제공하여, 기업용 AI 에이전트의 실용성을 높이는 데 기여한다. 특히 컨텍스트 관리와 팀 간 협업 문제를 아키텍처 수준에서 해결할 수 있는 기준을 제시한다.

섹션별 상세

이미지 분석

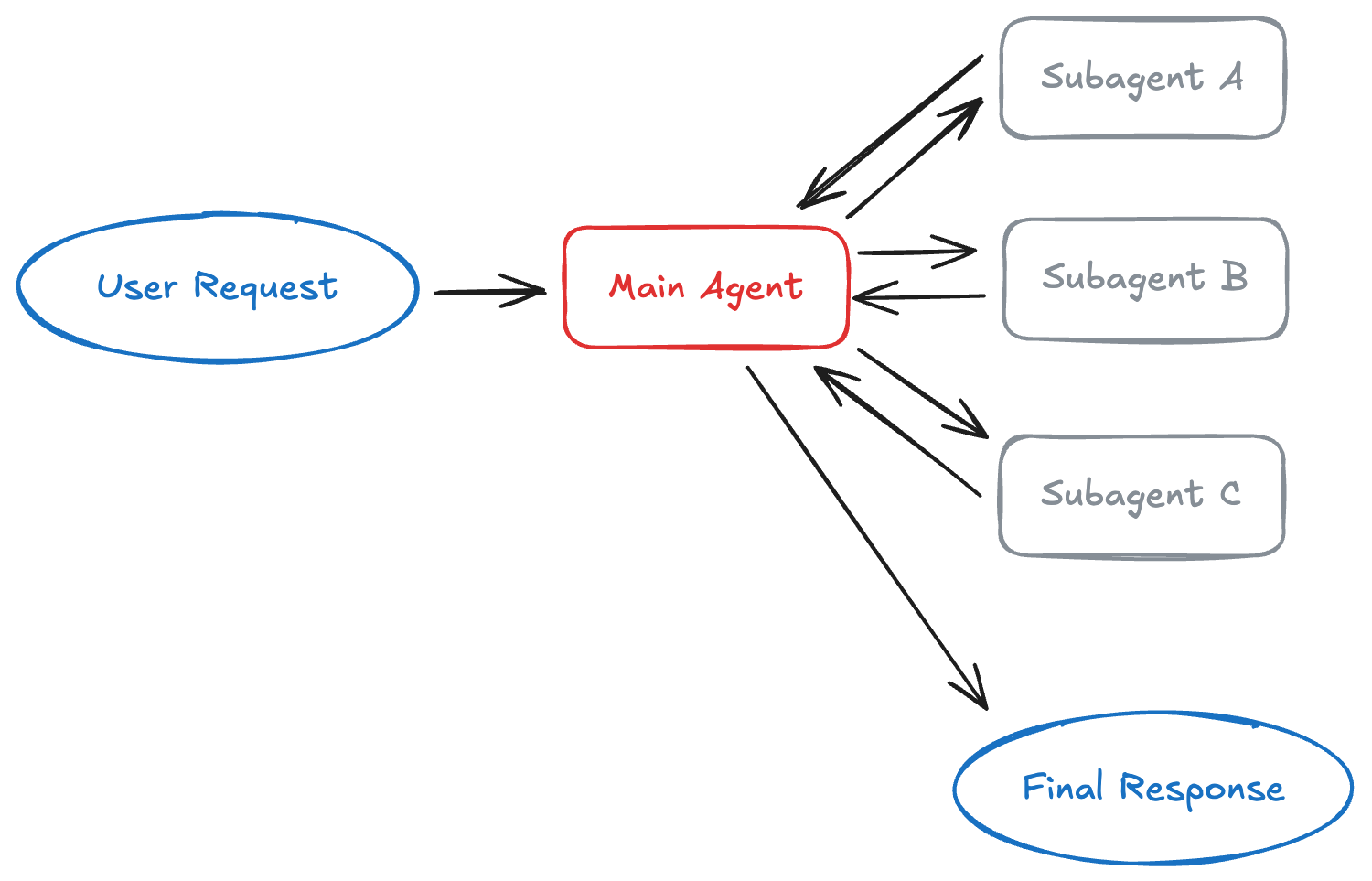

서브에이전트 패턴의 핵심인 중앙 제어 방식을 시각화한다. 메인 에이전트가 사용자 요청을 받아 적절한 서브에이전트(A, B, C)에게 작업을 할당하고 결과를 취합하여 최종 응답을 생성하는 흐름을 설명한다.

메인 에이전트가 여러 서브에이전트를 도구처럼 호출하는 중앙 집중식 오케스트레이션 구조를 보여주는 다이어그램이다.

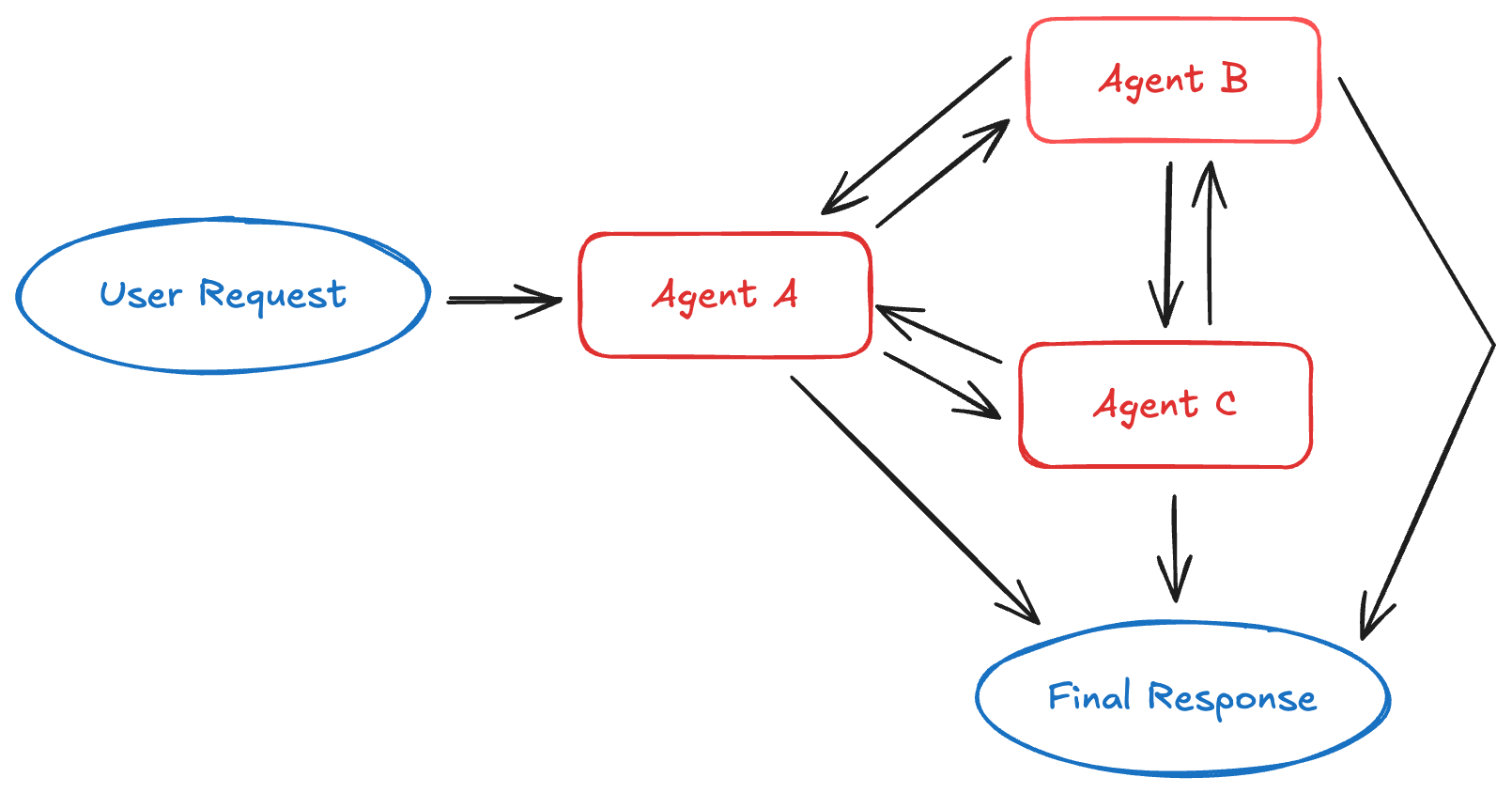

에이전트 A가 작업을 수행하다가 필요에 따라 에이전트 B나 C로 실행 컨텍스트를 완전히 넘기는 방식을 설명한다. 이는 순차적인 워크플로우나 단계별 고객 지원 시스템 구축에 필수적인 구조임을 나타낸다.

에이전트 간에 직접 제어권을 넘겨주는 핸드오프(Handoffs) 패턴의 상태 기반 전환 구조를 보여준다.

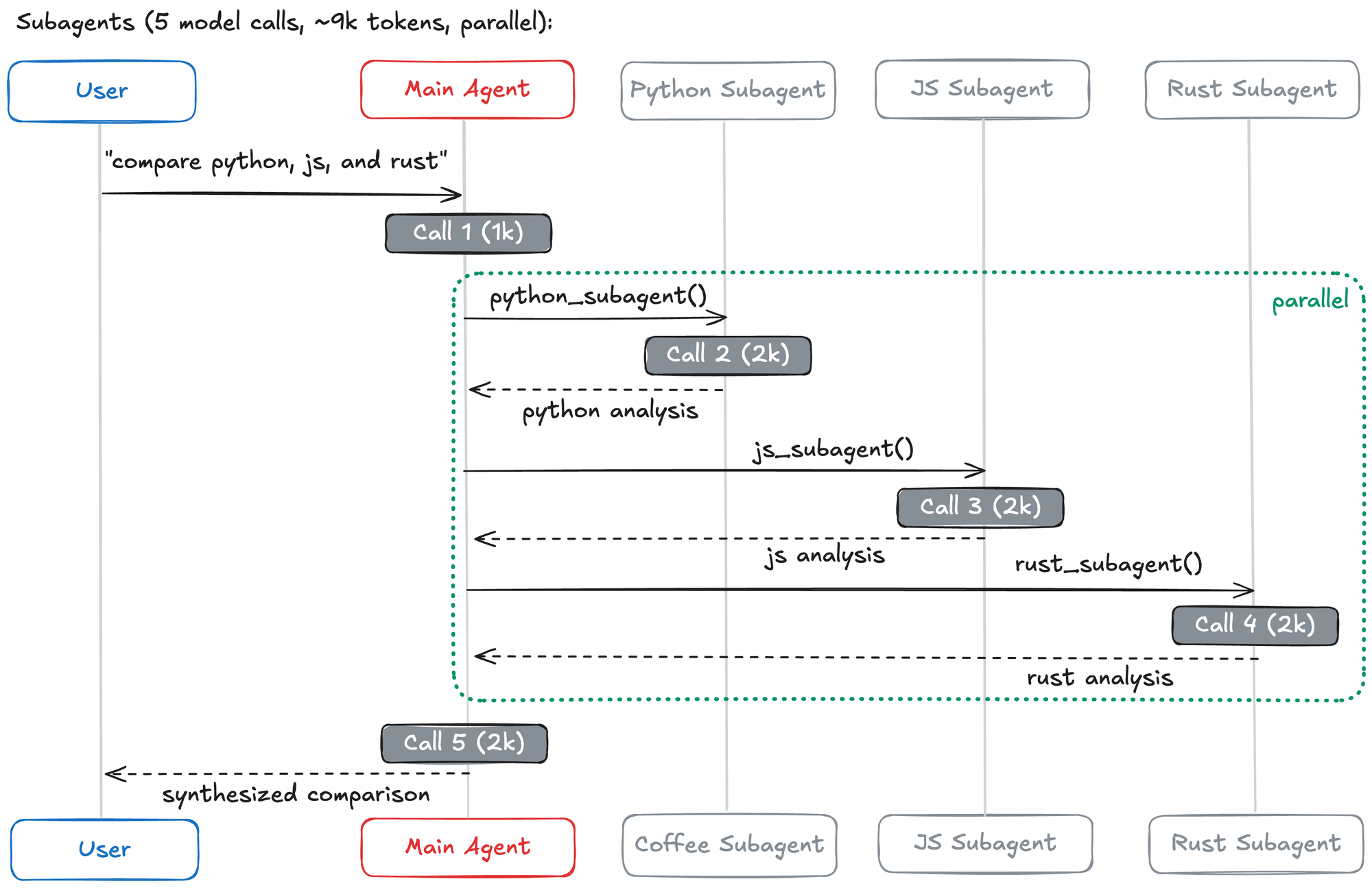

Python, JS, Rust 등 여러 언어를 비교하는 요청에서 메인 에이전트가 각 언어별 서브에이전트를 병렬로 호출하는 과정을 보여준다. 각 서브에이전트가 독립된 컨텍스트를 사용함으로써 전체 토큰 사용량을 67% 절감할 수 있음을 수치로 증명한다.

다중 도메인 쿼리 시 서브에이전트 패턴의 병렬 실행 시퀀스와 토큰 사용량을 분석한 도표이다.

실무 Takeaway

- 에이전트 시스템 구축 시 단일 에이전트와 프롬프트 엔지니어링으로 시작하고, 명확한 한계에 부딪혔을 때만 멀티 에이전트로 전환한다.

- 반복적인 사용자 요청이 많은 서비스라면 상태 유지형인 핸드오프(Handoffs)나 스킬(Skills) 패턴을 적용하여 비용을 절감한다.

- 여러 도메인의 정보를 동시에 처리해야 하는 복잡한 시스템은 서브에이전트나 라우터 패턴을 통해 병렬 처리를 구현한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료