핵심 요약

기존의 노드당 단일 모델 배치 방식은 여러 모델이 협업하는 현대적 에이전트 AI 환경에서 높은 지연 시간과 비용 문제를 야기한다. 삼바노바(SambaNova)는 이를 해결하기 위해 단일 노드에 여러 LLM을 배치하고 런타임에 즉시 전환하는 '모델 번들링' 접근법을 제시한다. 자사의 RDU(Reconfigurable Dataflow Unit) 아키텍처를 기반으로 DDR과 HBM 간의 마이크로초 단위 모델 스위칭을 구현하여, 복잡한 에이전트 워크플로우를 네트워크 홉 없이 단일 노드에서 완결할 수 있게 한다. 이는 특히 보안이 중요한 온프레미스 환경에서 다중 모델 운영 효율을 극대화하는 핵심 기술로 작용한다.

배경

LLM 추론 및 서빙 기본 지식, 쿠버네티스(Kubernetes) 운영 개념, 에이전트 워크플로우(LangGraph 등)에 대한 이해

대상 독자

LLM 서비스 인프라 설계자, MLOps 엔지니어, 에이전트 시스템 개발자

의미 / 영향

GPU 중심의 확장 방식에서 벗어나 메모리 계층 구조를 활용한 모델 스위칭이 에이전트 AI의 표준 인프라가 될 가능성을 시사한다. 이는 특히 보안이 중요한 온프레미스 환경에서 다중 모델 운영 효율을 극대화한다.

섹션별 상세

이미지 분석

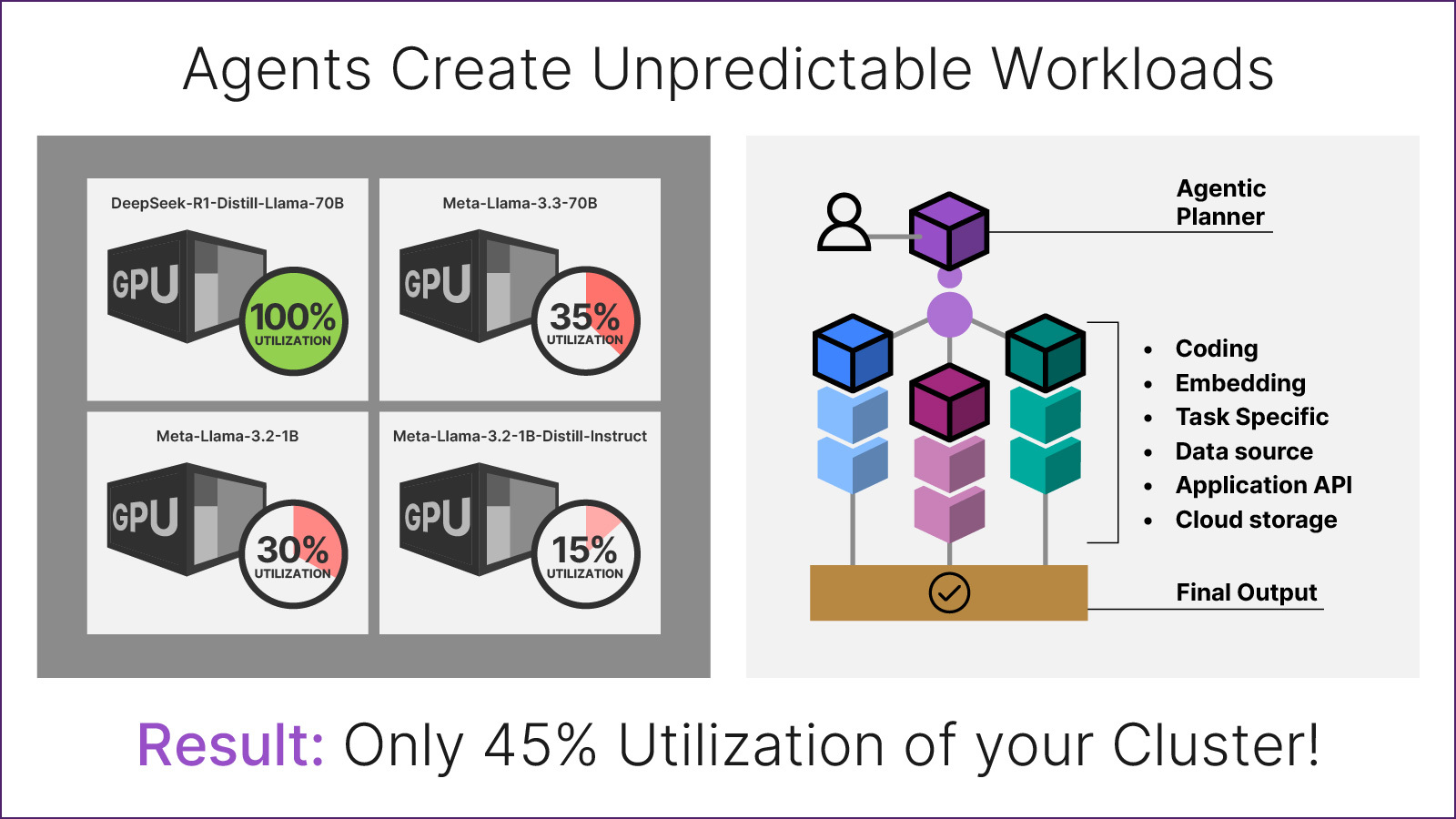

에이전트가 예측 불가능한 워크로드를 생성하여 특정 모델은 100% 사용되지만 다른 모델들은 낮게 유지되어 전체 클러스터 활용도가 45%에 그치는 비효율성을 시각화한다. 이는 노드당 단일 모델 배치의 한계를 지적한다.

에이전트 워크플로우가 클러스터 내 GPU 활용도에 미치는 영향을 보여주는 다이어그램이다.

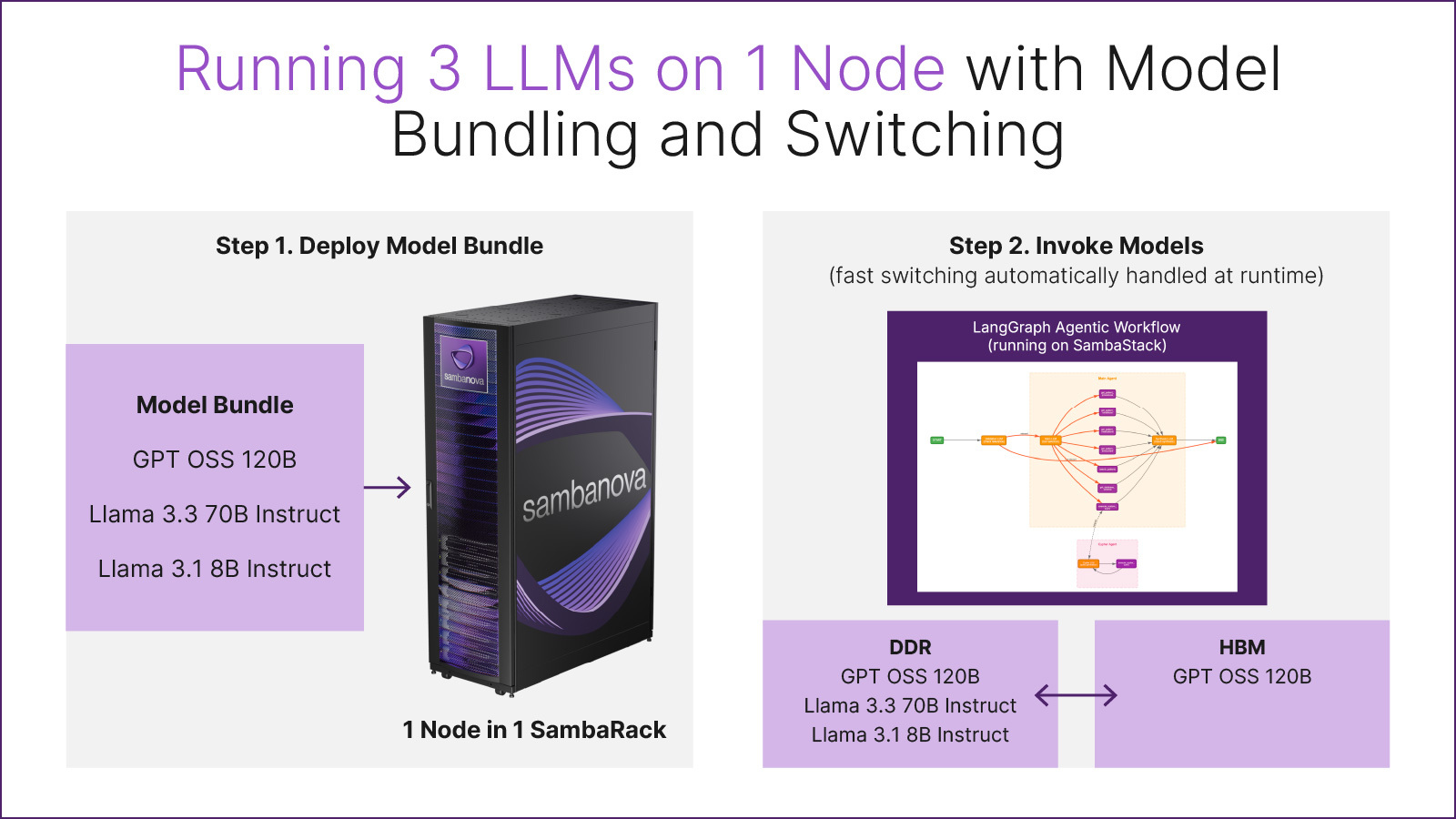

120B, 70B, 8B 모델을 하나의 삼바랙 노드에 배포하고, DDR과 HBM 사이에서 런타임에 자동으로 모델을 전환하며 실행하는 단계를 설명한다. 에이전트 워크플로우가 단일 노드 내에서 완결됨을 보여준다.

단일 노드에서 모델 번들링과 스위칭을 통해 3개의 LLM을 실행하는 과정을 보여준다.

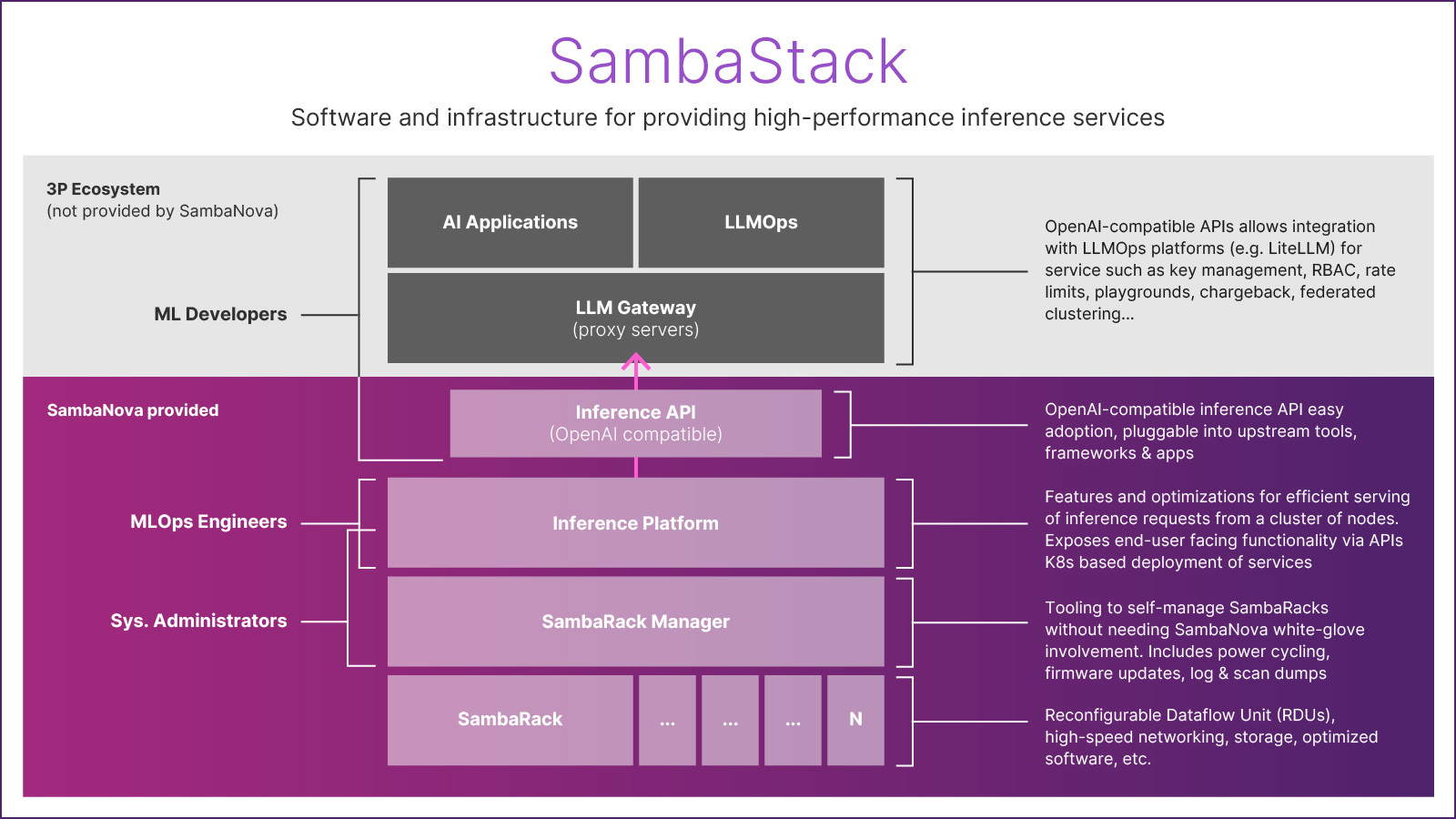

하드웨어인 삼바랙부터 관리자 도구, 추론 플랫폼, OpenAI 호환 API 및 상위 애플리케이션 계층까지의 전체 스택 구성을 보여준다. 각 계층이 담당하는 역할과 사용자 페르소나를 명확히 구분한다.

삼바스택(SambaStack)의 소프트웨어 및 인프라 계층 구조도이다.

실무 Takeaway

- 에이전트 워크플로우 구축 시 모델 간 네트워크 홉을 제거하여 꼬리 지연 시간(Tail Latency)을 획기적으로 단축할 수 있다.

- RDU 기반의 모델 번들링을 활용하면 단일 노드에서 120B 이상의 대형 모델과 소형 모델을 혼합하여 비용 효율적인 추론 시스템을 구성할 수 있다.

- OpenAI 호환 API와 쿠버네티스 기반 배포를 통해 기존 LLMOps 도구를 그대로 유지하면서 인프라 최적화가 가능하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료