핵심 요약

2025년 AI 분야는 단순한 모델 크기 경쟁을 넘어 실질적인 배포와 운영 효율성의 시대로 접어들었다. 컴퓨팅 자원보다 전력 수급이 새로운 병목 현상으로 떠올랐으며, 기업들은 비용 절감과 통제권 확보를 위해 오픈 소스 모델과 전용 추론 하드웨어를 적극 채택했다. 에이전트 AI는 기술적 진보에도 불구하고 특정 워크플로우 내에서의 보조적 역할에 집중하는 경향을 보였다. 2026년에는 모델의 크기보다 실제 환경에서의 실행 효율성이 승패를 가를 것으로 전망된다.

배경

LLM 추론 및 학습의 차이, 오픈 소스 모델 생태계 이해, AI 인프라 및 하드웨어 기본 지식

대상 독자

AI 인프라 설계자, 기업 CTO, LLM 서비스 운영 개발자

의미 / 영향

AI 산업의 중심축이 연구실의 벤치마크 경쟁에서 실제 현장의 운영 효율성과 비용 최적화로 완전히 이동했음을 의미한다. 이는 하드웨어 시장에서 엔비디아 독주 체제에 도전하는 맞춤형 추론 칩의 부상을 가속화할 것이다.

섹션별 상세

이미지 분석

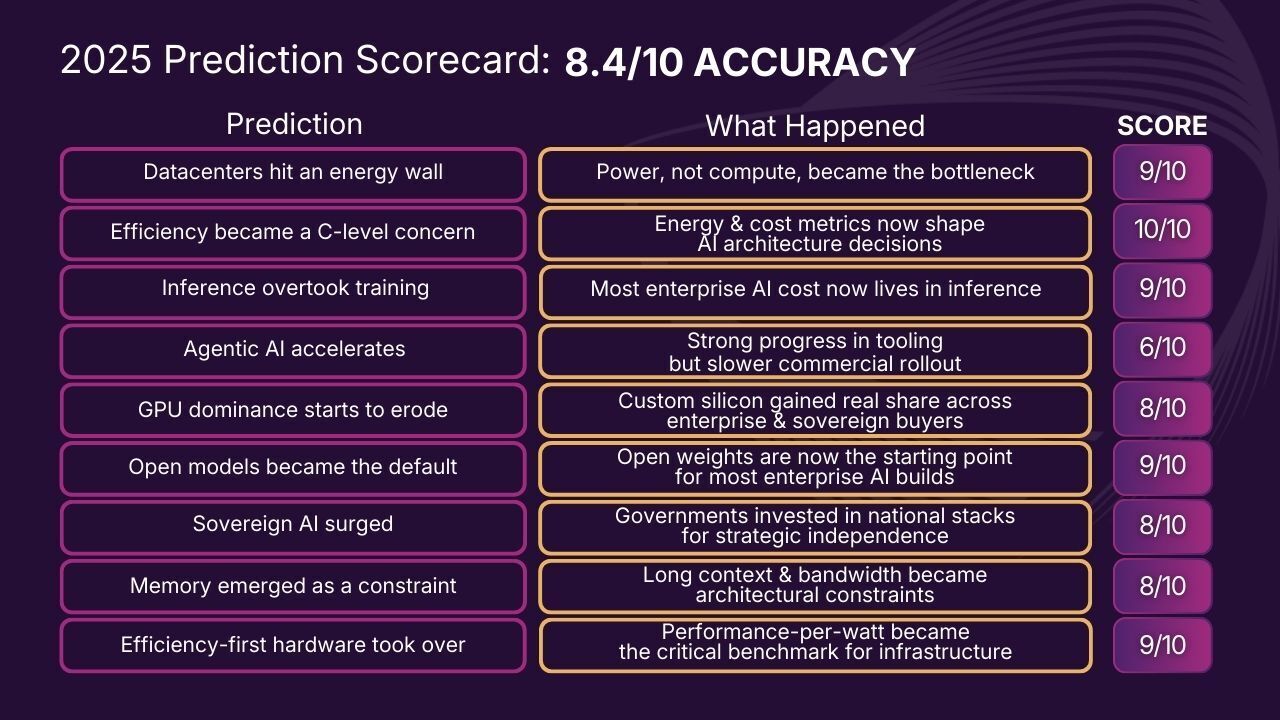

SambaNova가 연초에 제시했던 9가지 예측(에너지 장벽, 추론 비중 확대, 오픈 모델 기본화 등)에 대해 각각의 정확도 점수와 실제 벌어진 현상을 대조하여 보여준다. 전체 평균 8.4/10의 정확도를 기록했음을 명시하며 기사의 핵심 근거 자료로 활용된다.

2025년 AI 예측에 대한 정확도 점수표와 실제 결과 요약.

실무 Takeaway

- 2026년에는 새로운 모델을 학습시키는 것보다 기존 오픈 소스 모델을 활용해 추론 효율성을 극대화하는 기업이 경쟁 우위를 점할 것이다.

- 인프라 설계 시 단순 성능 점수보다 실제 운영 환경에서의 '와트당 성능'과 전력 가용성을 최우선 순위로 고려해야 한다.

- 에이전트 AI 도입 시 마법 같은 자율성을 기대하기보다, 기존의 데이터 및 프로세스 IP를 보호할 수 있는 구조화된 워크플로우 설계에 집중해야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료