핵심 요약

대형 언어 모델(LLM)의 추론 효율을 높이기 위한 양자화 과정에서 발생하는 성능 저하를 해결하기 위해 PyTorch의 TorchAO가 강화된 양자화 인식 학습(QAT) 기능을 선보였다. TorchAO는 Unsloth와 Axolotl 같은 주요 파인튜닝 프레임워크에 QAT 워크플로우를 통합하여, 사용자가 코드 몇 줄만으로 양자화된 모델의 정확도를 복구할 수 있게 한다. 특히 LoRA와 QAT를 결합하여 학습 속도를 1.89배 높이면서 메모리 사용량을 36% 절감하는 성과를 거두었으며, Blackwell GPU의 NVFP4 형식을 지원하여 최신 하드웨어 성능을 극대화한다. 또한 새롭게 도입된 PARQ 알고리즘은 3비트 이하의 초저비트 환경에서도 기존 4비트 모델에 필적하는 성능과 더 빠른 추론 속도를 제공하여 모바일 및 엣지 디바이스 배포의 새로운 가능성을 제시한다.

배경

PyTorch 및 TorchAO 라이브러리 기본 지식, LLM 양자화(Quantization) 및 파인튜닝 개념, LoRA(Low-Rank Adaptation) 작동 원리

대상 독자

LLM 파인튜닝 및 모바일/엣지 배포를 담당하는 AI 엔지니어

의미 / 영향

이 기술은 LLM의 경량화와 성능 유지 사이의 트레이드오프를 획기적으로 개선하여, 고성능 모델을 모바일 기기나 저사양 GPU 환경에서도 품질 저하 없이 실행할 수 있게 합니다. 특히 주요 파인튜닝 프레임워크와의 통합은 QAT의 진입 장벽을 낮춰 업계 전반의 모델 효율화 속도를 가속화할 것입니다.

섹션별 상세

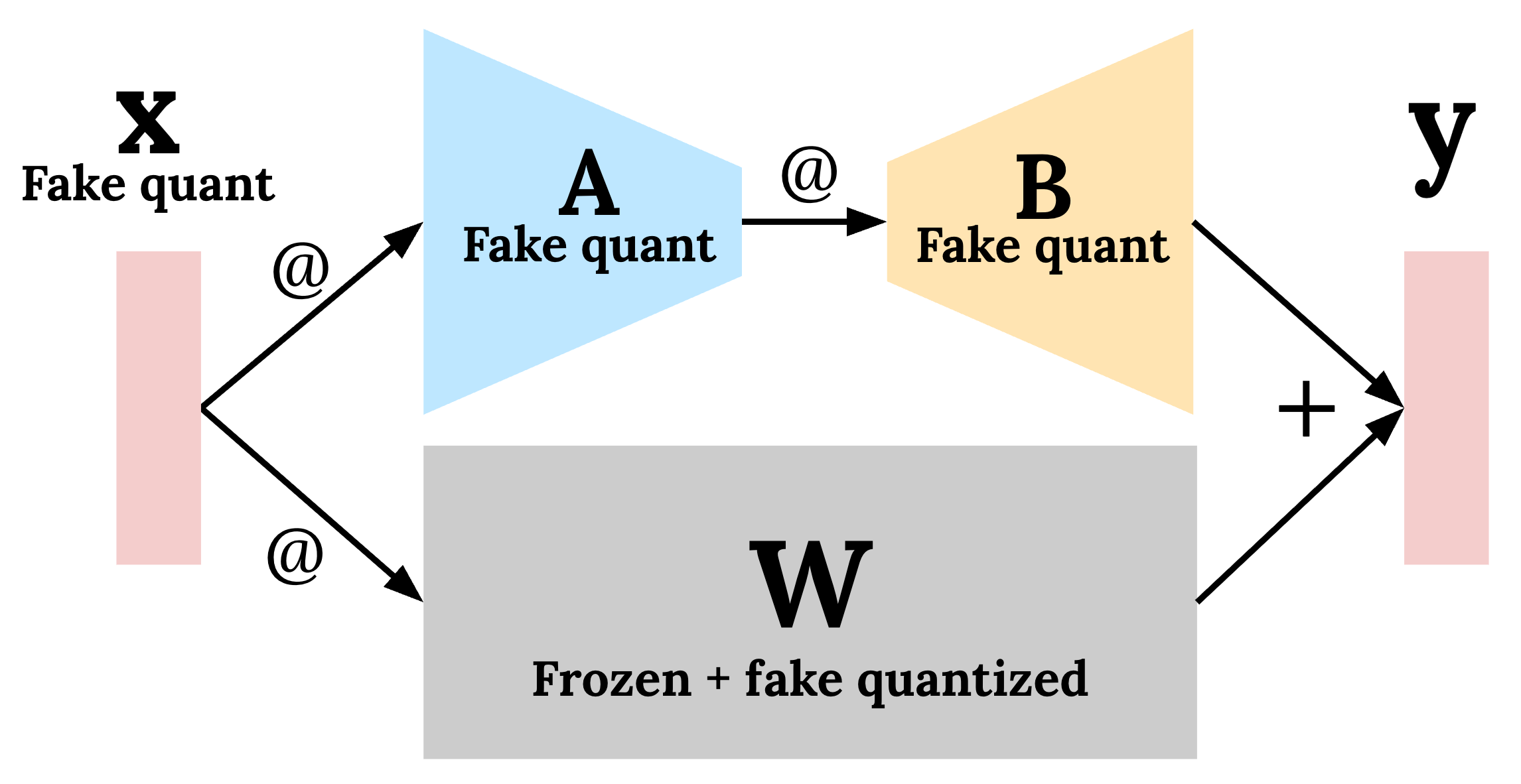

from torchao.quantization import quantize_, Int4WeightOnlyConfig

from torchao.quantization.qat import QATConfig

# PTQ와 동일한 설정 사용

base_config = Int4WeightOnlyConfig(group_size=32)

# 준비 단계: 모델을 "가짜 양자화" 상태로 만들고 학습 준비

quantize_(model, QATConfig(base_config, step="prepare"))

train(model)

# 변환 단계: 모델을 실제 양자화하여 추론 준비

quantize_(model, QATConfig(base_config, step="convert"))TorchAO를 사용하여 모델에 QAT를 적용하는 기본적인 3단계 흐름

from unsloth import FastLanguageModel

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "unsloth/gemma3-12b-it",

max_seq_length = 2048,

load_in_16bit = True,

)

model = FastLanguageModel.get_peft_model(

model,

r = 16,

target_modules = ["q_proj", "k_proj", "v_proj", "o_proj", "gate_proj", "up_proj", "down_proj"],

lora_alpha = 32,

# fp8-int4, fp8-fp8, int4, int8-int4 등 지원

qat_scheme = "int4",

)Unsloth 프레임워크에서 qat_scheme 플래그를 사용하여 QAT를 활성화하는 방법

from torchao.prototype.parq.api import QuantConfig, create_optimizer

def linear_filter_fn(module, fqn):

return isinstance(module, torch.nn.Linear) and fqn.endswith("weight")

linear_config = QuantConfig(bitwidth=2, group_size=None)

quant_configs_and_filter_fns = [(linear_config, linear_filter_fn)]

# optimizer.step()에서 양자화를 수행하는 QuantOptimizer 적용

optimizer = create_optimizer(

model,

quant_configs_and_filter_fns,

base_optimizer_cls=torch.optim.AdamW,

base_optimizer_kwargs={"weight_decay": 1e-2},

quant_per_channel=True,

)PARQ를 사용하여 옵티마이저 수준에서 2비트 양자화 학습을 설정하는 예시

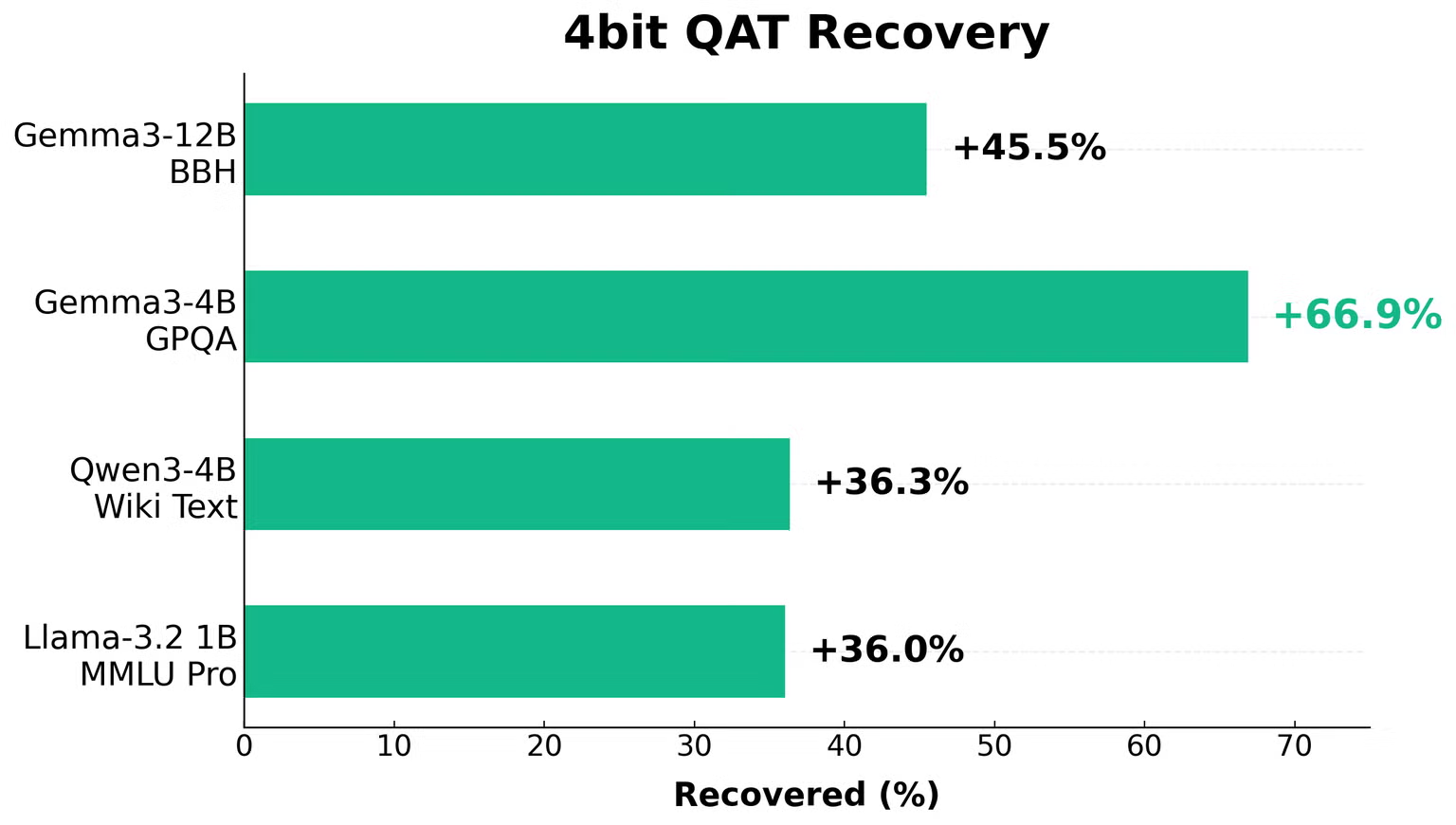

실무 Takeaway

- 양자화로 인한 성능 저하가 심각한 LLM 프로젝트에서 TorchAO의 QAT를 Unsloth나 Axolotl 파이프라인에 통합하면 정확도를 최대 70% 이상 복구할 수 있다.

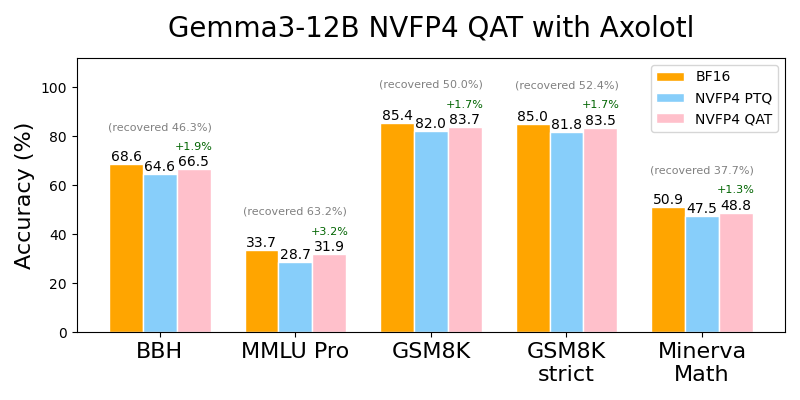

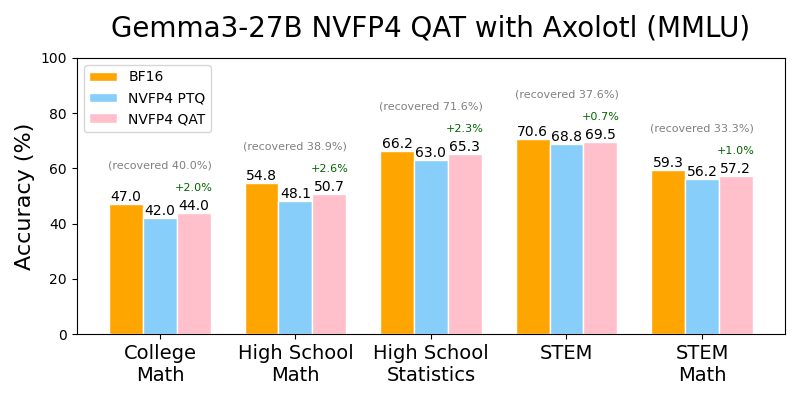

- Blackwell 아키텍처(B200)를 사용하는 환경이라면 NVFP4 QAT를 적용하여 메모리 점유율을 75% 절감하면서도 BF16에 근접한 성능을 유지할 수 있다.

- 3비트 이하의 극단적인 경량화가 필요한 모바일 배포 시나리오에서는 PARQ 기법을 사용하여 4비트 모델보다 빠른 속도와 유사한 정확도를 확보할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.