핵심 요약

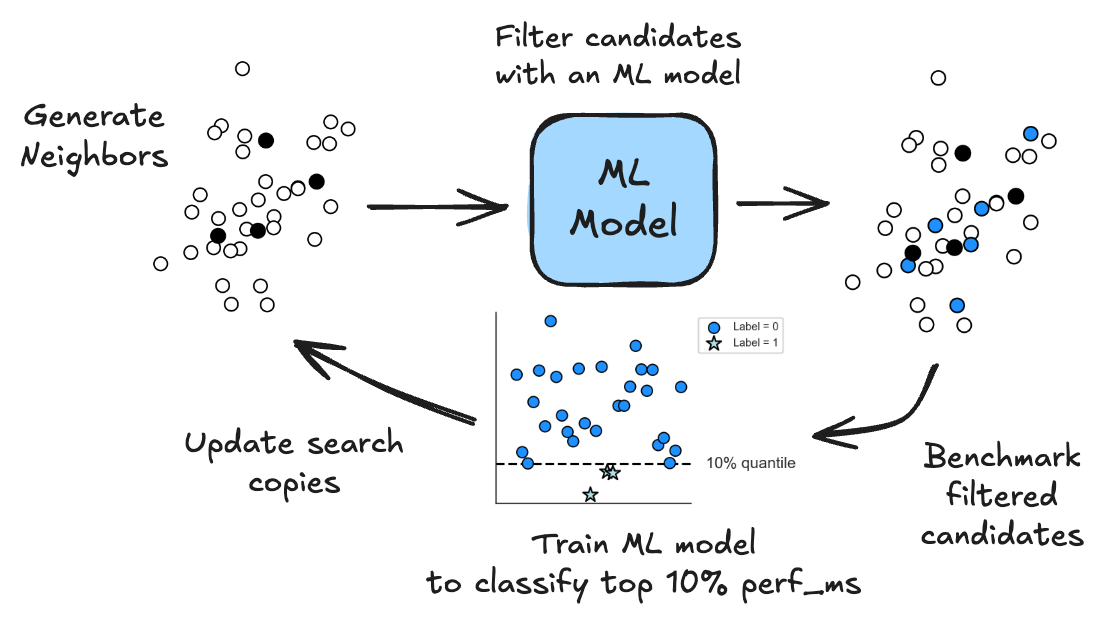

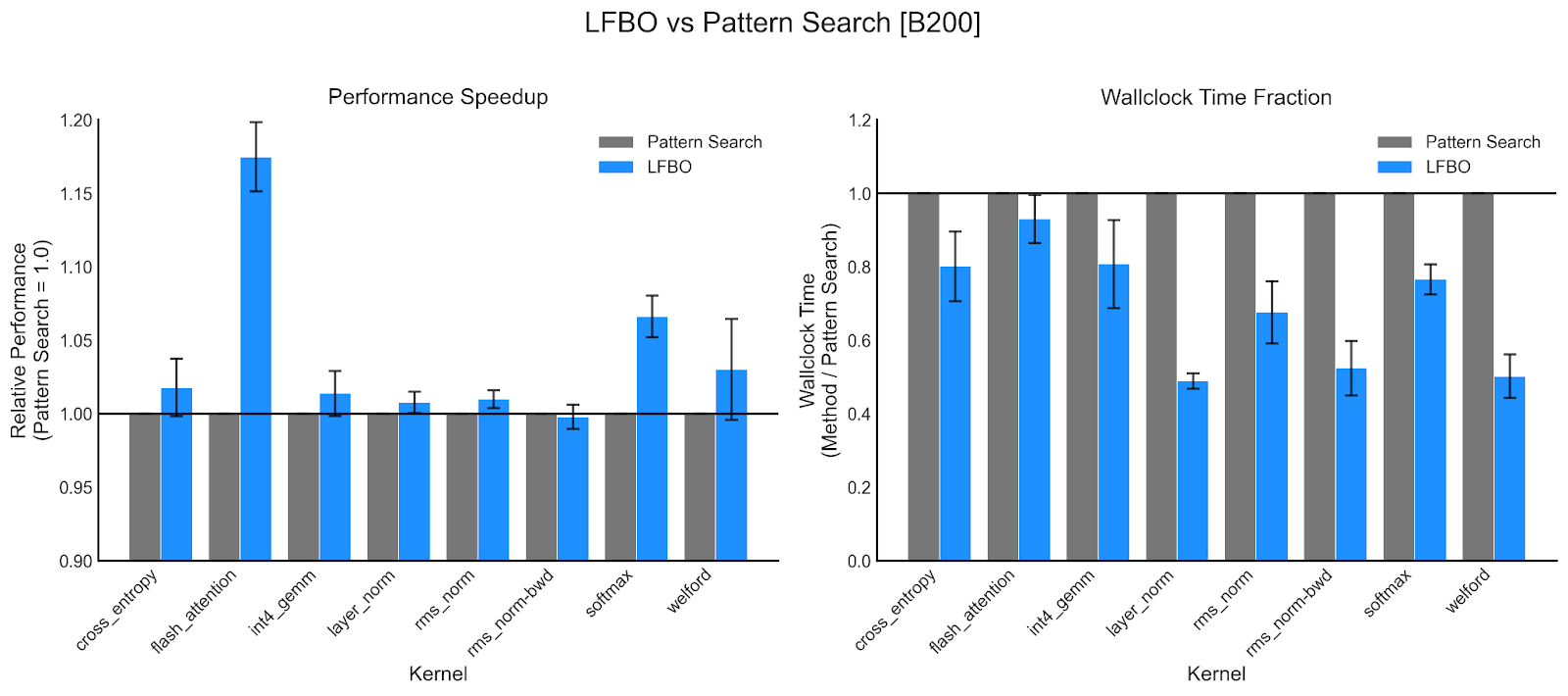

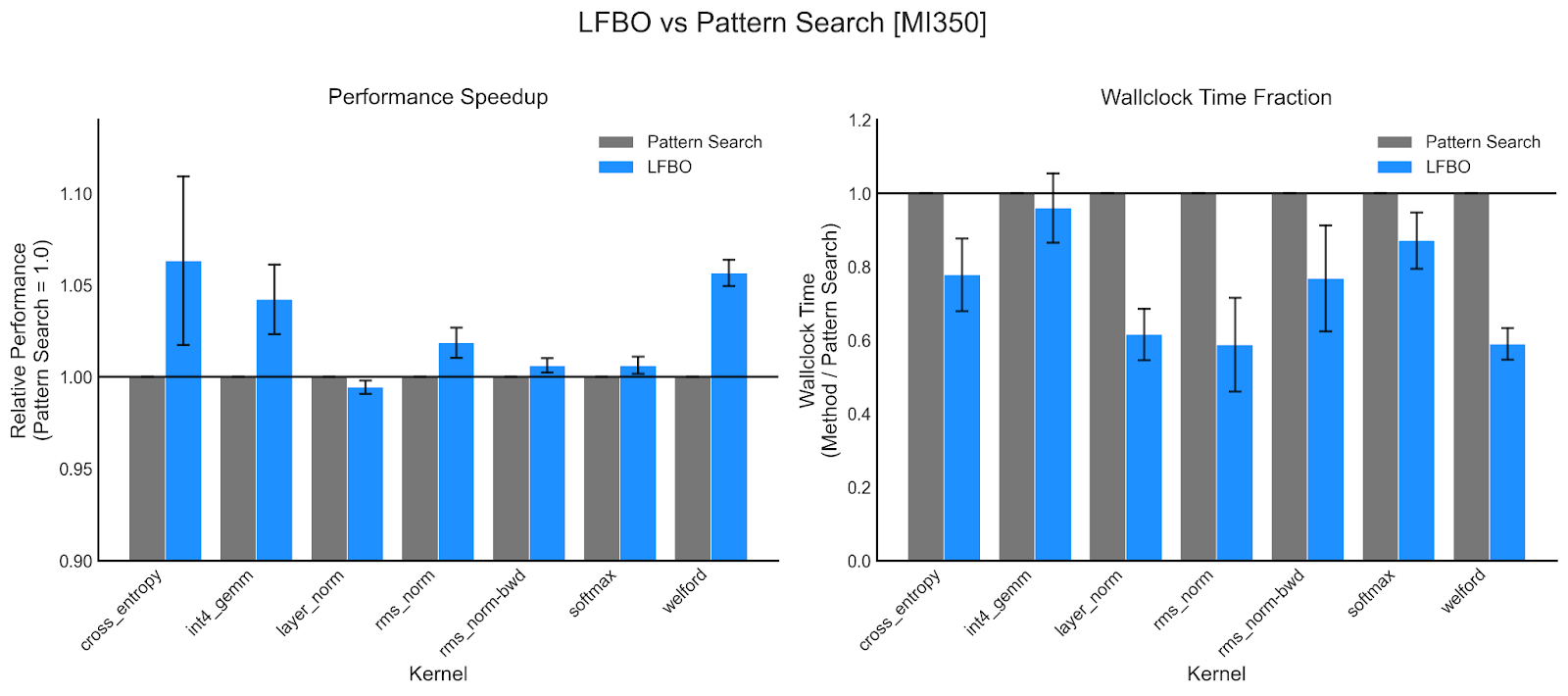

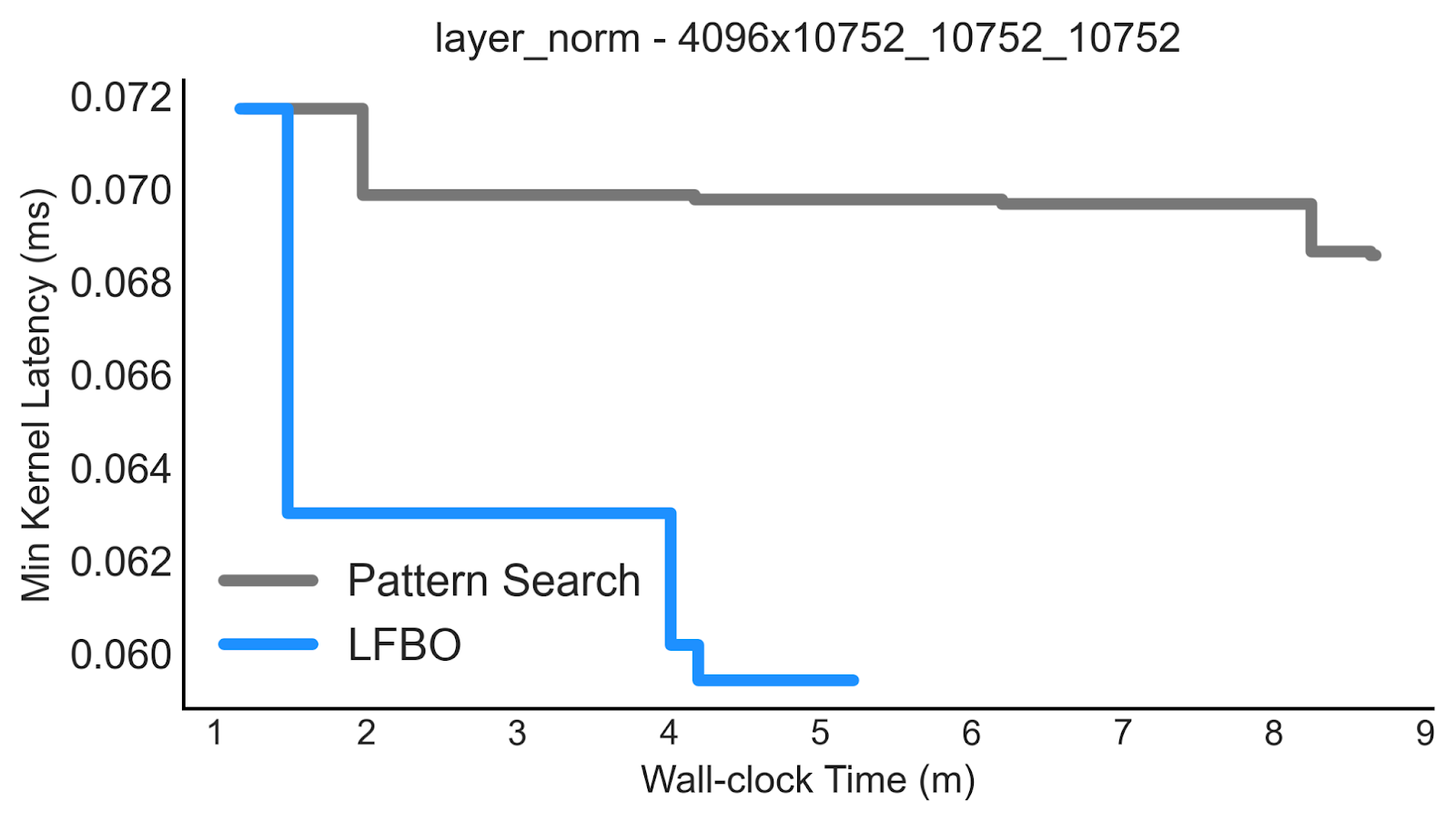

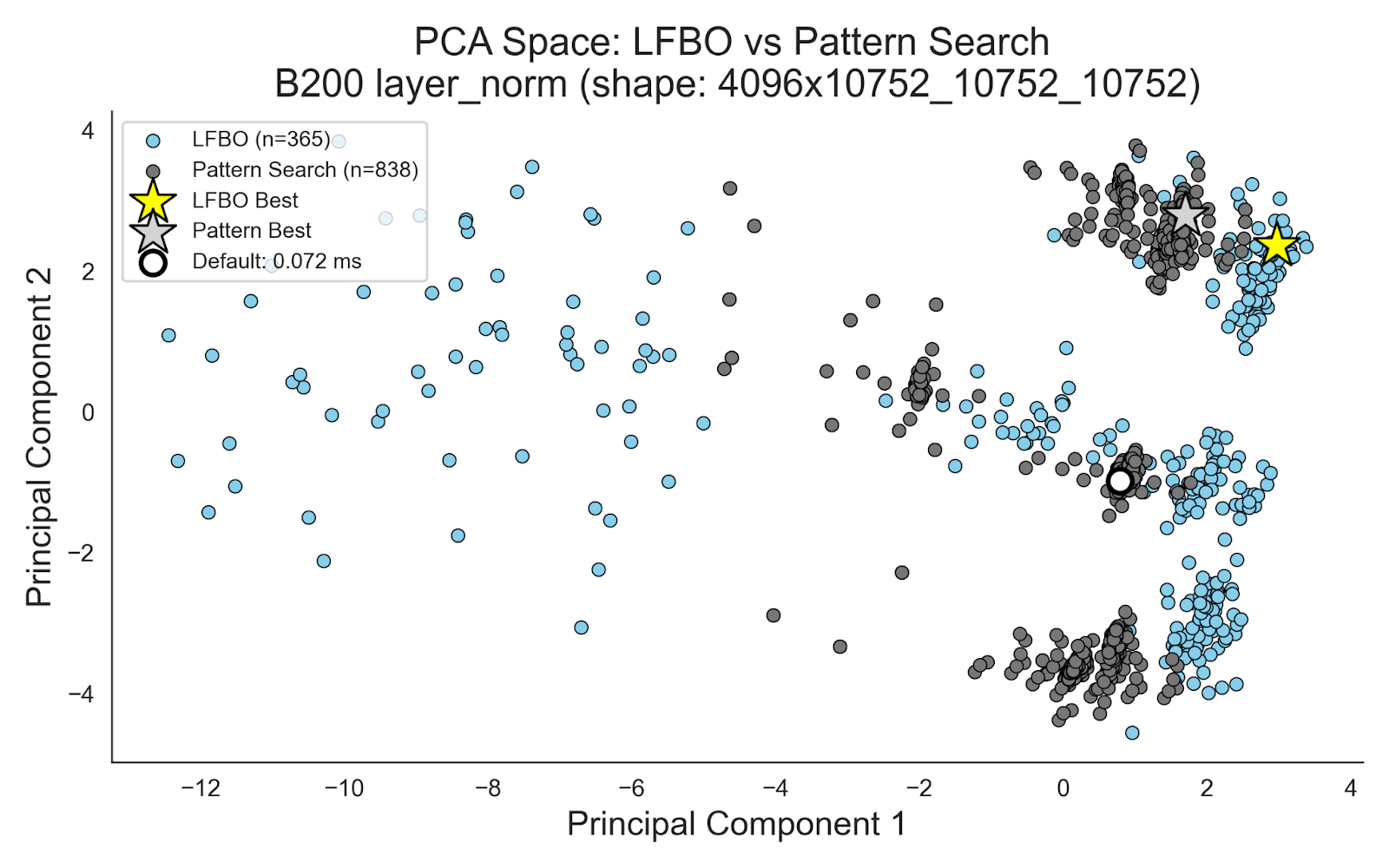

ML 커널 최적화를 위한 DSL인 Helion은 고성능 커널을 생성하지만, 수천 개의 구성을 탐색하는 오토튜닝 과정에서 막대한 시간이 소요되는 한계가 있었다. 이를 해결하기 위해 연구팀은 기존의 패턴 검색 방식에 ML 분류 모델을 결합한 'LFBO Pattern Search' 알고리즘을 개발했다. 이 알고리즘은 수집된 데이터를 바탕으로 상위 10%의 유망한 후보만 선별하여 벤치마킹함으로써 탐색 효율을 극대화한다. 결과적으로 NVIDIA B200 하드웨어에서 튜닝 시간을 36.5% 줄이면서도 커널 성능을 2.6% 향상시키는 성과를 거두었으며, 현재 Helion의 기본 검색 알고리즘으로 채택되었다.

배경

PyTorch 및 커널 최적화 기본 지식, Bayesian Optimization 개념, GPU 아키텍처(NVIDIA B200, AMD MI300 시리즈)에 대한 이해

대상 독자

고성능 ML 커널을 개발하거나 GPU 최적화 엔진을 연구하는 엔지니어

의미 / 영향

이 기술은 ML 모델의 추론 및 학습 속도를 결정짓는 커널 최적화 주기를 획기적으로 단축합니다. 특히 하드웨어 가속기마다 다른 최적 구성을 찾는 비용을 낮춰 새로운 AI 하드웨어 도입 시 소프트웨어 스택 최적화 속도를 높이는 데 기여할 것입니다.

섹션별 상세

실무 Takeaway

- 커널 오토튜닝 시 모든 후보를 전수 조사하는 대신 ML 분류기를 활용해 상위 10% 유망 후보만 선별하면 튜닝 시간을 30% 이상 단축할 수 있다.

- 시스템 비용 모델링 시 단순 회귀보다 분류 모델을 사용하면 데이터가 없는 오류 케이스를 더 잘 처리하고 고성능 영역에 최적화 역량을 집중할 수 있다.

- 탐색 알고리즘에 다양성 페널티를 도입하여 PCA 공간상에서 더 넓은 범위를 탐색하게 함으로써 국소 최적점(Local Optima) 탈출 가능성을 높일 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.