핵심 요약

단일 AI 모델의 답변에 의존하는 대신 여러 모델의 의견을 교차 검증하기 위해 Claude, ChatGPT, Gemini가 서로 토론하는 로컬 앱 'llm-discussion'이 개발되었습니다. 저자는 Claude Code를 활용해 약 325줄의 Python 코드로 이 시스템을 구축했으며, 각 모델이 서로의 답변을 비판하고 보완하며 최종적인 합의안을 도출하도록 설계했습니다. 이 도구는 모델 간의 공통된 견해뿐만 아니라 의견이 갈리는 지점까지 명확히 보여주어 사용자에게 더 깊이 있는 통찰을 제공합니다. 현재 GitHub에 공개된 이 프로젝트는 Flask를 웹 UI로 사용하며 누구나 자신의 API 키를 통해 로컬 환경에서 실행할 수 있습니다.

배경

Python 기초 지식, OpenAI, Anthropic, Google AI Studio API 키 발급 방법, Flask 웹 프레임워크에 대한 기본적인 이해

대상 독자

LLM API를 활용해 생산성 도구를 만들고 싶은 개발자 및 AI 답변의 객관성을 높이고 싶은 사용자

의미 / 영향

개별 LLM의 편향성을 극복하기 위해 다중 에이전트 토론(Multi-agent discussion) 방식이 개인용 도구 수준에서도 쉽게 구현될 수 있음을 시사합니다. 이는 향후 AI 에이전트가 단순히 명령을 수행하는 것을 넘어 스스로 검증하고 합의하는 워크플로우로 진화할 것임을 보여줍니다.

섹션별 상세

이미지 분석

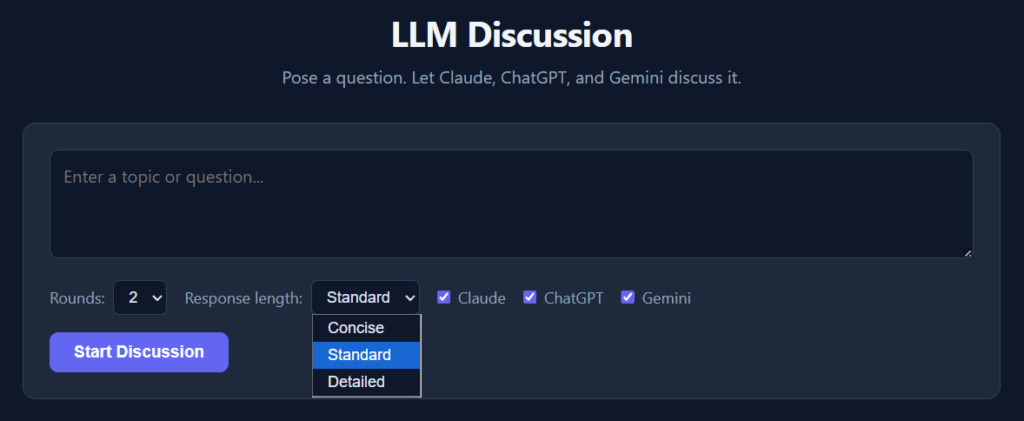

사용자가 질문을 입력하고 토론 라운드 수, 답변 길이(Concise, Standard, Detailed), 참여할 모델을 선택할 수 있는 설정 화면을 보여줍니다. 앱의 핵심 기능인 다중 모델 제어 방식을 시각적으로 확인시켜 줍니다.

llm-discussion 도구의 사용자 인터페이스 스크린샷

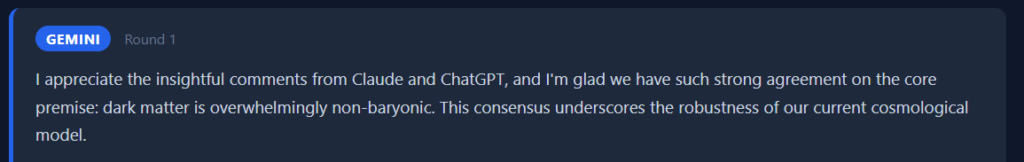

모델들이 서로의 의견을 존중하며 전문적인 용어(non-baryonic dark matter 등)를 사용해 합의를 도출하는 실제 토론 로그의 예시를 보여줍니다. 기사에서 언급된 '정중한 토론'의 실제 양상을 증명합니다.

Gemini 모델이 다른 모델의 의견에 동의하며 토론하는 장면

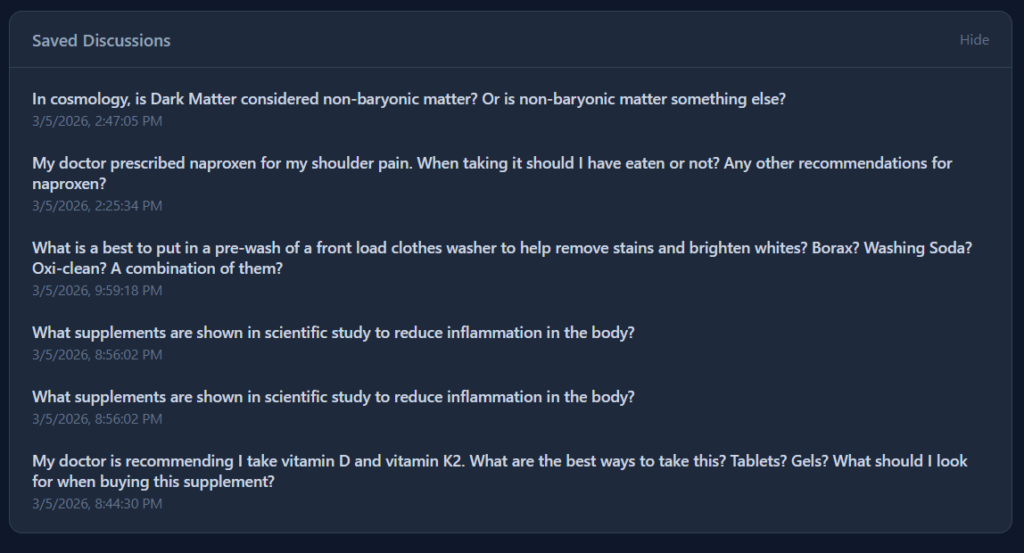

우주론, 의학적 조언, 세탁 팁 등 다양한 주제에 대해 수행된 토론 내역과 타임스탬프를 보여줍니다. 로컬 저장 기능과 실제 활용 사례들을 한눈에 파악할 수 있게 돕습니다.

저장된 과거 토론 목록 화면

실무 Takeaway

- 단일 모델의 환각(Hallucination) 현상을 방지하기 위해 다중 모델 교차 검증(Cross-referencing) 아키텍처를 활용할 수 있습니다.

- Claude Code와 같은 자율 코딩 에이전트를 사용하면 복잡한 API 연동 워크플로우를 최소한의 코드로 빠르게 구현 가능합니다.

- 모델 간의 비판적 토론(Critique) 과정을 거치면 단순한 답변보다 훨씬 깊이 있고 다각적인 분석 결과를 얻을 수 있습니다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료