핵심 요약

Apple Silicon 환경에서 LLM 추론 효율을 극한으로 끌어올리기 위해 개발된 MetalRT 엔진의 벤치마크 결과가 발표되었습니다. M4 Max 칩셋을 탑재한 단일 기기에서 Qwen3-0.6B 모델 기준 초당 658토큰이라는 압도적인 디코딩 속도를 달성하며 기존 프레임워크들의 한계를 넘어섰습니다. 이 엔진은 추상화 계층을 최소화하고 하드웨어에 직접 접근하는 방식을 채택하여 llama.cpp 및 Apple의 공식 MLX 프레임워크보다 뛰어난 성능을 입증했습니다. 특히 지연 시간이 중요한 실시간 챗봇, 에이전트 워크플로우, 온디바이스 AI 애플리케이션에 최적화된 솔루션을 제공합니다.

배경

Apple Silicon(M-시리즈) 하드웨어 아키텍처에 대한 기본 지식, LLM 추론 엔진(llama.cpp, MLX 등) 및 양자화 개념 이해

대상 독자

Apple Silicon 환경에서 고성능 온디바이스 LLM 서비스를 개발하거나 최적화하려는 엔지니어

의미 / 영향

Apple Silicon의 하드웨어 잠재력을 극한으로 끌어올리는 서드파티 엔진의 등장은 온디바이스 AI 생태계의 기술적 상한선을 높일 것입니다. 이는 클라우드 의존도를 낮추고 개인정보를 보호하면서도 고성능을 유지해야 하는 로컬 AI 애플리케이션 시장의 성장을 가속화하는 계기가 될 것입니다.

섹션별 상세

이미지 분석

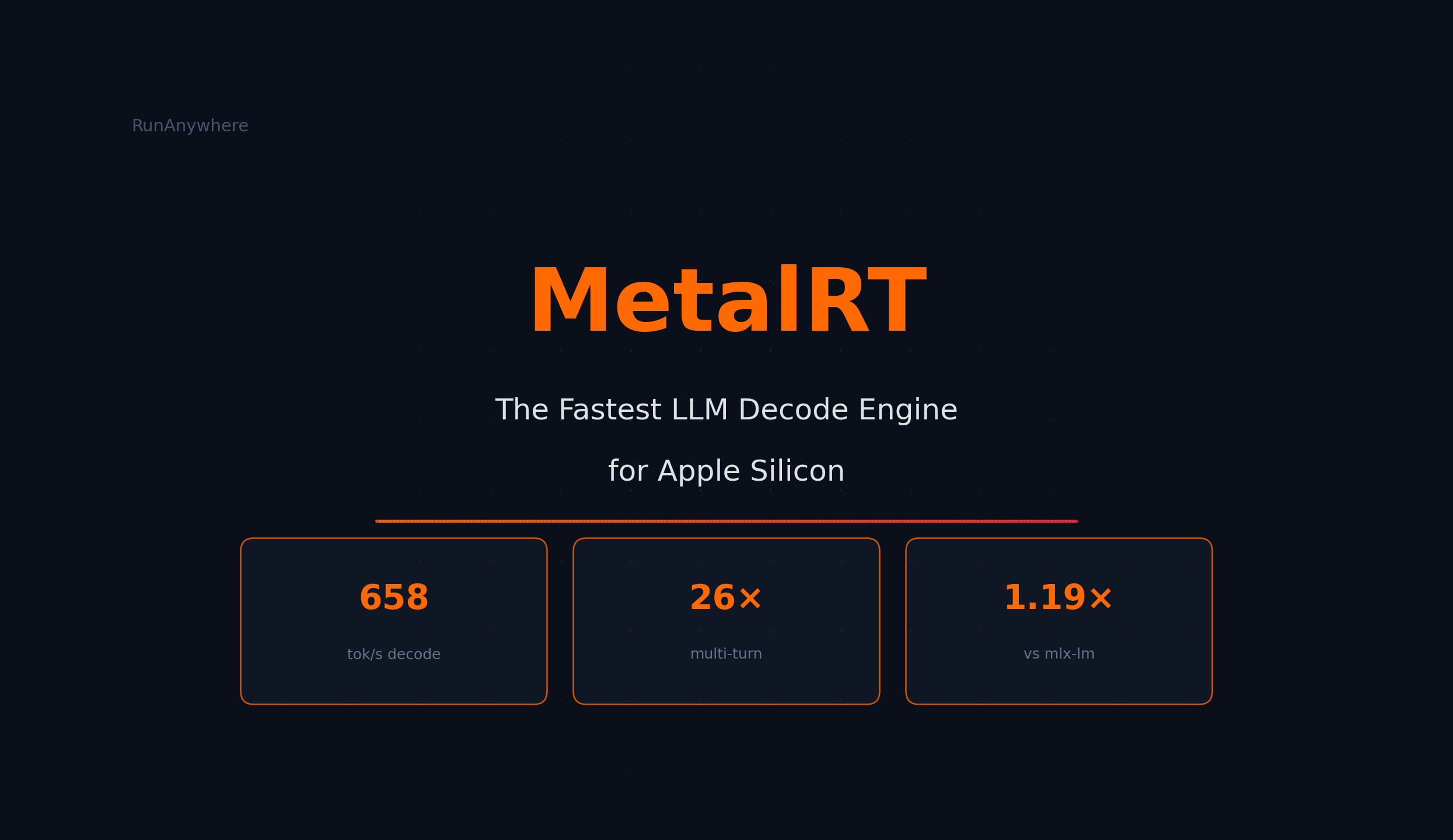

M4 Max에서 달성한 초당 658토큰의 속도와 llama.cpp 대비 1.67배, mlx-lm 대비 1.19배 빠른 성능 향상 수치를 시각적으로 강조하여 기사의 핵심 주장을 요약합니다.

MetalRT의 주요 성능 지표를 요약한 히어로 이미지

Qwen3, Llama 3.2 등 주요 모델에서 MetalRT, uzu, mlx-lm, llama.cpp, Ollama의 초당 토큰 처리량을 비교하여 MetalRT가 대부분의 모델에서 우위에 있음을 보여줍니다.

다양한 모델별 추론 엔진들의 디코딩 속도 비교 차트

모델별로 MetalRT가 기존 엔진들보다 얼마나 더 빠른지 배율(x)로 표시하여, 특히 llama.cpp 대비 최대 2.23배까지 성능이 향상됨을 구체적인 수치로 제시합니다.

Apple MLX 및 llama.cpp 대비 MetalRT의 속도 향상 비율 차트

실무 Takeaway

- Apple Silicon 기반 온디바이스 AI 서비스 구축 시 llama.cpp나 mlx-lm을 상회하는 고성능 엔진 선택지가 확보되었습니다.

- 동일한 모델 파일과 하드웨어 조건에서도 추론 엔진의 최적화 방식에 따라 20% 이상의 성능 향상이 가능함을 입증했습니다.

- 에이전트 시스템이나 실시간 음성 파이프라인처럼 지연 시간에 민감한 서비스일수록 MetalRT와 같은 전용 엔진 도입의 효과가 극대화됩니다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료