핵심 요약

Amazon SageMaker AI는 2025년 생성형 AI 모델의 학습, 튜닝 및 호스팅을 최적화하기 위한 대규모 업데이트를 단행했다. 이번 파트 2에서는 인스턴스 및 컨테이너 단위의 세밀한 관측성 강화, 인프라 관리 부담을 없앤 서버리스 모델 커스터마이징, 그리고 실시간 음성 에이전트 구현을 위한 양방향 스트리밍 기술을 중점적으로 다룬다. 이러한 기능들은 기업이 대규모 AI 모델을 프로덕션 환경에 배포할 때 겪는 비용, 복잡성, 보안 문제를 해결하는 데 초점을 맞추고 있다.

배경

AWS SageMaker 기본 지식, CloudWatch 모니터링 개념, 파인튜닝(Fine-tuning) 및 추론 엔드포인트에 대한 이해

대상 독자

AWS 기반 AI/ML 서비스 운영자 및 LLM 애플리케이션 개발자

의미 / 영향

이번 업데이트는 기업들이 AI 모델을 실험 단계에서 실제 프로덕션으로 전환할 때 마주하는 운영 복잡도와 비용 장벽을 크게 낮춘다. 특히 서버리스 튜닝과 양방향 스트리밍은 중소규모 팀도 고성능 맞춤형 AI 서비스를 구축할 수 있는 기반을 제공한다.

섹션별 상세

이미지 분석

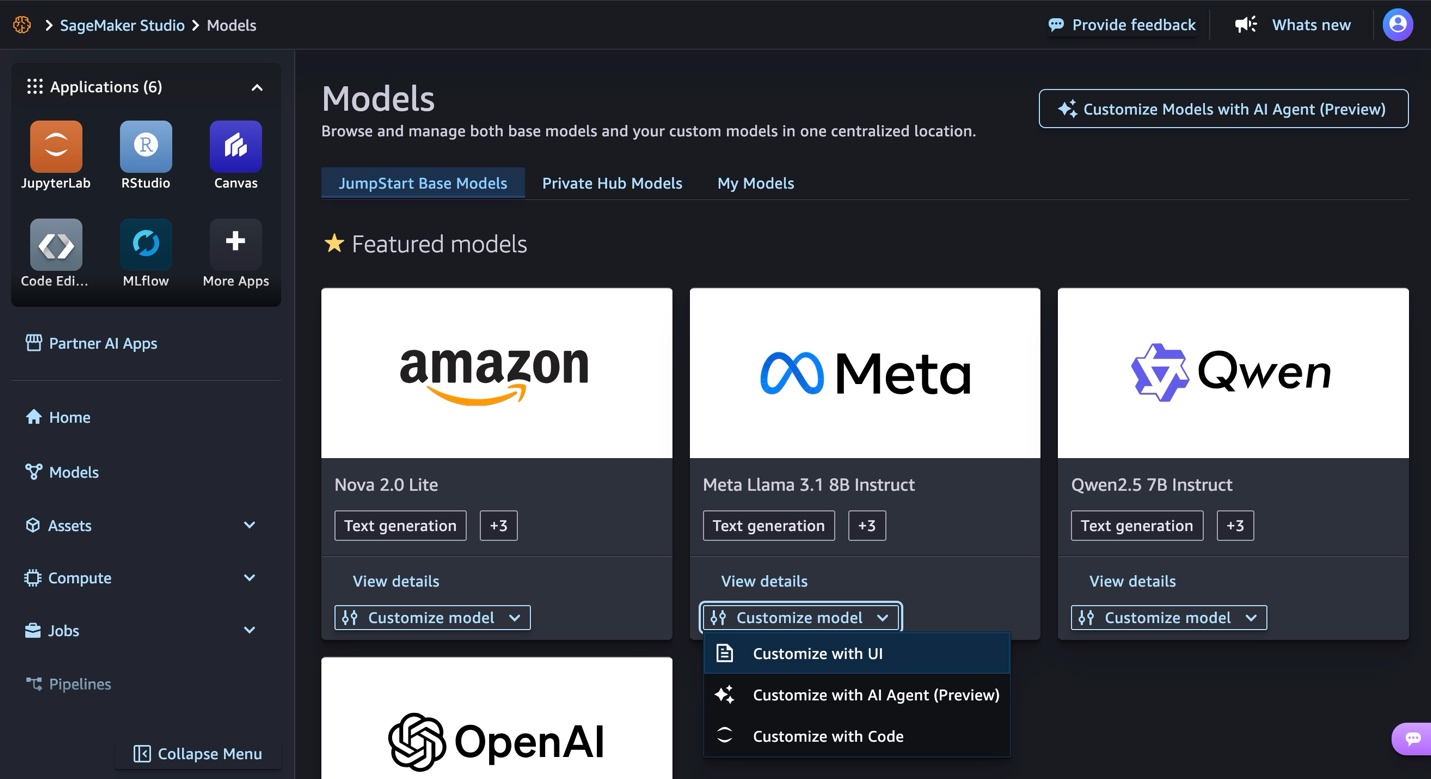

Amazon Nova, Meta Llama 3.1, Qwen 등 다양한 베이스 모델을 선택하고 UI, AI 에이전트, 또는 코드를 통해 커스터마이징을 시작할 수 있는 통합 인터페이스를 보여준다. 서버리스 모델 커스터마이징 기능이 실제 사용자 환경에서 어떻게 제공되는지 시각적으로 확인 가능하다.

SageMaker Studio의 모델 커스터마이징 UI 화면

실무 Takeaway

- MetricsConfig를 활용해 GPU 사용량과 지연 시간을 컨테이너 단위로 모니터링하여 리소스 할당을 최적화하고 운영 비용을 절감할 수 있다.

- 서버리스 커스터마이징 기능을 사용하면 인프라 설정 없이 Amazon Nova, Llama, Qwen 등 최신 모델을 SFT나 강화학습으로 빠르게 튜닝할 수 있다.

- 실시간 음성 서비스 구축 시 WebSocket 기반의 양방향 스트리밍을 적용하여 지연 시간을 최소화하고 대화의 연속성을 확보할 수 있다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료