핵심 요약

기업의 영업 조직은 여러 데이터 소스에 흩어진 고객 정보를 수동으로 취합하는 데 많은 시간을 소모한다. AWS는 이를 해결하기 위해 Amazon Bedrock AgentCore 기반의 'CAKE(Customer Agent & Knowledge Engine)'를 구축하여 데이터 사일로를 통합했다. 이 시스템은 지식 그래프, 지표 데이터베이스, 문서 검색 등 특화된 도구들을 병렬로 실행하여 10초 이내에 자연어 답변을 제공한다. 결과적으로 영업 담당자의 정보 검색 시간을 획기적으로 단축하고 비즈니스 맥락에 기반한 심층적인 고객 인사이트를 제공하는 성과를 거두었다.

배경

AWS 기초 지식, RAG(검색 증강 생성) 개념, Amazon Bedrock 기본 이해

대상 독자

엔터프라이즈급 다중 에이전트 시스템을 설계하는 솔루션 아키텍트 및 AI 개발자

의미 / 영향

이 사례는 파편화된 기업 데이터를 LLM 에이전트로 통합하는 표준 아키텍처를 제시한다. 관리형 서비스를 통해 복잡한 오케스트레이션을 해결함으로써 기업들이 실질적인 비즈니스 가치를 창출하는 AI 도구를 더 빠르게 배포할 수 있게 한다.

섹션별 상세

이미지 분석

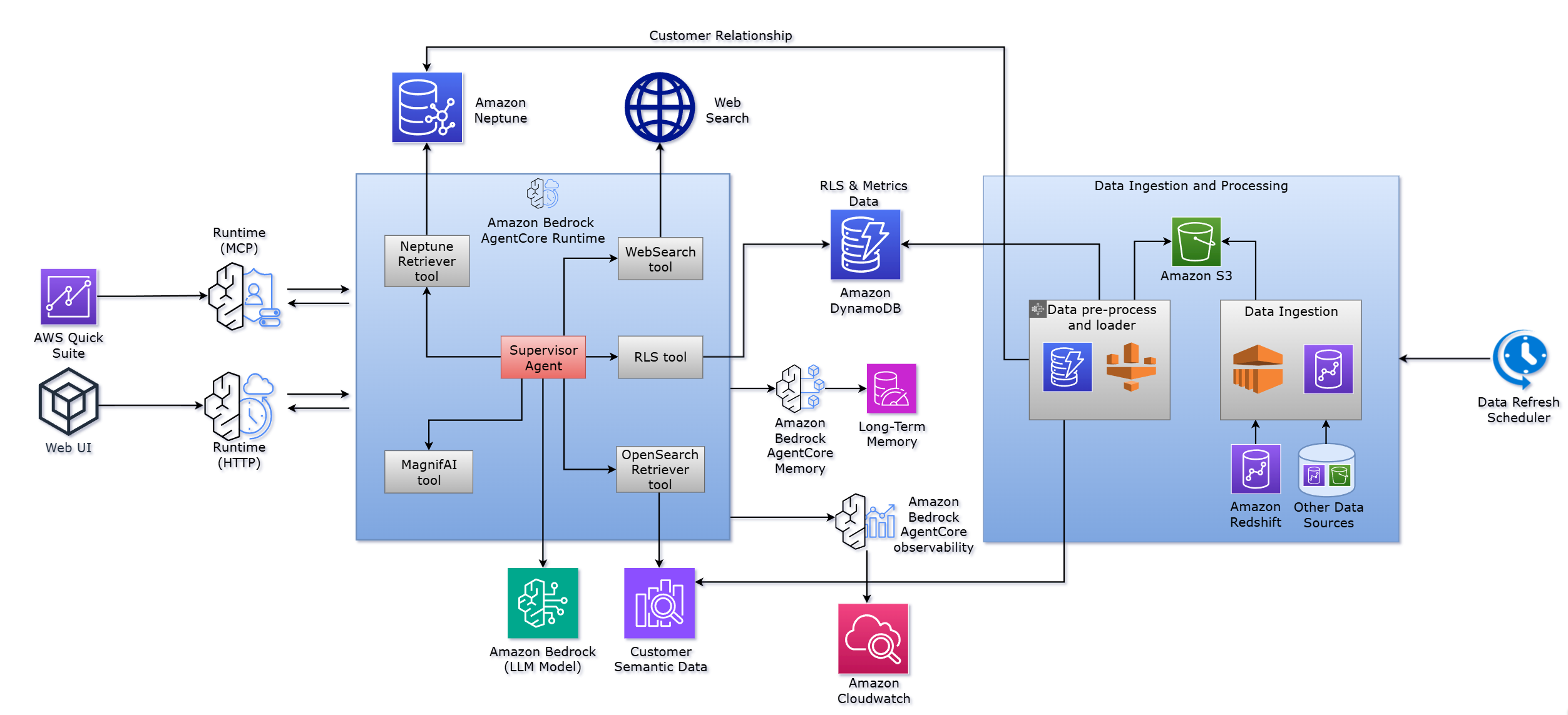

Supervisor 에이전트가 중심이 되어 Neptune, DynamoDB, OpenSearch 등 다양한 도구와 상호작용하는 구조를 보여준다. 사용자 쿼리가 들어왔을 때 각 도구가 어떻게 병렬로 호출되고 데이터 파이프라인과 연결되는지 시각화한다.

CAKE 시스템의 전체 아키텍처 다이어그램

Amazon Redshift에서 데이터를 추출하여 S3, DynamoDB, Neptune, OpenSearch로 가공 및 로드하는 오프라인 파이프라인 과정을 설명한다. 실시간 서빙 레이어와 분리된 데이터 갱신 메커니즘을 명확히 한다.

데이터 수집 및 처리 파이프라인 다이어그램

실무 Takeaway

- Amazon Bedrock AgentCore를 활용하면 복잡한 에이전트 오케스트레이션 인프라 구축 비용을 줄이고 개발 기간을 수개월에서 수주 단위로 단축할 수 있다.

- 데이터 소스별 특성(그래프, 키-값, 벡터)에 맞는 전용 저장소를 사용하고 이를 에이전트로 통합하는 아키텍처가 성능과 정확도 면에서 유리하다.

- 프로덕션 환경의 AI 에이전트 배포 시 모델 스로틀링에 대비한 모델 호핑과 데이터 거버넌스를 위한 RLS 도구 통합이 필수적이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료