핵심 요약

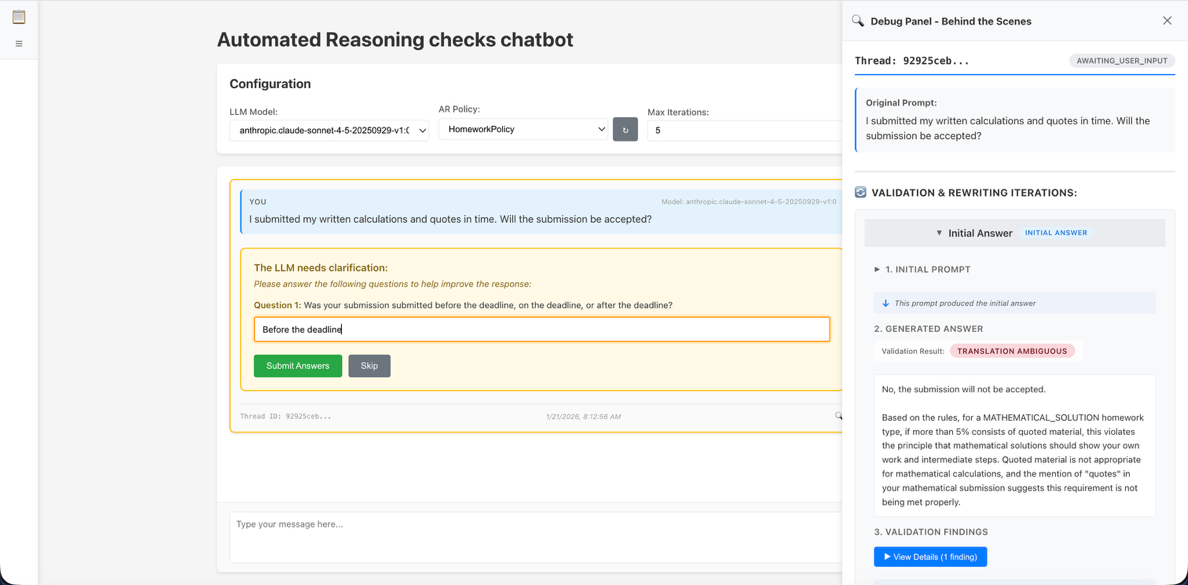

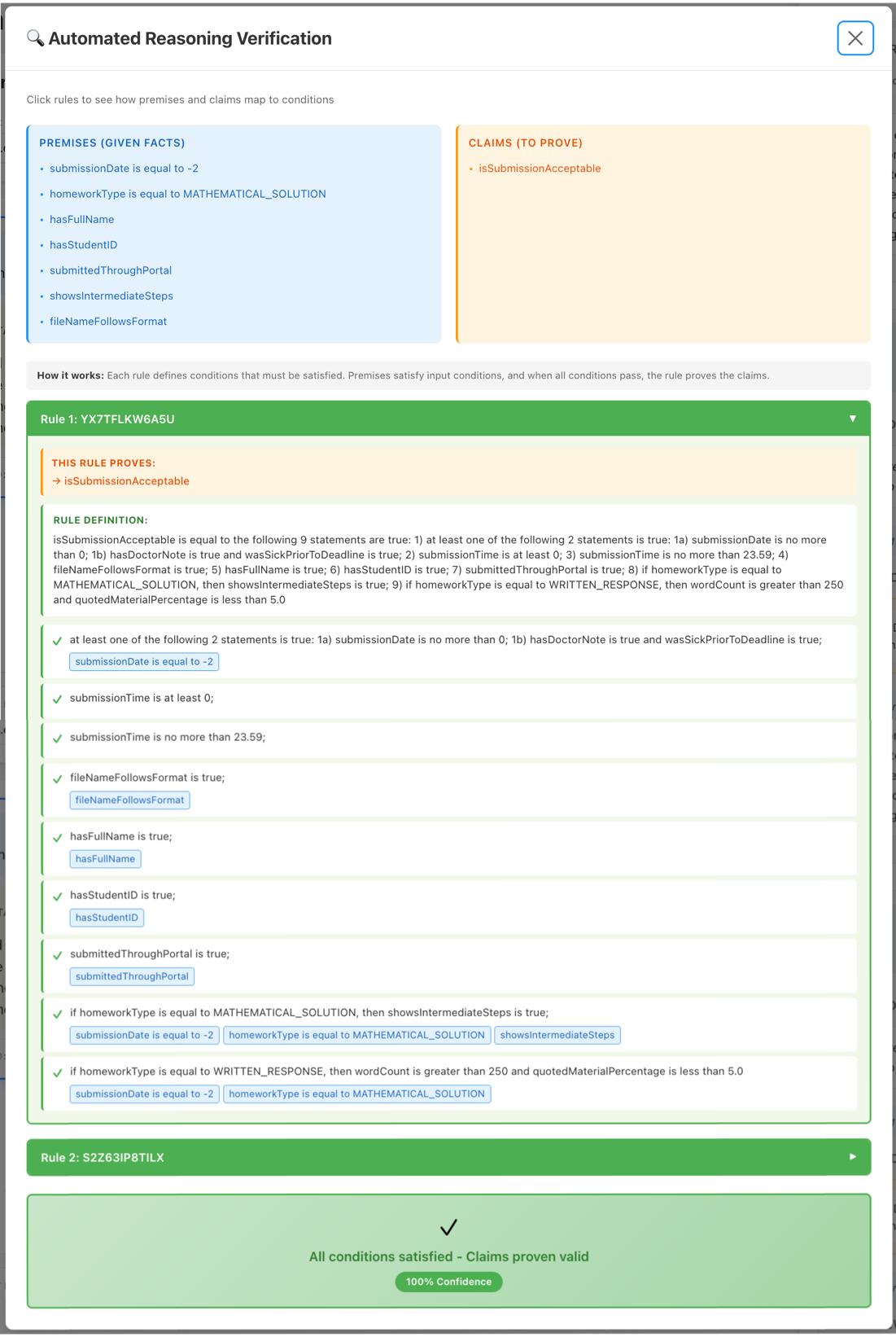

LLM의 환각 현상과 불투명성을 해결하기 위해 수학적 논리 연산을 기반으로 답변의 정확성을 검증하는 자동 추론(Automated Reasoning) 체크 기반 챗봇 참조 구현이 공개되었다. 이 시스템은 LLM이 생성한 답변을 사전에 정의된 정책과 대조하여 논리적 모순이나 모호함을 찾아내고, 이를 바탕으로 답변을 재작성하거나 사용자에게 추가 정보를 요청하는 반복 루프를 수행한다. 단순한 예측이 아닌 수학적 증명을 통해 답변의 타당성을 입증하므로, 규제가 엄격한 환경에서도 신뢰할 수 있는 AI 애플리케이션 구축이 가능하다.

배경

Amazon Bedrock 및 Guardrails에 대한 기본 지식, Python 및 Flask 프레임워크 이해, 기본적인 논리 및 추론 개념

대상 독자

프로덕션 환경에서 LLM의 정확성과 신뢰성을 확보하고자 하는 AI 엔지니어 및 아키텍트

의미 / 영향

이 기술은 LLM의 고질적인 문제인 환각 현상을 수학적 증명으로 해결하려는 시도로, AI 답변에 대한 법적·윤리적 책임이 중요한 엔터프라이즈 시장에서 생성 AI 도입을 가속화할 것으로 보인다.

섹션별 상세

실무 Takeaway

- LLM 답변의 신뢰성이 중요한 금융이나 규제 산업에서는 자동 추론 체크를 도입하여 답변의 수학적 타당성을 검증하고 감사 로그를 확보해야 한다.

- 답변이 모호할 때(TRANSLATION_AMBIGUOUS) LLM이 사용자에게 역으로 질문을 던지게 설계함으로써 데이터 부족으로 인한 환각 현상을 방지할 수 있다.

- 상태 머신 패턴 기반의 ThreadProcessor를 구현하여 복잡한 리라이팅 루프와 사용자 입력 대기 상태를 체계적으로 관리함으로써 시스템의 확장성을 높일 수 있다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.