핵심 요약

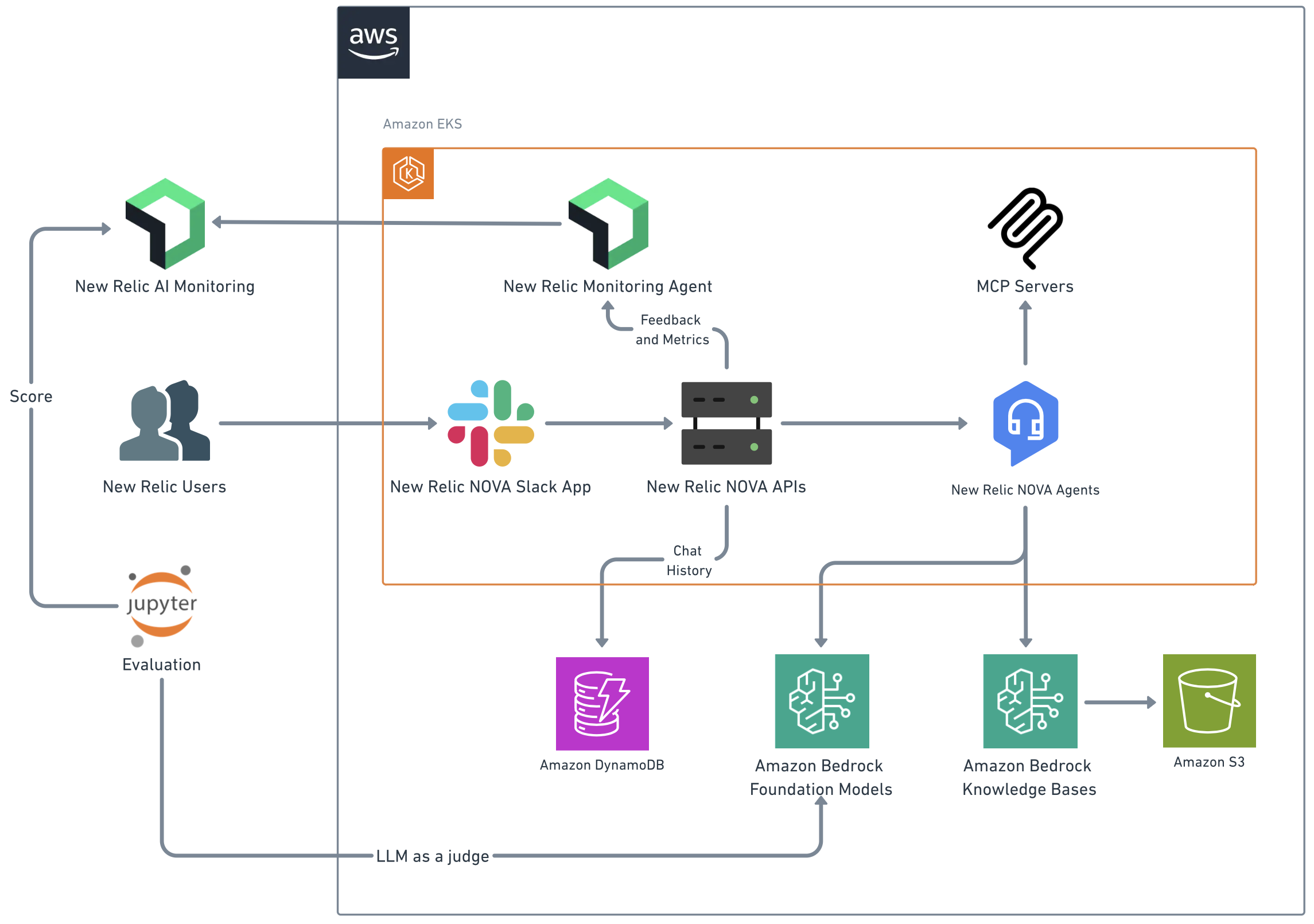

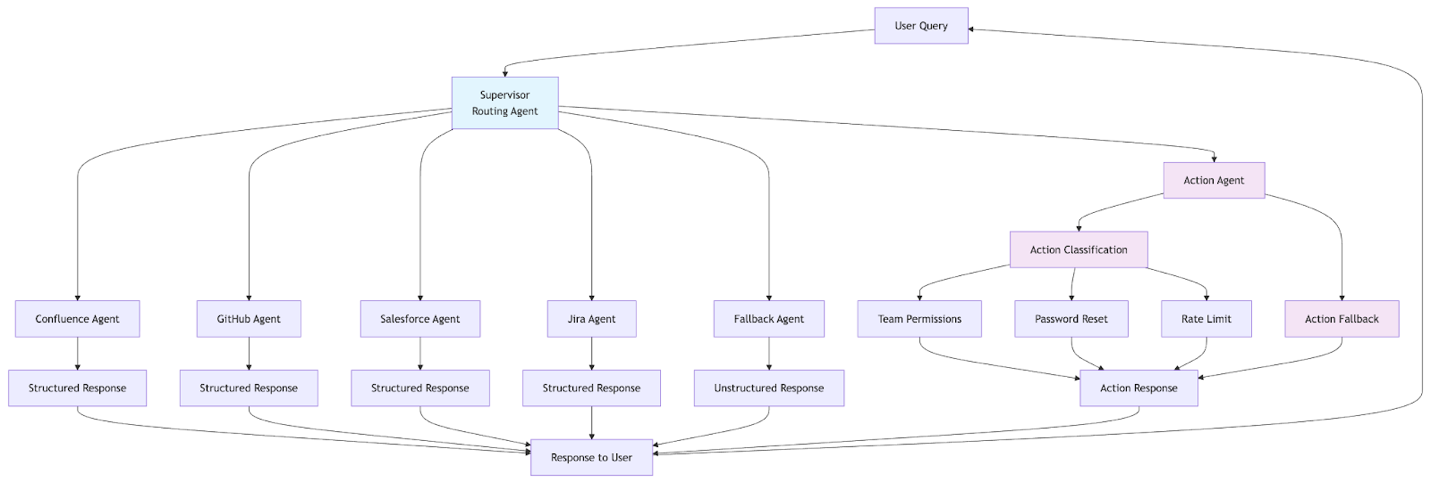

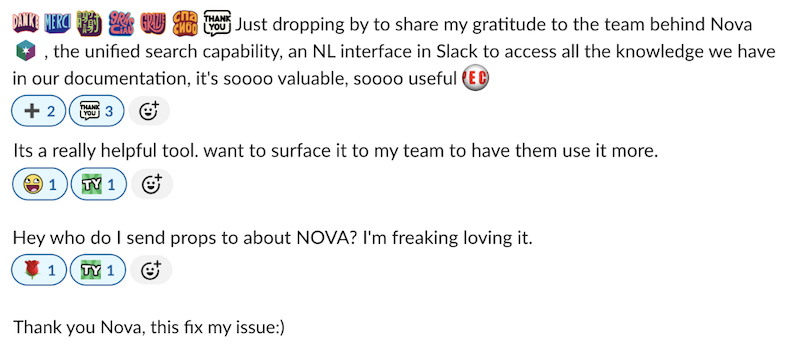

New Relic은 파편화된 문서 검색으로 인한 엔지니어의 생산성 저하를 해결하기 위해 AWS 기반 AI 어시스턴트 'NOVA'를 개발했다. Amazon Bedrock, Kendra, DynamoDB 등을 활용한 이 시스템은 단순 문서 검색을 넘어 팀 권한 요청 및 속도 제한 관리와 같은 복잡한 트랜잭션 작업까지 수행한다. 특히 계층적 청킹과 컨텍스트 보강을 포함한 고도화된 RAG 기법과 LLM-as-a-judge 평가 프레임워크를 도입하여 응답 정확도와 신뢰성을 확보했다. 그 결과 정보 검색 시간을 95% 단축하고 매일 1,000건 이상의 쿼리를 처리하며 조직 전반의 효율성을 크게 향상시켰다.

배경

Amazon Bedrock 및 RAG 아키텍처에 대한 기본 이해, 에이전트 오케스트레이션 및 MCP(Model Context Protocol) 개념, 벡터 데이터베이스 및 문서 청킹 전략에 대한 지식

대상 독자

엔터프라이즈 환경에서 AI 에이전트 및 RAG 시스템을 구축하려는 개발자 및 아키텍트

의미 / 영향

이 사례는 단순한 챗봇을 넘어 복잡한 사내 워크플로를 자동화하는 에이전트 시스템의 실질적인 구현 방법론을 제시한다. 특히 MCP와 같은 표준 프로토콜과 고도화된 RAG 최적화 기법이 기업의 생산성에 미치는 직접적인 영향을 수치로 증명했다.

섹션별 상세

실무 Takeaway

- RAG 시스템 구축 시 계층적 청킹과 메타데이터 보강을 결합하면 정보 검색 시간을 최대 95%까지 단축할 수 있다.

- MCP 표준 프로토콜을 활용하여 에이전트 아키텍처를 설계하면 다양한 외부 SaaS 도구와의 연동 비용을 줄이고 시스템 확장성을 높일 수 있다.

- 프로덕션 환경의 AI 에이전트는 LLM-as-a-judge와 실시간 사용자 피드백 루프를 결합하여 지속적인 성능 최적화 체계를 갖추어야 한다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.