핵심 요약

대형 언어 모델의 추론 비용 절감을 위해 MXFP4와 같은 저정밀도 양자화가 주목받고 있으나, 중소형 모델에서는 정확도 저하가 발생하는 한계가 있다. AMD 연구진은 온라인 입력 활성화 회전(Online Rotation)과 SmoothQuant 채널 재조정 스케일을 결합하여 이 문제를 해결했다. 이 기법은 데이터 내 이상치(Outlier)를 여러 채널로 분산시켜 양자화 오차를 줄이며, Qwen3 8B에서 32B 모델에 걸쳐 원본 BF16 대비 98% 이상의 정확도를 유지하는 성과를 거두었다. 블록 대각 구조를 활용해 연산 오버헤드를 최소화했으며, AMD Quark 라이브러리를 통해 실무에 적용 가능하다.

배경

양자화(Quantization) 기초 지식, Transformer 아키텍처 이해, 선형 대수학(직교 변환 및 행렬 연산)

대상 독자

LLM 추론 최적화 엔지니어 및 AMD Instinct 가속기 사용자

의미 / 영향

저정밀도 양자화의 한계를 극복함으로써 고성능 하드웨어의 이점을 극대화하고, 중소형 모델의 서빙 비용을 획기적으로 낮추면서도 모델 품질을 유지할 수 있게 한다.

섹션별 상세

이미지 분석

이상치가 포함된 데이터를 회전 변환을 통해 고르게 분포시킨 후 양자화하는 과정을 시각적으로 보여준다. 이를 통해 MXFP4 포맷에서도 높은 정밀도를 유지할 수 있는 원리를 설명한다.

MXFP4 양자화와 온라인 회전 및 SmoothQuant 결합을 통한 무손실 압축 개념도

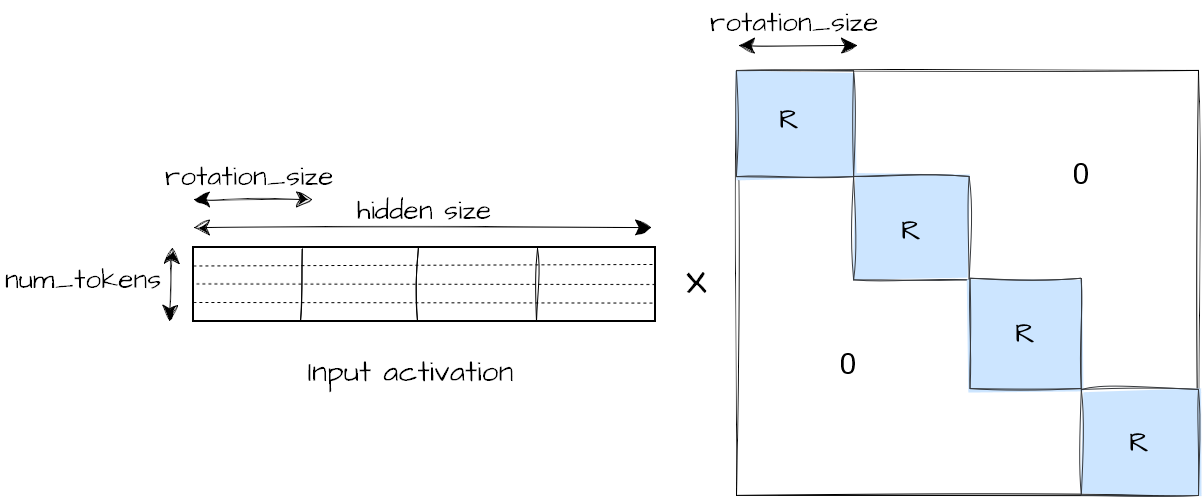

입력 활성화 값에 블록 단위로 회전 행렬 R을 곱하는 과정을 보여준다. 전체 행렬 연산 대신 블록 대각 구조를 사용하여 연산 효율성을 높이는 방식을 구체화한다.

온라인 입력 활성화 회전 연산의 블록 대각 구조 시각화

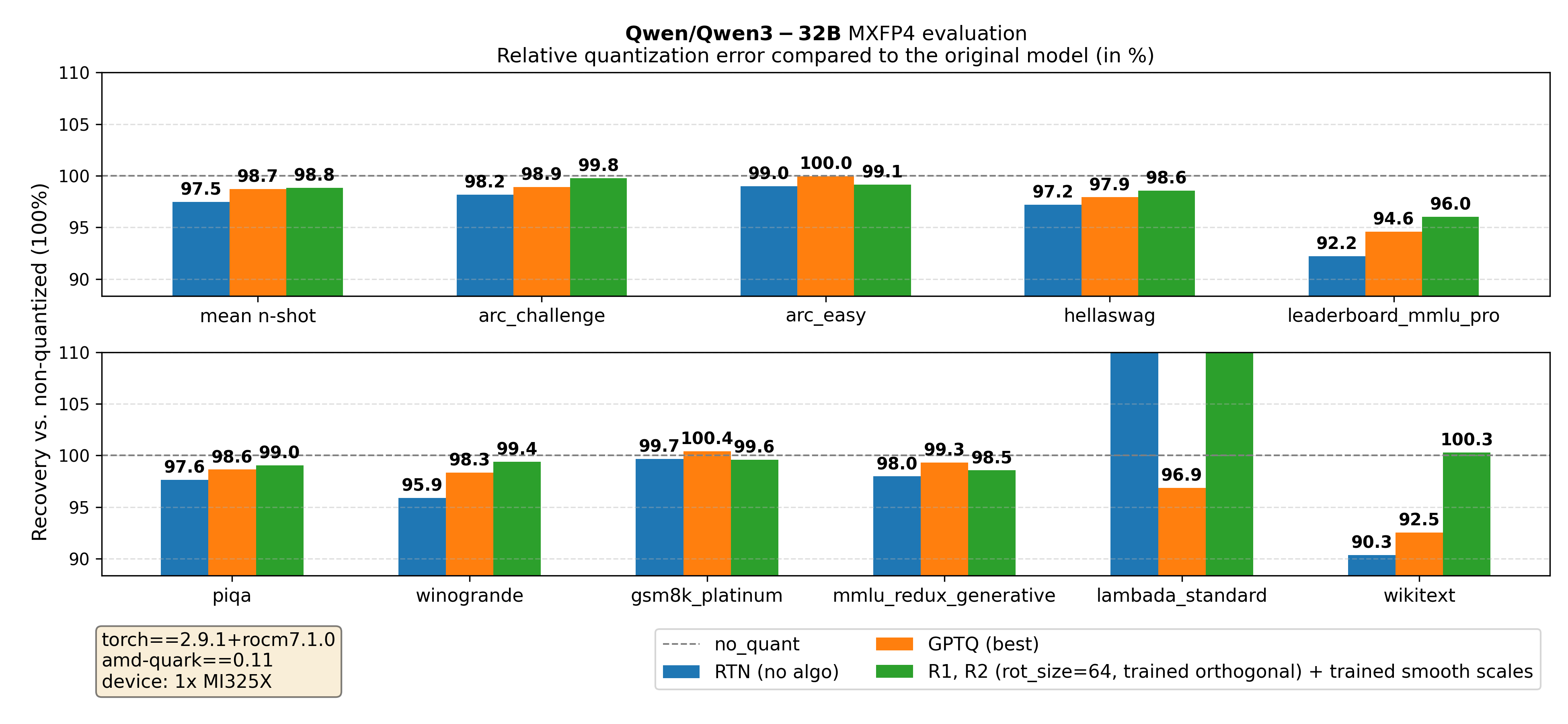

원본 모델 대비 RTN, GPTQ, 그리고 제안된 회전+SmoothQuant 기법의 성능을 비교한다. 제안된 기법이 모든 벤치마크 지표에서 원본에 가장 근접한 성능을 보임을 입증한다.

Qwen3-32B 모델의 MXFP4 양자화 성능 벤치마크 결과

실무 Takeaway

- MXFP4 양자화 시 정확도 유지가 어려운 8B-32B 규모 모델에 온라인 회전과 SmoothQuant 결합 튜닝을 적용하여 BF16 대비 98% 이상의 성능을 확보할 수 있다.

- 블록 대각(Block-diagonal) 구조의 회전 행렬을 사용하면 전체 행렬 회전 대비 연산량을 획기적으로 줄이면서도 충분한 이상치 분산 효과를 얻을 수 있다.

- AMD Quark 0.11 라이브러리를 활용하여 실제 모델에 이 기법을 적용하고 미세 조정을 수행할 수 있는 환경이 마련되어 실무 적용성이 높다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료