핵심 요약

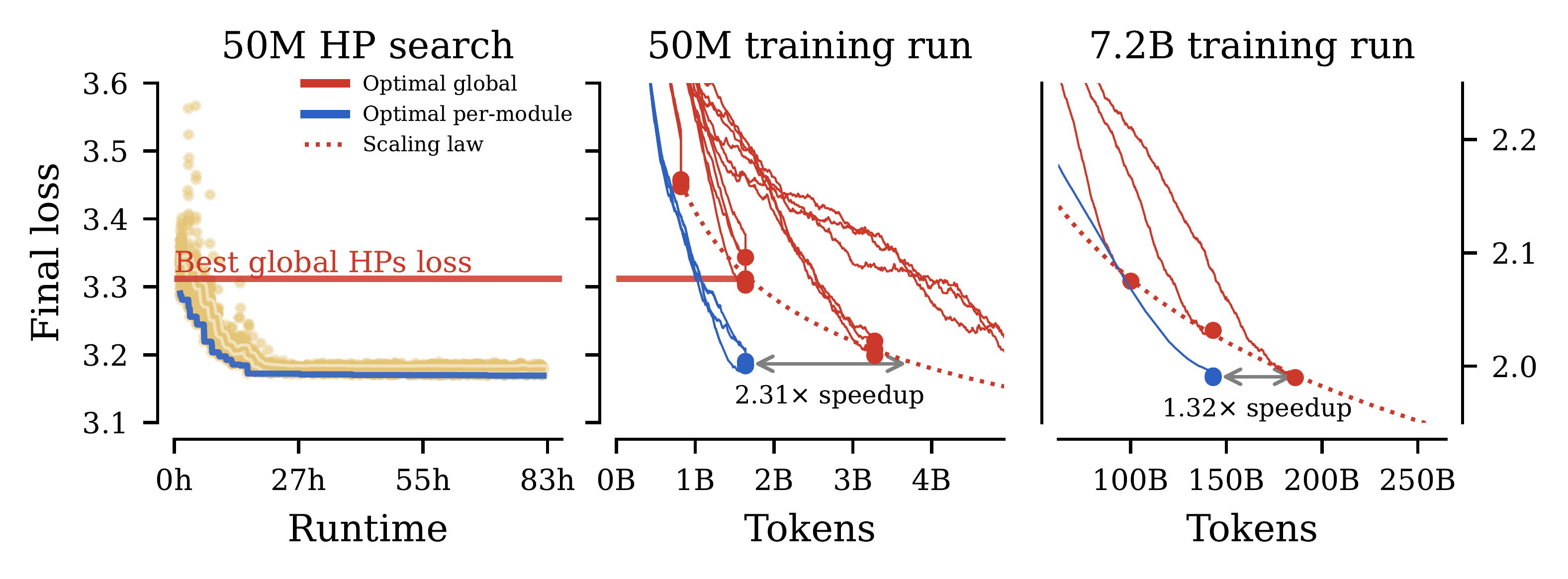

대형 언어 모델 학습에서 하이퍼파라미터 튜닝은 성능과 안정성에 결정적인 영향을 미치지만, 거대 모델에서 직접 수행하기에는 비용이 너무 크다. Apple 연구진은 기존의 μP를 확장하여 너비와 깊이는 물론 배치 크기와 학습 기간까지 통합 관리하는 Complete(d)P 파라미터화 기법을 개발했다. 이 기법을 통해 50M 규모의 소형 모델에서 모듈별로 최적화한 하이퍼파라미터를 추가 튜닝 없이 7.2B 모델로 성공적으로 전이했다. 실험 결과, 전이된 모듈별 하이퍼파라미터는 글로벌 최적값 대비 학습 속도를 최대 2.3배 향상시키는 성과를 거두었다.

배경

Hyperparameter Tuning, Scaling Laws, μP (Maximal Update Parameterization), AdamW Optimizer

대상 독자

LLM 학습 및 인프라 엔지니어, 모델 최적화 연구자

의미 / 영향

이 연구는 거대 모델 학습 시 발생하는 막대한 튜닝 비용 문제를 해결하고, 소형 모델에서의 실험 결과가 대형 모델에서도 일관되게 재현될 수 있는 이론적 토대를 강화한다.

섹션별 상세

실무 Takeaway

- Complete(d)P 파라미터화를 적용하면 소형 모델(50M)에서 찾은 최적 하이퍼파라미터를 14,000배 큰 연산량의 대형 모델로 추가 튜닝 없이 직접 적용할 수 있다.

- 모델 전체에 동일한 학습률을 적용하는 대신 모듈별로 하이퍼파라미터를 미세 조정함으로써 학습 효율을 최대 2.3배까지 높이는 성능 최적화가 가능하다.

- 학습 안정성과 성능을 위해 너비뿐만 아니라 깊이, 배치 크기, 학습 기간을 모두 고려한 통합 파라미터화 설계가 대규모 LLM 학습의 핵심이다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.