핵심 요약

Arcee AI는 미국 내 오픈 소스 AI 생태계의 공백을 메우기 위해 400B 규모의 MoE 모델인 Trinity Large를 출시했다. 이 모델은 13B 활성 파라미터를 가진 고도로 희소한 구조로 설계되었으며 엔비디아 B300 블랙웰 클러스터에서 17조 개의 토큰으로 학습되었다. 전체 프로젝트에 약 2,000만 달러의 예산과 6개월의 기간이 소요되었으며 Muon 옵티마이저와 같은 최신 기법을 도입하여 학습 효율성을 극대화했다. Arcee AI는 이를 통해 폐쇄형 모델에 의존하지 않고 기업들이 온프레미스 환경에서 고성능 오픈 모델을 활용할 수 있는 경로를 제시한다.

배경

MoE(Mixture of Experts) 아키텍처에 대한 이해, LLM 학습 옵티마이저(Adam, Muon 등) 지식, 온프레미스 모델 배포 및 인프라 개념

대상 독자

엔터프라이즈 LLM 도입 결정권자 및 대규모 모델 학습 엔지니어

의미 / 영향

이 모델의 출시는 미국 내에서도 중소 규모 스타트업이 효율적인 기술 선택을 통해 400B급 거대 모델을 성공적으로 학습할 수 있음을 증명한다. 특히 중국산 모델이 주도하던 오픈 소스 벤치마크 상위권에 미국산 모델이 다시 진입함으로써 기업들의 선택지가 넓어질 것으로 예상된다.

섹션별 상세

이미지 분석

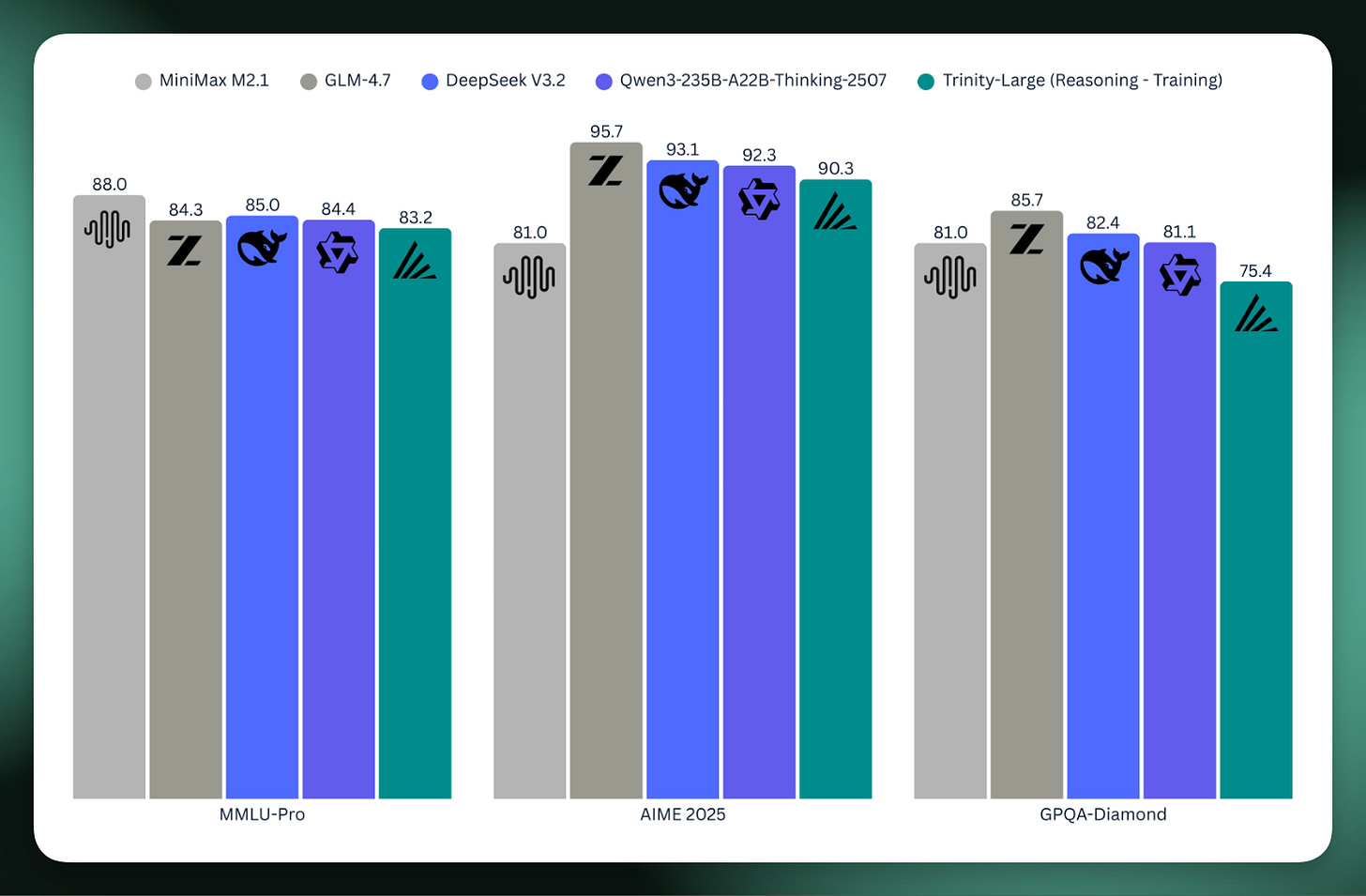

MMLU-Pro, AIME 2025, GPQA-Diamond 벤치마크에서 Trinity-Large가 MiniMax M2.1, GLM-4.7, DeepSeek V3.2 등과 대등하거나 우수한 성능을 보임을 나타낸다. 특히 추론 능력을 측정하는 AIME 2025에서 90.3점을 기록하며 경쟁력을 입증한다.

Trinity-Large와 주요 오픈 소스 모델들의 벤치마크 성능 비교 차트

실무 Takeaway

- MoE 아키텍처에서 활성 파라미터 비율을 13B/400B 수준으로 낮춤으로써 거대 모델의 성능과 실용적인 추론 비용을 동시에 달성할 수 있다.

- Muon 옵티마이저와 같은 최신 최적화 알고리즘을 도입하면 기존 Adam 대비 적은 메모리 사용과 빠른 수렴으로 학습 비용을 획기적으로 절감한다.

- 기업용 LLM 도입 시 데이터 주권과 보안을 위해 미국 내에서 학습된 오픈 웨이트 모델이 중국산 모델의 강력한 대안이 된다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료