핵심 요약

2025년 연말, 오픈 소스 AI 생태계는 NVIDIA의 Nemotron-3-Nano, Arcee의 Trinity-Mini, Zhipu의 GLM-4.7 등 강력한 모델들이 출시되며 활기를 띠었다. 특히 NVIDIA는 Mamba2-Transformer 아키텍처에 MoE를 결합한 혁신적인 구조를 선보였으며, Zhipu의 GLM-4.7은 코딩 및 디자인 영역에서 상용 모델에 필적하는 성능을 입증했다. 이러한 흐름은 2026년에도 이어져 더 큰 규모의 모델과 멀티 토큰 예측(MTP) 기술의 도입이 가속화될 전망이다.

배경

MoE(Mixture of Experts) 아키텍처에 대한 기본 이해, LLM 벤치마크 지표(GPQA, SWE-bench 등)에 대한 지식

대상 독자

오픈 소스 LLM을 활용하거나 연구하는 AI 엔지니어 및 개발자

의미 / 영향

오픈 소스 모델이 특정 도메인(코딩, 디자인)에서 상용 모델의 성능을 빠르게 추격함에 따라, 기업들의 모델 선택지가 넓어지고 구축 비용이 절감될 것이다.

섹션별 상세

이미지 분석

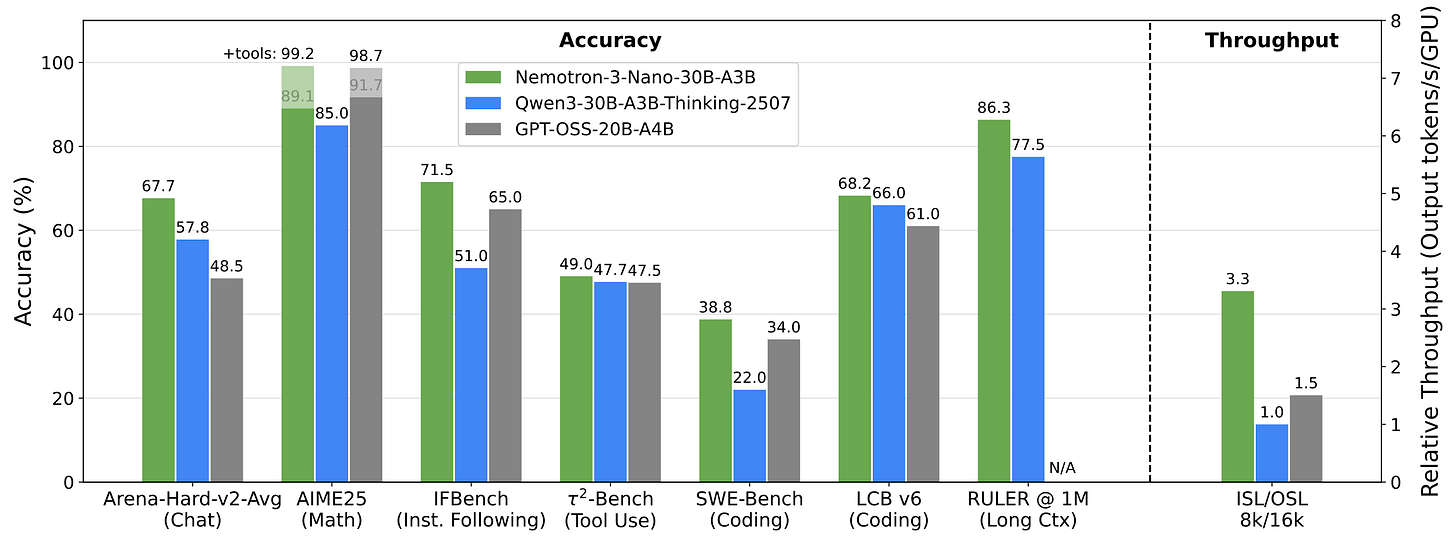

Arena-Hard, AIME25 등 주요 지표에서 Nemotron 모델이 Qwen3 및 GPT-OSS 대비 우수한 정확도를 기록하고 있음을 보여준다. 특히 우측의 Throughput 지표에서 경쟁 모델 대비 월등히 높은 토큰 처리 성능을 입증한다.

Nemotron-3-Nano-30B-A3B의 벤치마크 성능 및 처리량 비교 차트

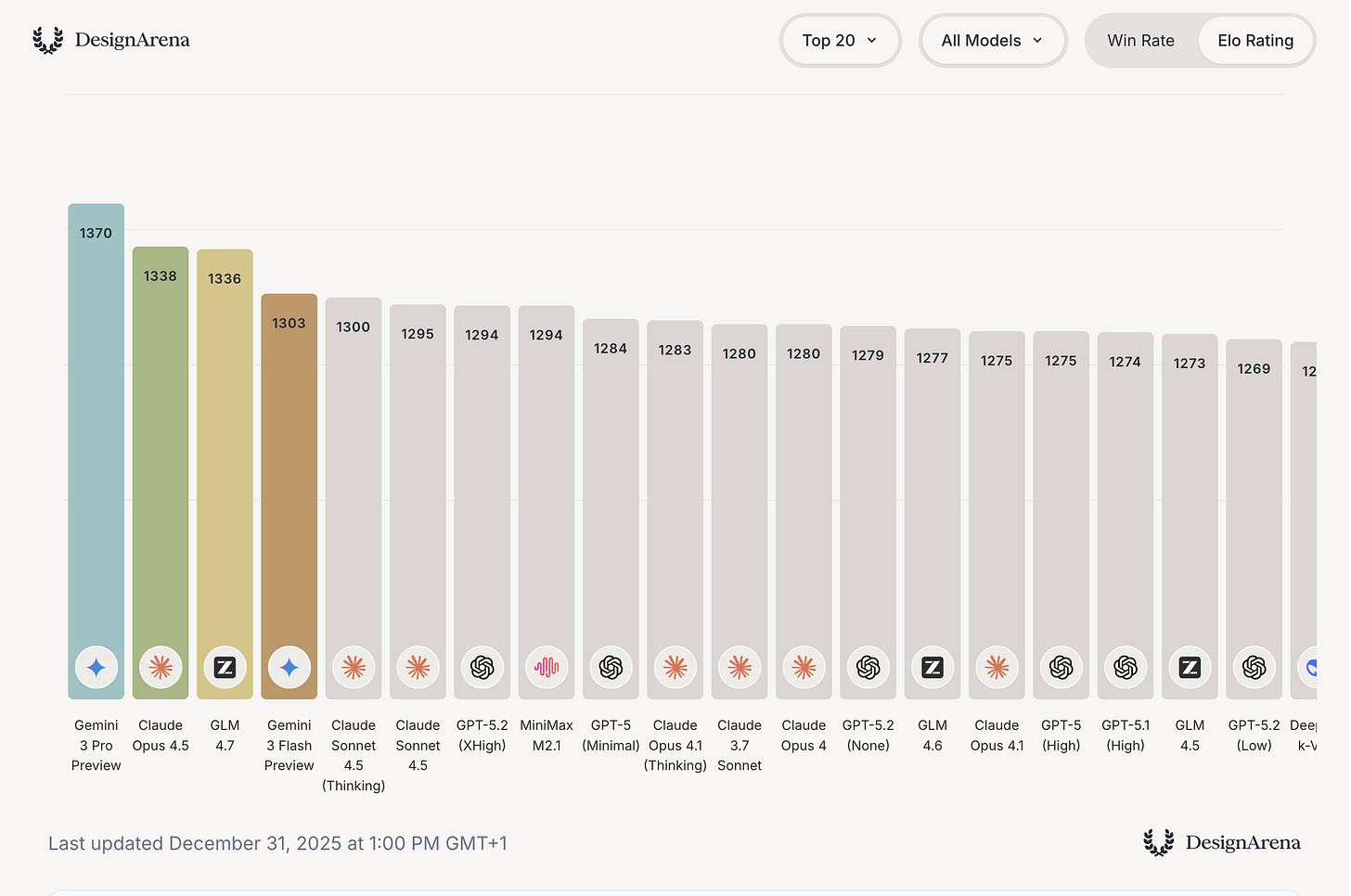

Gemini 3 Pro Preview가 1위를 차지한 가운데, 오픈 모델인 GLM 4.7이 Claude Opus 4.5와 대등한 수준의 Elo 레이팅(1336점)을 기록하며 상위권에 위치함을 시각화한다. 이는 오픈 모델의 실무 디자인 능력이 최상위권 상용 모델 수준에 도달했음을 의미한다.

DesignArena 리더보드 순위표

실무 Takeaway

- NVIDIA는 Mamba2와 MoE를 결합한 하이브리드 아키텍처를 통해 추론 효율성과 성능의 균형을 꾀하고 있다.

- GLM-4.7과 같은 최신 오픈 모델은 코딩 및 디자인 실무에서 유료 API 모델인 Claude 시리즈에 근접한 가성비를 제공한다.

- 2026년에는 멀티 토큰 예측(MTP)과 Latent MoE가 대형 오픈 모델의 핵심 기술 트렌드로 자리 잡을 것이다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료