핵심 요약

2025년은 강화학습(RL)과 추론 모델(Reasoning Models)이 AI 생태계의 중심에 선 한 해였다. Interconnects는 DeepSeek V3/R1의 등장과 이에 대응하는 미국 내 오픈 모델 프로젝트(ATOM) 등 급변하는 기술 트렌드를 심도 있게 분석했다. 특히 중국 오픈 모델의 약진과 추론 시간 스케일링(Inference-time scaling)의 부상은 기존 프론티어 모델들의 독점적 지위에 강력한 도전장을 내밀었다. 저자는 연구자이자 분석가로서 80여 개의 포스트를 통해 기술적 진보와 업계의 지속 가능성을 동시에 조명했다.

배경

LLM 기본 구조 및 트랜스포머 아키텍처, RLHF(강화학습 기반 인간 피드백)의 개념, 오픈 소스 AI 생태계 및 주요 모델(Llama, Qwen 등)에 대한 이해

대상 독자

AI 연구자, ML 엔지니어, AI 전략가 및 정책 입안자

의미 / 영향

2025년의 성과는 AI가 단순한 통계적 예측 모델에서 논리적 추론 체계로 전환되었음을 의미한다. 이는 향후 자율 에이전트 시대를 가속화하며, 오픈 소스 모델이 프론티어 모델의 성능을 빠르게 추격함에 따라 AI 기술의 민주화와 경쟁 지형의 재편이 가속화될 것으로 전망된다.

섹션별 상세

이미지 분석

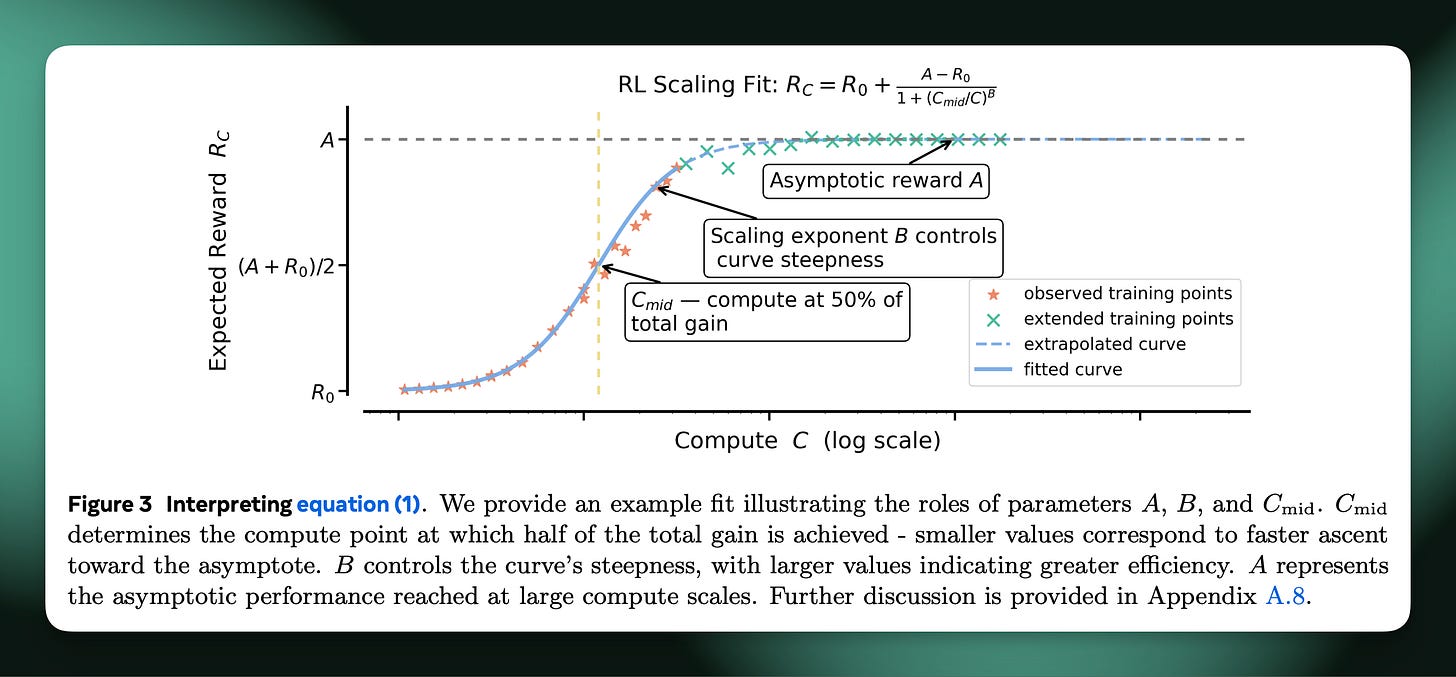

컴퓨팅 자원(Compute C) 투입량에 따른 기대 보상(Expected Reward Rc)의 변화를 보여준다. 파라미터 A, B, Cmid를 통해 모델 성능이 점진적으로 수렴하는 과정을 수학적으로 모델링하여 RL 학습의 효율성을 분석하는 데 활용된다.

강화학습(RL) 스케일링 법칙을 설명하는 수식과 그래프이다.

Frontier 그룹에 DeepSeek, Anthropic, OpenAI를 배치하여 현재 시장의 주도권을 시각화했다. 중국 기업(Qwen, Kimi)과 미국 기업들의 상대적 위치를 통해 2025년의 경쟁 지형을 한눈에 파악할 수 있게 돕는다.

AI 모델 개발사들을 성능과 영향력에 따라 분류한 티어 리스트이다.

실무 Takeaway

- 추론 시간 스케일링(Inference-time scaling)은 모델 성능 향상의 새로운 핵심 축으로 자리 잡았으므로 이를 위한 RL 인프라 구축이 필수적이다.

- 중국발 오픈 모델(Qwen, DeepSeek)의 기술적 수준이 프론티어 모델에 근접했으므로 연구 및 개발 시 이들을 벤치마크 및 베이스 모델로 적극 고려해야 한다.

- 단순한 모델 크기 경쟁보다 데이터 큐레이션과 사후 학습(Post-training) 기법의 정교함이 모델의 개성과 성능을 결정짓는 핵심 차별화 요소가 된다.

AI 요약 · 북마크 · 개인 피드 설정 — 무료