핵심 요약

최근 미국과 중국을 중심으로 고성능 오픈 소스 모델 출시가 가속화되면서 AI 생태계의 지형 변화가 뚜렷해지고 있다. 미국에서는 Ai2, Nvidia, IBM 등이 Apache 2.0 라이선스를 기반으로 실질적인 오픈 모델을 주도하는 반면, 중국의 'AI 타이거즈'들은 공격적인 생태계 파트너십과 무료 API 제공을 통해 시장 점유율을 확대하고 있다. 특히 Kimi K2 Thinking과 Olmo 3 32B Think와 같은 추론 특화 모델들이 등장하며 폐쇄형 모델과의 격차를 좁히고 있다. 이러한 흐름은 단순한 모델 공개를 넘어 데이터와 학습 과정까지 투명하게 공개하는 '진정한 오픈 소스'의 부활로 이어지고 있다.

배경

LLM 아키텍처(MoE, Attention) 이해, 벤치마크 지표(MMLU, HumanEval) 지식, API 서빙 및 추론 엔진 기초

대상 독자

LLM 도입을 검토 중인 엔지니어 및 AI 전략 기획자

의미 / 영향

오픈 소스 모델이 폐쇄형 모델의 성능을 빠르게 추격함에 따라 기업들의 모델 선택권이 넓어지고 있으며, 특히 추론 특화 모델의 등장이 에이전트 기술 발전을 가속화할 것이다.

섹션별 상세

미국의 주요 오픈 모델 개발사들은 소규모 고효율 모델과 관대한 라이선스 정책에 집중하고 있다. Ai2의 Olmo 3는 데이터부터 모델 가중치까지 모두 공개하는 진정한 오픈 소스 리더로 자리매김했으며, Nvidia는 Nemotron 시리즈를 통해 중국 모델에 대응하는 강력한 성능을 보여주고 있다. IBM은 하이브리드 어텐션(Hybrid-attention)과 MoE 아키텍처를 적용한 Granite 4.0을 출시하며 중소형 모델 시장에서의 입지를 강화하고 있다.

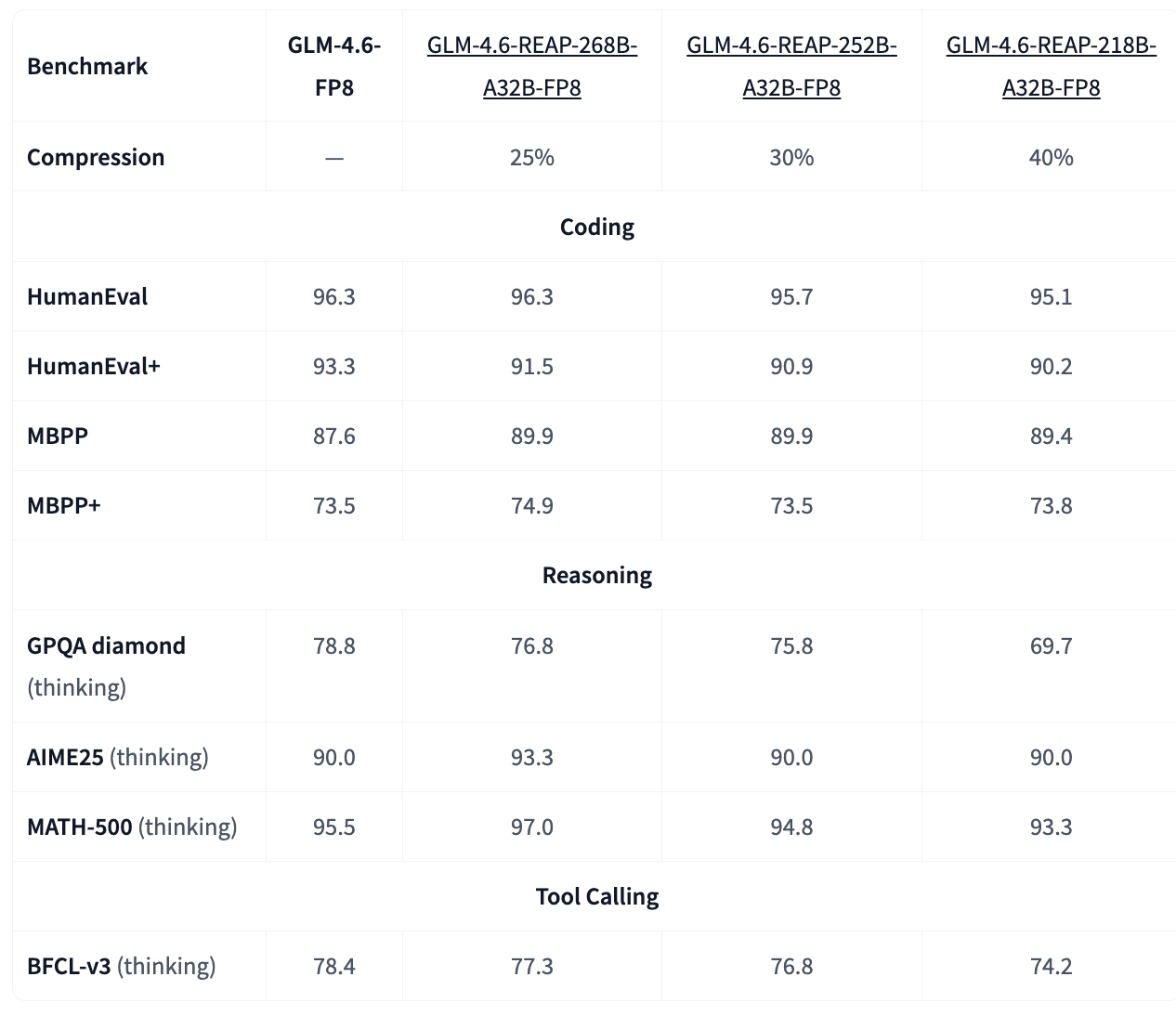

중국 기업들은 '모델 출시 플레이북'이라 불리는 정교한 전략을 통해 글로벌 영향력을 확대하고 있다. MiniMax, Moonshot(Kimi), Zhipu(GLM) 등은 출시 당일부터 vLLM, OpenRouter 등 서구권 생태계 도구들을 지원하며 사용자 접근성을 극대화한다. 또한 일정 기간 API를 무료로 제공하고 Claude Code와 호환되는 코딩 도구를 출시하여 개발자들을 자사 생태계로 빠르게 유입시키고 있다.

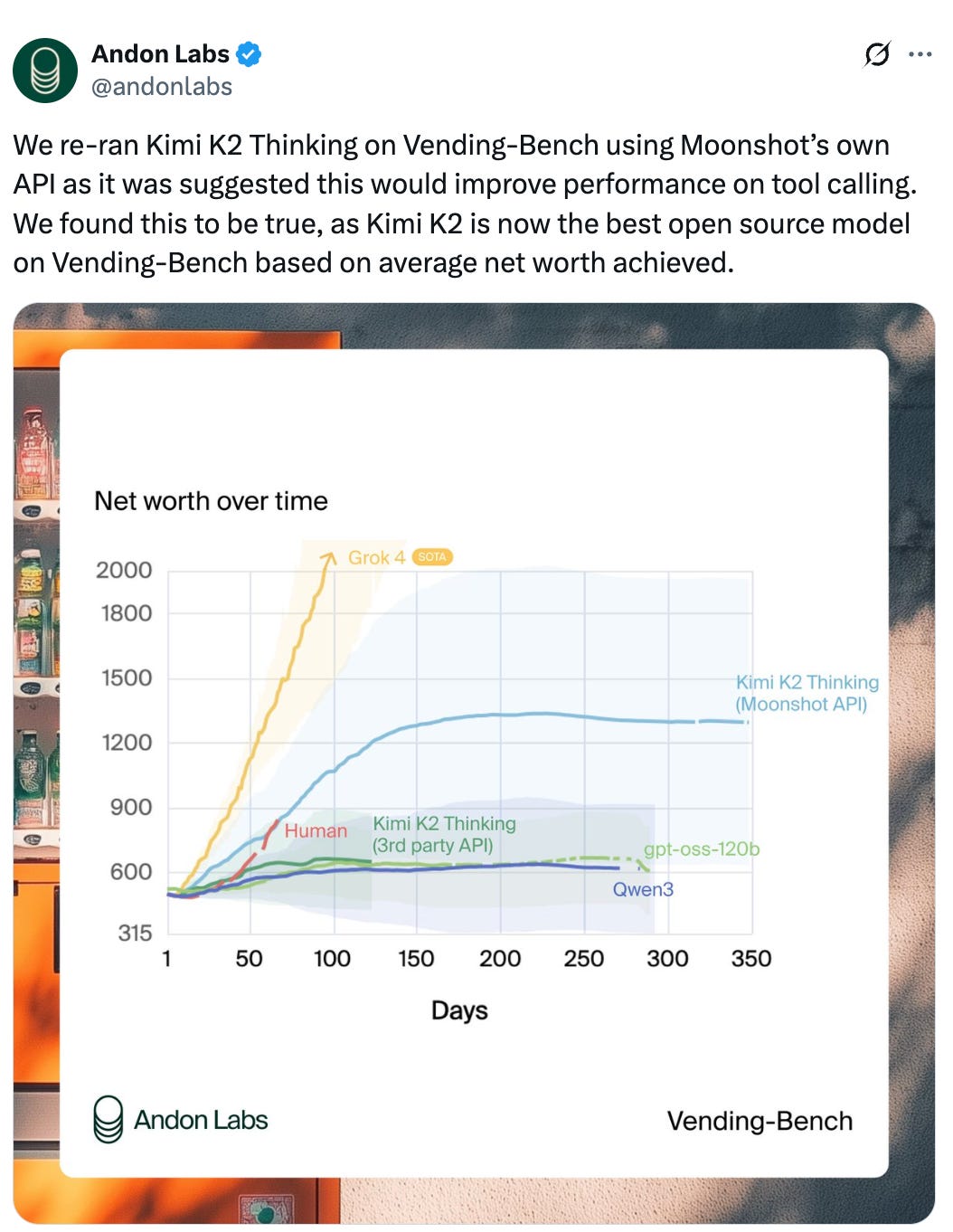

최신 추론 모델인 Kimi K2 Thinking은 벤치마크에서 최고 수준의 성능을 보여주었으나, 서드파티 API 제공업체들의 구현 미숙으로 인한 성능 저하 문제가 지적되었다. Andon Labs의 Vending-Bench 테스트 결과, 공식 API를 사용할 때와 서드파티 API를 사용할 때의 성능 차이가 극명하게 나타났다. 이는 오픈 모델의 확산에 있어 모델 자체의 성능뿐만 아니라 추론 엔진 및 API 구현의 정확도가 핵심적인 변수가 되고 있음을 시사한다.

진정한 오픈 소스(Truly Open) 모델의 부활이 눈에 띄며, 이는 데이터와 학습 파이프라인 전체를 공개하는 방향으로 나아가고 있다. 스탠퍼드 대학교의 Marin 커뮤니티 모델과 Ai2의 Olmo 3가 대표적인 사례로, 이들은 상업적 제약이 적은 Apache 2.0 라이선스를 채택하여 개발자 친화적인 환경을 조성하고 있다. 이러한 움직임은 모델의 내부 동작을 검증하고 연구하려는 학계와 개발자 커뮤니티의 요구를 충족시키고 있다.

이미지 분석

실무 Takeaway

- 오픈 모델 선택 시 공식 API와 서드파티 제공업체 간의 성능 차이를 반드시 벤치마크(Vending-Bench 등)로 검증해야 함

- 중국산 모델(Qwen, Kimi, GLM) 도입 시 vLLM이나 OpenRouter와의 즉각적인 호환성을 활용해 초기 구축 비용을 절감할 수 있음

- 데이터 투명성이 중요한 프로젝트라면 Olmo 3나 Marin과 같이 학습 데이터셋까지 공개된 '진정한 오픈' 모델을 우선 고려해야 함

AI 분석 전체 내용 보기

AI 요약 · 북마크 · 개인 피드 설정 — 무료