핵심 요약

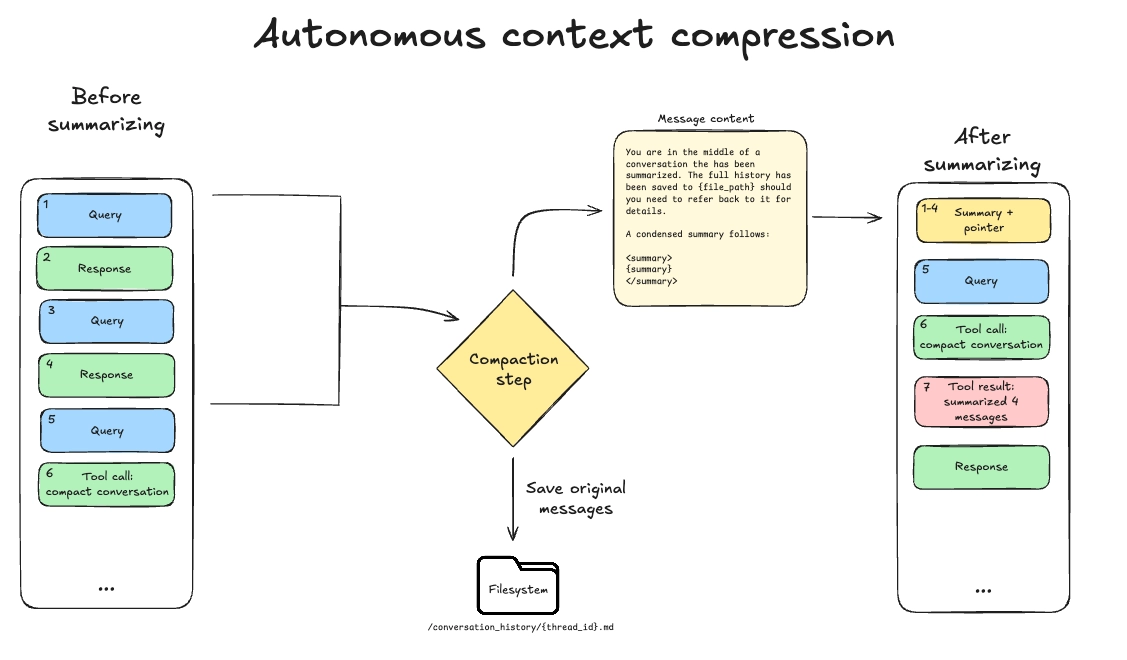

LLM 에이전트의 제한된 컨텍스트 창을 효율적으로 관리하기 위해 에이전트가 스스로 압축 시점을 결정하는 자율적 컨텍스트 압축 기능이 도입됐다. 기존의 고정된 토큰 임계값 방식은 작업 도중 맥락을 끊을 위험이 있었으나, 새로운 방식은 에이전트가 작업 경계나 대량 데이터 처리 전후를 판단하여 실행한다. 압축된 원본 메시지는 파일 시스템에 저장되어 필요시 참조 가능하며, 이를 통해 에이전트의 추론 능력을 극대화하고 컨텍스트 노후화 문제를 해결한다. 현재 Deep Agents SDK와 CLI에서 이 기능을 사용할 수 있다.

배경

LLM Context Window 개념, LangChain 또는 Deep Agents SDK 기본 지식, Python 미들웨어 구조 이해

대상 독자

LLM 에이전트 및 복잡한 워크플로 자동화 시스템을 구축하는 개발자

의미 / 영향

이 기술은 에이전트가 자신의 작업 환경을 스스로 최적화하는 방향으로 진화하고 있음을 보여준다. 하드코딩된 규칙 대신 모델의 추론 능력을 메모리 관리에 활용함으로써 더 길고 복잡한 작업을 안정적으로 수행하는 에이전트 구축이 가능해진다.

섹션별 상세

from deepagents import create_deep_agent

from deepagents.backends import StateBackend

from deepagents.middleware.summarization import (

create_summarization_tool_middleware,

)

backend = StateBackend # if using default backend

model = "openai:gpt-5.4"

agent = create_deep_agent(

model=model,

middleware=[

create_summarization_tool_middleware(model, backend),

],

)Deep Agents SDK에서 자율 요약 도구 미들웨어를 활성화하는 예시 코드

실무 Takeaway

- 고정된 토큰 제한 기반의 압축 대신 에이전트의 판단에 따른 자율 압축을 도입하여 작업의 맥락 유실을 방지하고 메모리 효율을 높일 수 있다.

- 압축된 데이터의 원본을 파일 시스템에 백업하고 포인터를 제공함으로써 에이전트가 요약 과정에서 놓친 세부 정보를 나중에 다시 찾아볼 수 있는 안전장치를 확보한다.

- 긴 대화나 복잡한 다단계 작업을 수행하는 에이전트 설계 시 미들웨어를 통해 자율 요약 기능을 추가하면 수동 튜닝 없이도 성능 최적화가 가능하다.

언급된 리소스

AI 요약 · 북마크 · 개인 피드 설정 — 무료

출처 · 인용 안내

인용 시 "요약 출처: AI Trends (aitrends.kr)"를 표기하고, 사실 확인은 원문 보기 기준으로 진행해 주세요. 자세한 기준은 운영 정책을 참고해 주세요.